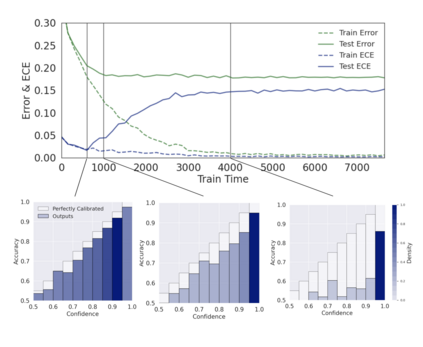

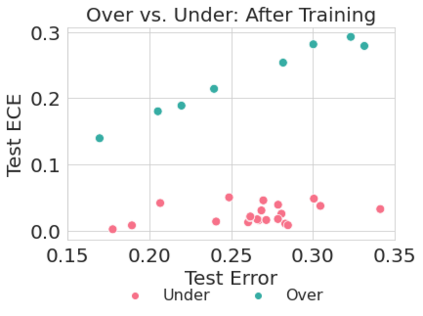

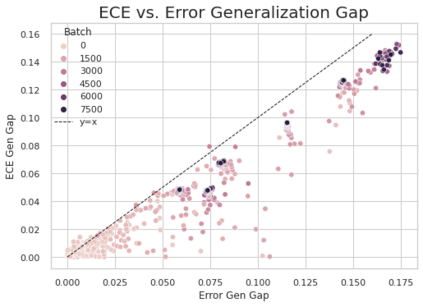

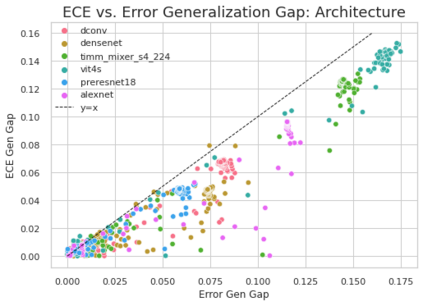

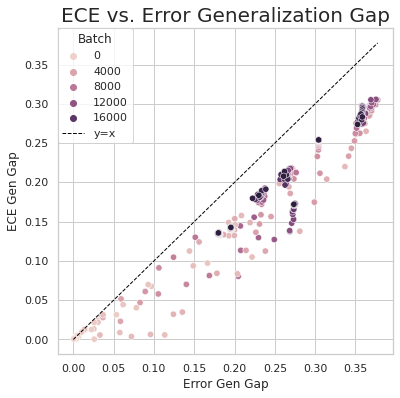

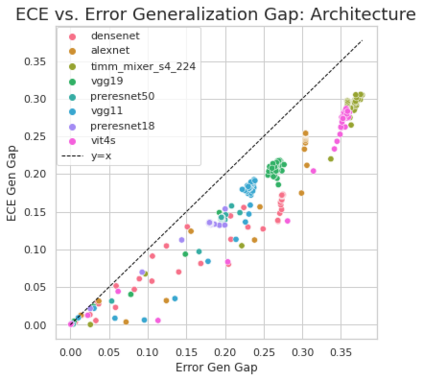

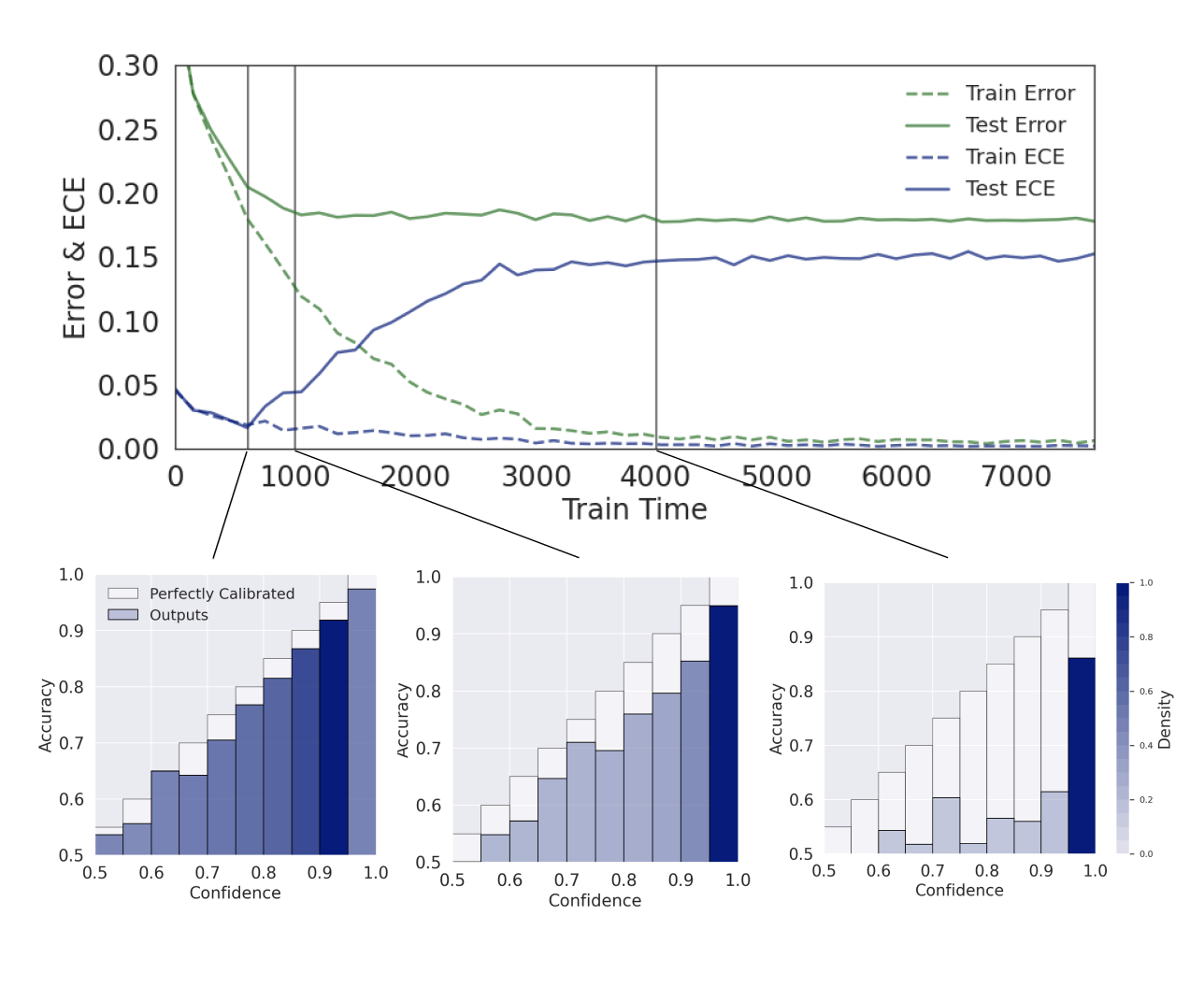

Calibration is a fundamental property of a good predictive model: it requires that the model predicts correctly in proportion to its confidence. Modern neural networks, however, provide no strong guarantees on their calibration -- and can be either poorly calibrated or well-calibrated depending on the setting. It is currently unclear which factors contribute to good calibration (architecture, data augmentation, overparameterization, etc), though various claims exist in the literature. We propose a systematic way to study the calibration error: by decomposing it into (1) calibration error on the train set, and (2) the calibration generalization gap. This mirrors the fundamental decomposition of generalization. We then investigate each of these terms, and give empirical evidence that (1) DNNs are typically always calibrated on their train set, and (2) the calibration generalization gap is upper-bounded by the standard generalization gap. Taken together, this implies that models with small generalization gap (|Test Error - Train Error|) are well-calibrated. This perspective unifies many results in the literature, and suggests that interventions which reduce the generalization gap (such as adding data, using heavy augmentation, or smaller model size) also improve calibration. We thus hope our initial study lays the groundwork for a more systematic and comprehensive understanding of the relation between calibration, generalization, and optimization.

翻译:校准是一个良好预测模型的基本属性: 它要求模型正确预测与其信任度成比例的正确值。 但是, 现代神经网络无法对其校准提供有力的保证, 并且无法根据环境对校准进行精确校准或校准。 目前尚不清楚哪些因素有助于校准良好( 建筑、 数据扩增、 过分度等), 尽管文献中存在各种主张 。 我们建议了一种系统的方法来研究校准错误: 将其分解为 (1) 将校准错误分解成 :(1) 火车机组的校准错误, (2) 校准一般差。 这反映了一般化的基本分解。 这反映了这些条件的基本分解。 我们然后调查其中的每一个条件, 并给出经验性证据:(1) DNN通常校准在火车上, (2) 校准总差是标准总差的上限上限。 综合起来,这意味着有小总差的模型( “ 测试错误 - 训练错误 ” ) 是完全校准的。 这个观点将许多文献的结果统一起来, 并表明干预措施缩小了普遍化差距( 例如, 改进了我们总校准的模型 ) 和 之间 的校准 之间的,, 使 更大规模的校准 更 更, 更 更 更 更, 的 更 更 更 的 更 更 更 更 更 更 更 更 的 的 的 的 的 的,,,, 更 更 更 更 更 更 更 更 更 更 的 的 更 更 更 的 更 更 的 更 的 更 更 的 更 更 更 更 的 的 的 的 更 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 的 更 更 更 更 更 的 的 的 的 的 更 的 的 的 的 的 的 的 的 更 更 的 的 和 更 更 更 更 更 更 更 更 更 更