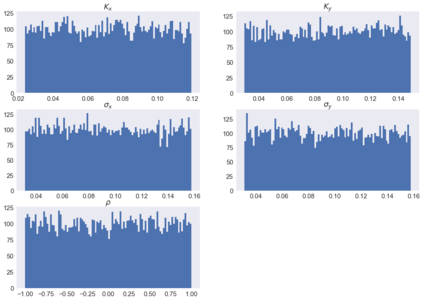

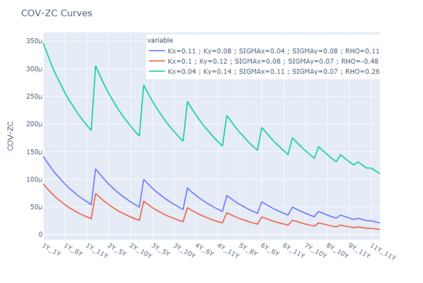

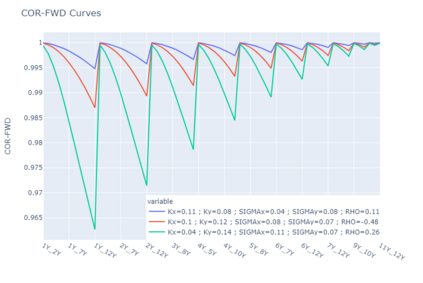

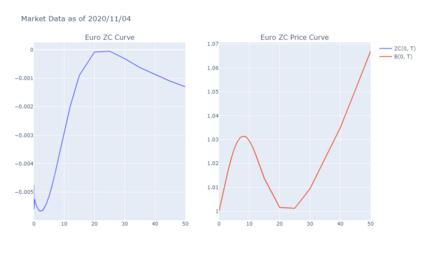

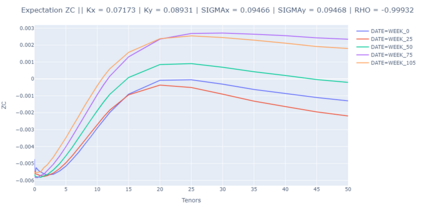

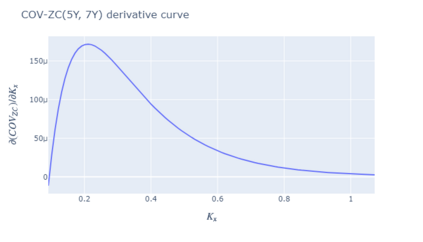

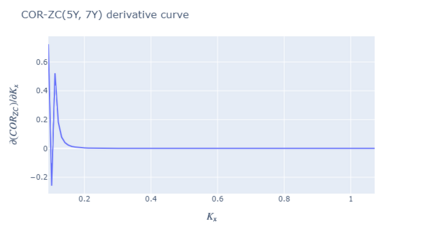

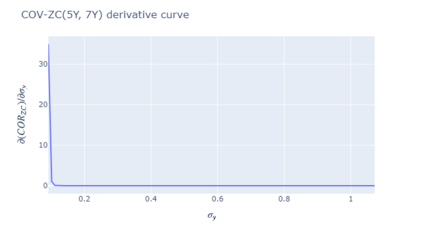

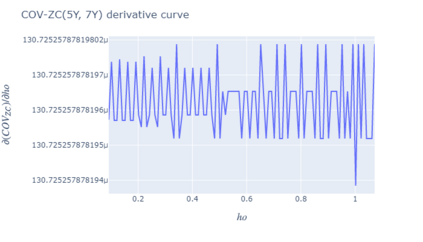

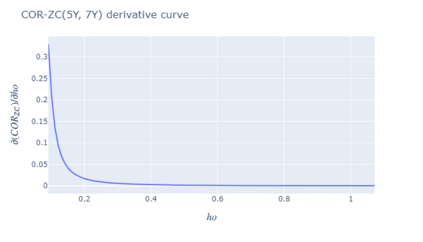

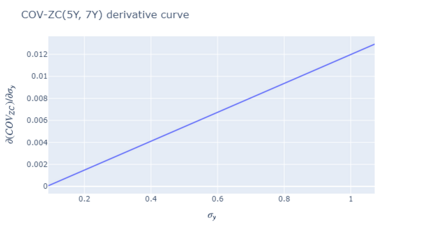

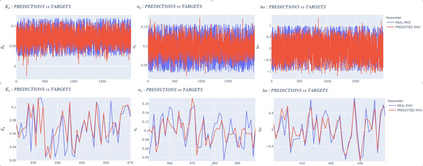

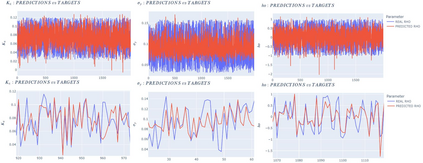

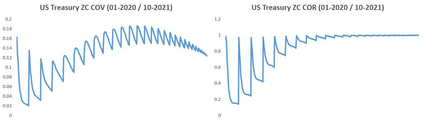

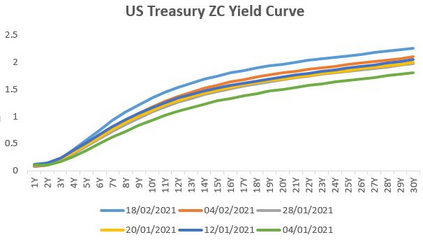

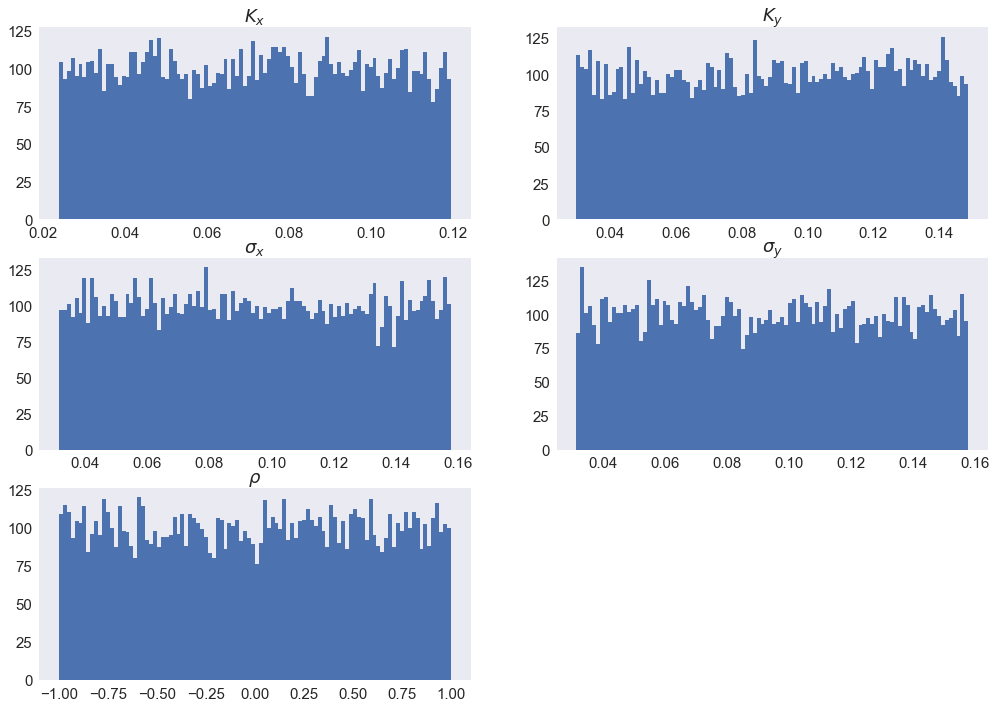

For any financial institution it is a necessity to be able to apprehend the behavior of interest rates. Despite the use of Deep Learning that is growing very fastly, due to many reasons (expertise, ease of use, ...) classic rates models such as CIR, or the Gaussian family are still being used widely. We propose to calibrate the five parameters of the G2++ model using Neural Networks. To achieve that, we construct synthetic data sets of parameters drawn uniformly from a reference set of parameters calibrated from the market. From those parameters, we compute Zero-Coupon and Forward rates and their covariances and correlations. Our first model is a Fully Connected Neural network and uses only covariances and correlations. We show that covariances are more suited to the problem than correlations. The second model is a Convulutional Neural Network using only Zero-Coupon rates with no transformation. The methods we propose perform very quickly (less than 0.3 seconds for 2 000 calibrations) and have low errors and good fitting.

翻译:对于任何金融机构来说,都有必要能够掌握利率的行为。尽管由于多种原因(专长、使用方便、.),深层学习的使用正在迅速发展,但由于许多原因(专长、使用方便、.),CIR等典型利率模型或高西亚家族仍在广泛使用。我们提议使用神经网络校准G2++模型的五个参数。为了做到这一点,我们建造了一套综合参数数据集,这些参数统一地取自从市场上校准的一套参考参数。我们根据这些参数计算Zero-Coupon和前期利率及其变量和关联。我们的第一个模型是一个完全连接的神经网络,仅使用共变和关联。我们显示共变比相关性更适合问题。第二个模型是一个共振神经网络,仅使用Zero-Coubon率,而没有变异。我们提出的方法非常迅速(在2 000个校准中不到0.3秒),而且差少,而且适合。