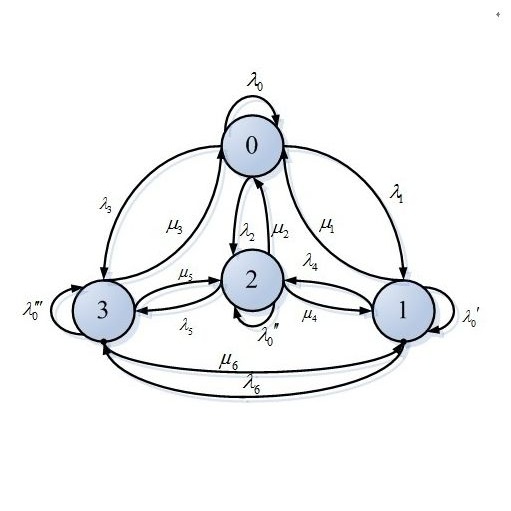

Data augmentation (DA) algorithms are widely used for Bayesian inference due to their simplicity. In massive data settings, however, DA algorithms are prohibitively slow because they pass through the full data in any iteration, imposing serious restrictions on their usage despite the advantages. Addressing this problem, we develop a framework for extending any DA that exploits asynchronous and distributed computing. The extended DA algorithm is indexed by a parameter $r \in (0, 1)$ and is called Asynchronous and Distributed (AD) DA with the original DA as its parent. Any ADDA starts by dividing the full data into $k$ smaller disjoint subsets and storing them on $k$ processes, which could be machines or processors. Every iteration of ADDA augments only an $r$-fraction of the $k$ data subsets with some positive probability and leaves the remaining $(1-r)$-fraction of the augmented data unchanged. The parameter draws are obtained using the $r$-fraction of new and $(1-r)$-fraction of old augmented data. For many choices of $k$ and $r$, the fractional updates of ADDA lead to a significant speed-up over the parent DA in massive data settings, and it reduces to the distributed version of its parent DA when $r=1$. We show that the ADDA Markov chain is Harris ergodic with the desired stationary distribution under mild conditions on the parent DA algorithm. We demonstrate the numerical advantages of the ADDA in three representative examples corresponding to different kinds of massive data settings encountered in applications. In all these examples, our DA generalization is significantly faster than its parent DA algorithm for all the choices of $k$ and $r$. We also establish geometric ergodicity of the ADDA Markov chain for all three examples, which in turn yields asymptotically valid standard errors for estimates of desired posterior quantities.

翻译:数据增强( DA) 算法由于简单化而被广泛用于 Bayesian 推理 。 但是, 在大规模数据设置中, DA 算法之所以极其缓慢,是因为在任何迭代中通过完整的数据,尽管有各种优点,但对数据的使用施加了严格的限制。 解决这个问题, 我们开发了一个框架, 用来扩展任何利用非同步和分布式计算方法的 DA 算法。 扩展的 DA 算法被一个参数 $ (0, 1美元) 索引, 称为 Asynchronous (ADA) 和 DA (A) 。 任何 ADA 算法的计算方法, 开始将全部数据分为美元, 将全部数据分为美元, 以小的 DA (1 美元), 将其储存到 $ (DA ) 的缩放数据中。