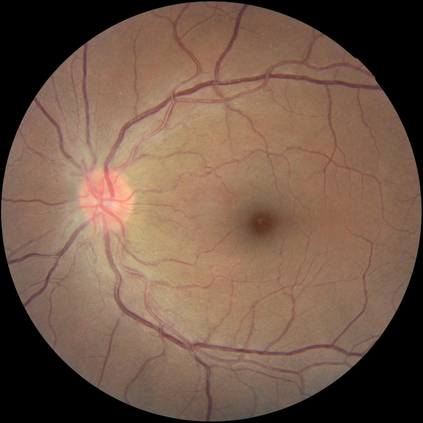

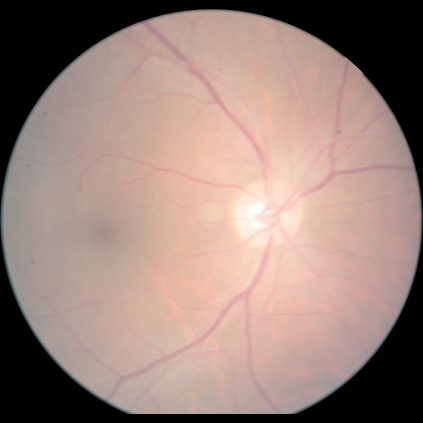

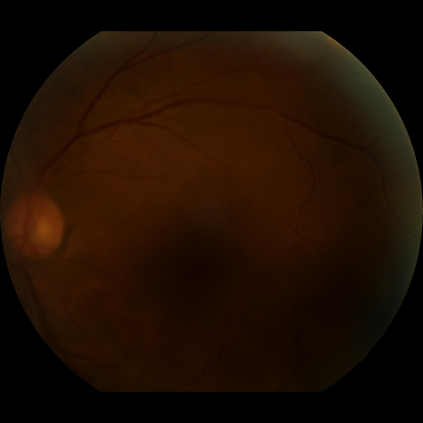

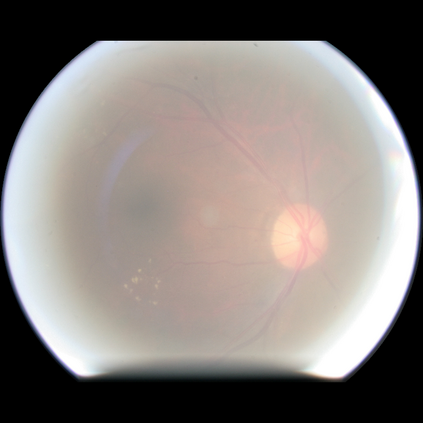

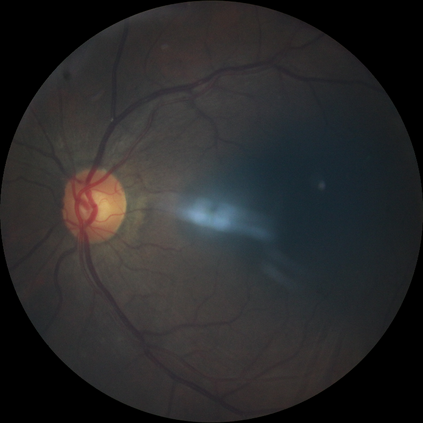

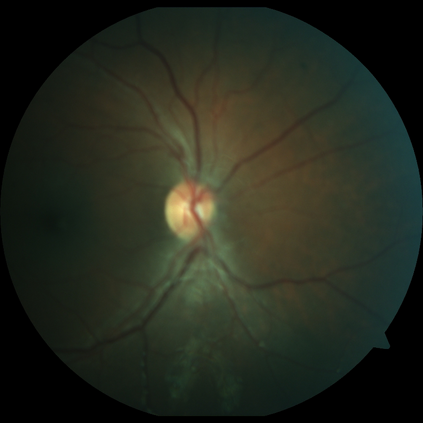

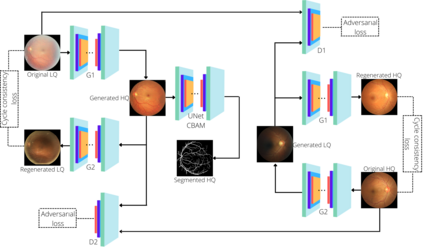

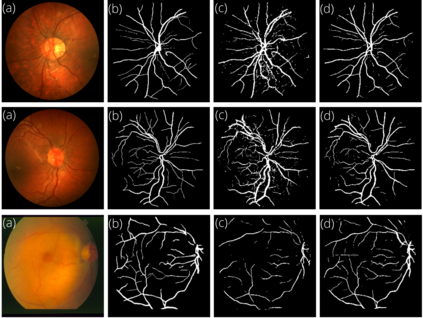

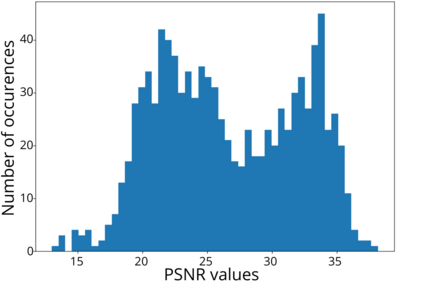

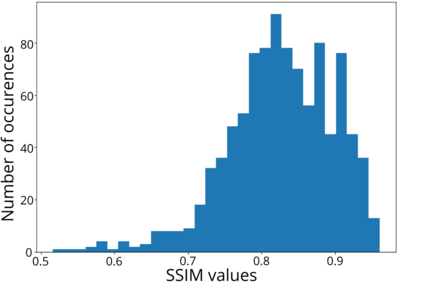

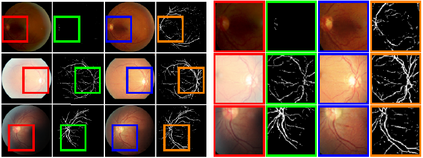

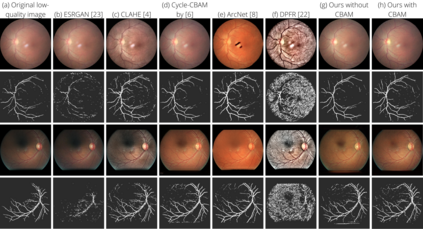

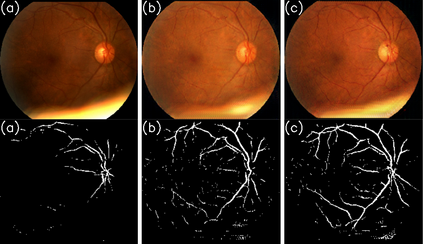

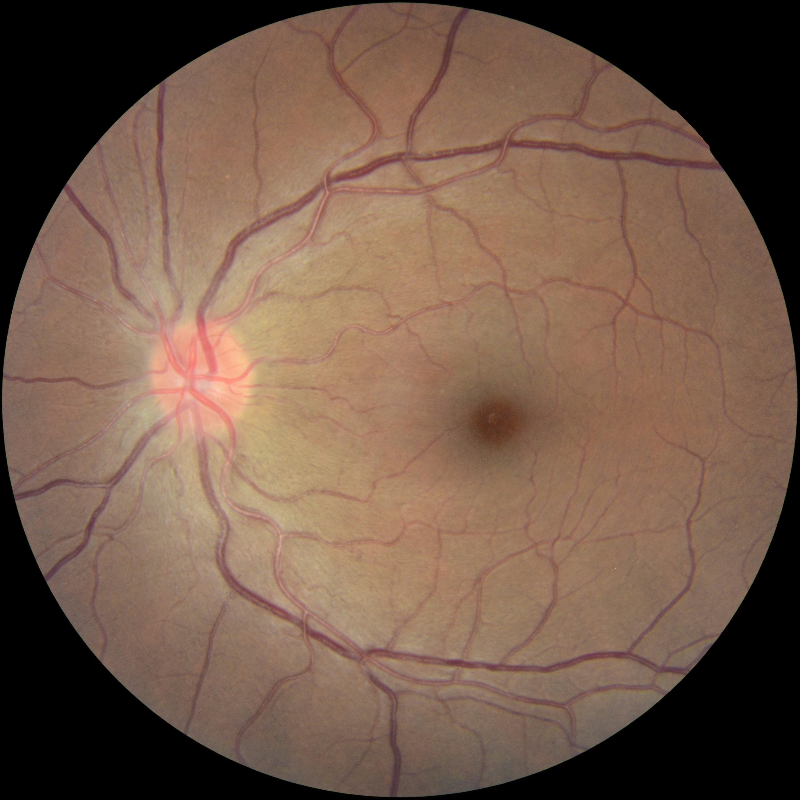

Clinical screening with low-quality fundus images is challenging and significantly leads to misdiagnosis. This paper addresses the issue of improving the retinal image quality and vessel segmentation through retinal image restoration. More specifically, a cycle-consistent generative adversarial network (CycleGAN) with a convolution block attention module (CBAM) is used for retinal image restoration. A modified UNet is used for retinal vessel segmentation for the restored retinal images (CBAM-UNet). The proposed model consists of two generators and two discriminators. Generators translate images from one domain to another, i.e., from low to high quality and vice versa. Discriminators classify generated and original images. The retinal vessel segmentation model uses downsampling, bottlenecking, and upsampling layers to generate segmented images. The CBAM has been used to enhance the feature extraction of these models. The proposed method does not require paired image datasets, which are challenging to produce. Instead, it uses unpaired data that consists of low- and high-quality fundus images retrieved from publicly available datasets. The restoration performance of the proposed method was evaluated using full-reference evaluation metrics, e.g., peak signal-to-noise ratio (PSNR) and structural similarity index measure (SSIM). The retinal vessel segmentation performance was compared with the ground-truth fundus images. The proposed method can significantly reduce the degradation effects caused by out-of-focus blurring, color distortion, low, high, and uneven illumination. Experimental results show the effectiveness of the proposed method for retinal image restoration and vessel segmentation.

翻译:以低质量的基金形图像进行临床筛选具有挑战性,并在很大程度上导致误判。本文件述及通过视网膜图像恢复来改善视网膜图像质量和容器分离率的问题。 更具体地说, 使用循环兼容的基因对抗网络( CycleGAN ), 配有相容区块关注模块( CBAM ) 来恢复视网膜图像。 修改后的UNet 用于恢复视网膜图像( CBAM-UNet ) 的视网膜分离。 提议的模型由两个生成器和两个分析器组成。 发电机将图像从一个域转换成另一个域, 即从低质量到高质量和反向转化。 差异分析器将生成的和原始图像进行分类分类。 矩形结构分割模型使用下标、 平整的图像重新校正、 模型的重新校正评估, 将现有的低和高质量的图像重新校正。 提议的方法可以大量恢复。