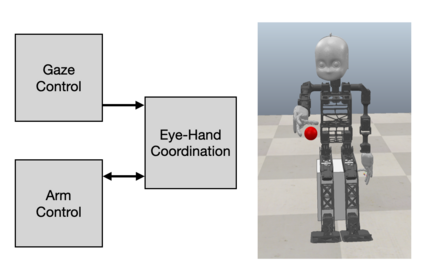

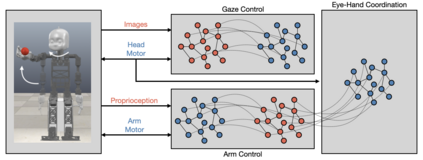

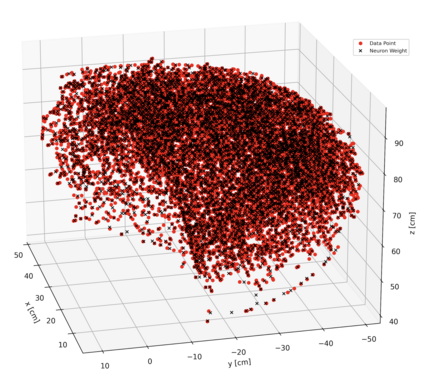

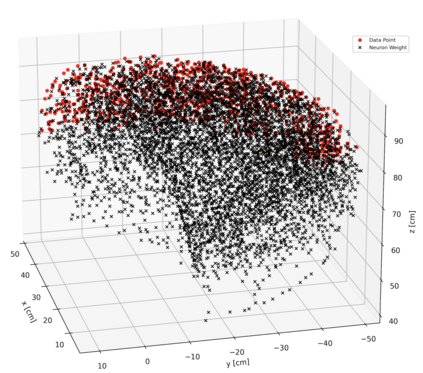

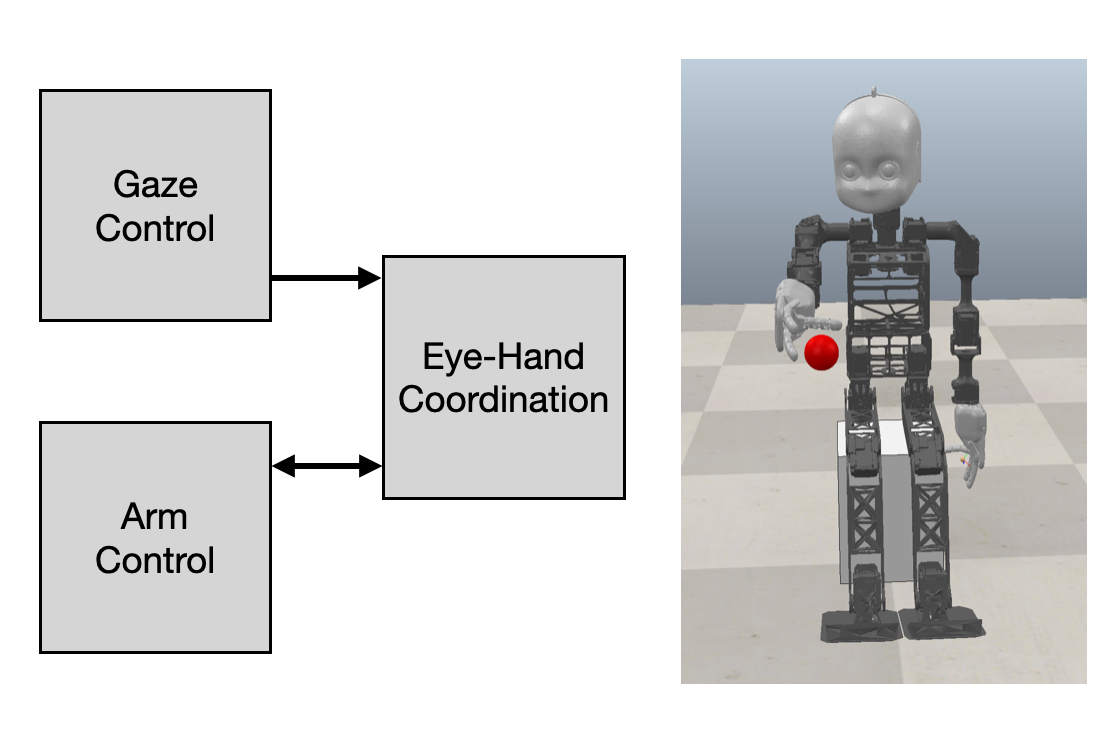

The act of reaching for an object is a fundamental yet complex skill for a robotic agent, requiring a high degree of visuomotor control and coordination. In consideration of dynamic environments, a robot capable of autonomously adapting to novel situations is desired. In this paper, a developmental robotics approach is used to autonomously learn visuomotor coordination on the NICO (Neuro-Inspired COmpanion) platform, for the task of object reaching. The robot interacts with its environment and learns associations between motor commands and temporally correlated sensory perceptions based on Hebbian learning. Multiple Grow-When-Required (GWR) networks are used to learn increasingly more complex motoric behaviors, by first learning how to direct the gaze towards a visual stimulus, followed by learning motor control of the arm, and finally learning how to reach for an object using eye-hand coordination. We demonstrate that the model is able to deal with an unforeseen mechanical change in the NICO's body, showing the adaptability of the proposed approach. In evaluations of our approach, we show that the humanoid robot NICO is able to reach objects with a 76% success rate.

翻译:获取对象的行为是机器人代理人的一项基本而复杂的技能,需要高度的相对摩托控制和协调。考虑到动态环境,需要有一种能够自主适应新情况的机器人。在本文中,开发机器人的方法用于自主学习对 NICO (Neuro-Imissed COmpanion) 平台的相对摩托协调,以完成物体到达的任务。机器人与环境互动,学习运动指令与基于 Hebbian 学习的与时间相关的感官感知之间的关联。多种成熟时间要求(GWR) 网络被用来学习日益复杂的运动行为,首先学习如何将视线导向视觉刺激,然后学习对手臂的运动控制,最后学习如何利用双眼协调达到物体。我们证明该模型能够应对NICO 身体中意外的机械变化,显示拟议方法的适应性。在评估我们的方法时,我们显示人形机器人NICO能够以76%的成功率到达物体。