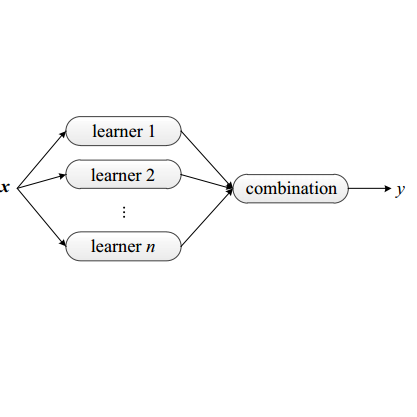

This paper describes our system for SemEval-2021 Task 5 on Toxic Spans Detection. We developed ensemble models using BERT-based neural architectures and post-processing to combine tokens into spans. We evaluated several pre-trained language models using various ensemble techniques for toxic span identification and achieved sizable improvements over our baseline fine-tuned BERT models. Finally, our system obtained a F1-score of 67.55% on test data.

翻译:本文介绍我们的SemEval 2021任务5系统,该任务5涉及有毒螺旋探测。我们利用基于BERT的神经结构和后处理,开发了混合模型,将标志整合到各个区域。我们用各种有毒环状识别的混合技术评估了若干经过训练的语文模型,并大大改进了我们经过精细调整的BERT基准模型。最后,我们的系统在测试数据方面获得了67.55%的F1分数。

相关内容

专知会员服务

54+阅读 · 2020年1月30日

Arxiv

7+阅读 · 2019年9月17日

Arxiv

5+阅读 · 2019年5月20日

Arxiv

7+阅读 · 2019年2月3日