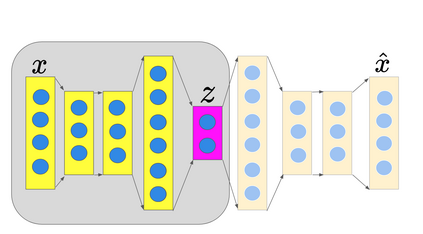

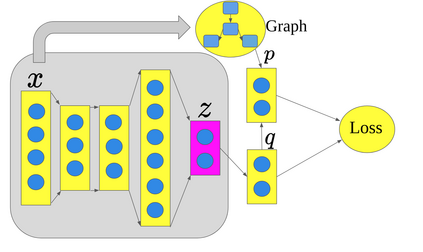

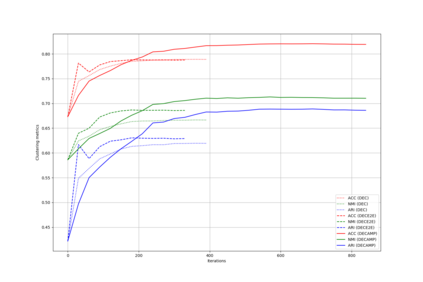

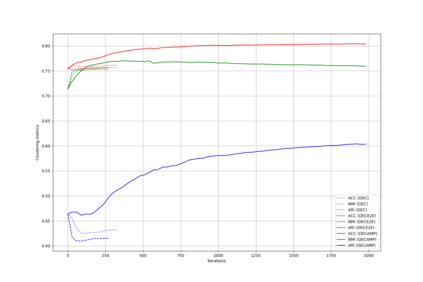

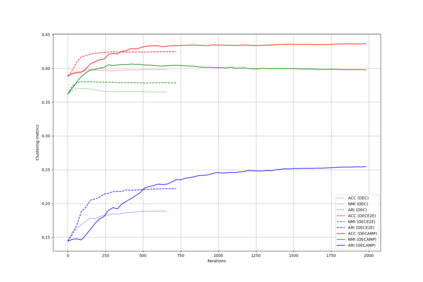

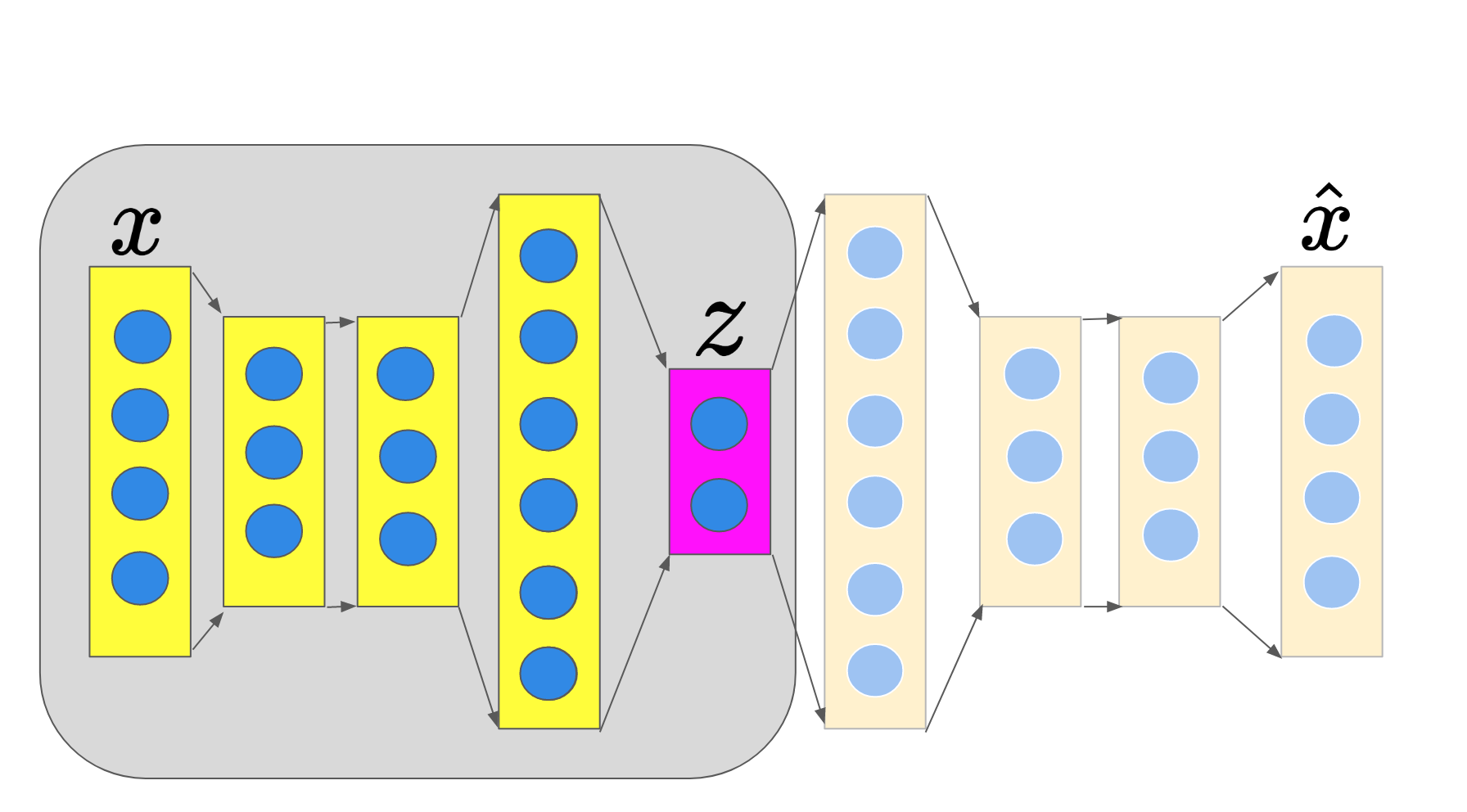

Deep models have improved state-of-the-art for both supervised and unsupervised learning. For example, deep embedded clustering (DEC) has greatly improved the unsupervised clustering performance, by using stacked autoencoders for representation learning. However, one weakness of deep modeling is that the local neighborhood structure in the original space is not necessarily preserved in the latent space. To preserve local geometry, various methods have been proposed in the supervised and semi-supervised learning literature (e.g., spectral clustering and label propagation) using graph Laplacian regularization. In this paper, we combine the strength of deep representation learning with measure propagation (MP), a KL-divergence based graph regularization method originally used in the semi-supervised scenario. The main assumption of MP is that if two data points are close in the original space, they are likely to belong to the same class, measured by KL-divergence of class membership distribution. By taking the same assumption in the unsupervised learning scenario, we propose our Deep Embedded Clustering Aided by Measure Propagation (DECAMP) model. We evaluate DECAMP on short text clustering tasks. On three public datasets, DECAMP performs competitively with other state-of-the-art baselines, including baselines using additional data to generate word embeddings used in the clustering process. As an example, on the Stackoverflow dataset, DECAMP achieved a clustering accuracy of 79%, which is about 5% higher than all existing baselines. These empirical results suggest that DECAMP is a very effective method for unsupervised learning.

翻译:深层模型改进了监督和不受监督学习的先进技术。 例如,深嵌集(DEC)通过使用堆叠自动编码器进行演示学习,大大提高了未经监督的集群性能。 但是,深层模型的一个弱点是原始空间的本地周边结构不一定保存在潜在空间。为了保存本地几何,在使用图表 Laplacian 正规化的监管和半监管的基线学习文献(如光谱集群和标签传播)中提出了各种方法。在本文中,我们将深度代表性学习的强度与测量传播(MP)相结合,这是一种基于 KL-diverence的图形正规化方法,最初在半监督情景中使用。但是,深度模型的一个弱点是,如果最初空间中有两个数据点不一定要保存在原始空间中,那么它们可能属于同一类,用KL-D-D的分类分布测量。在未经监督的学习假设中采用同样的假设,我们建议我们深嵌入的集群组合,通过测量 Propagation(DEAMP) 的快速数据传播(KAs-D- droad grow) 模型模型模型模型,我们用的是其他的DMP 数据基底数据基模型来进行。