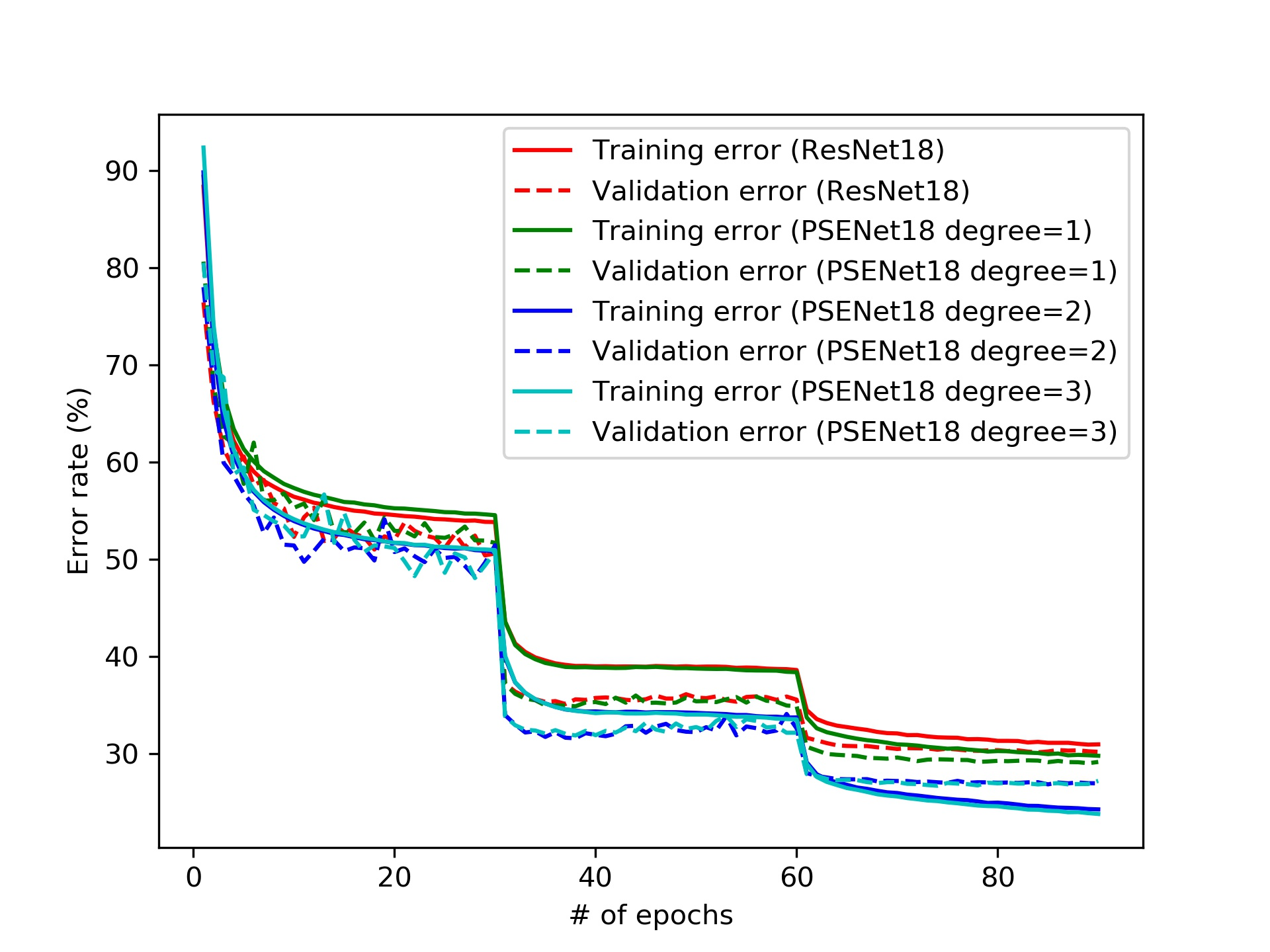

In this paper, we develop a new neural network family based on power series expansion, which is proved to achieve a better approximation accuracy in comparison with existing neural networks. This new set of neural networks embeds the power series expansion (PSE) into the neural network structure. Then it can improve the representation ability while preserving comparable computational cost by increasing the degree of PSE instead of increasing the depth or width. Both theoretical approximation and numerical results show the advantages of this new neural network.

翻译:在本文中,我们开发了一个新的基于电力序列扩展的神经网络大家庭,这证明与现有的神经网络相比,可以实现更好的近似准确性。这组新的神经网络将电力序列扩展嵌入神经网络结构。然后它可以通过提高PSE的深度而不是扩大深度或宽度来提高可比较的计算成本,从而提高代表能力,同时保持可比的计算成本。理论近似和数字结果都显示了这一新神经网络的优势。

相关内容

神经网络(Neural Networks)是世界上三个最古老的神经建模学会的档案期刊:国际神经网络学会(INNS)、欧洲神经网络学会(ENNS)和日本神经网络学会(JNNS)。神经网络提供了一个论坛,以发展和培育一个国际社会的学者和实践者感兴趣的所有方面的神经网络和相关方法的计算智能。神经网络欢迎高质量论文的提交,有助于全面的神经网络研究,从行为和大脑建模,学习算法,通过数学和计算分析,系统的工程和技术应用,大量使用神经网络的概念和技术。这一独特而广泛的范围促进了生物和技术研究之间的思想交流,并有助于促进对生物启发的计算智能感兴趣的跨学科社区的发展。因此,神经网络编委会代表的专家领域包括心理学,神经生物学,计算机科学,工程,数学,物理。该杂志发表文章、信件和评论以及给编辑的信件、社论、时事、软件调查和专利信息。文章发表在五个部分之一:认知科学,神经科学,学习系统,数学和计算分析、工程和应用。

官网地址:http://dblp.uni-trier.de/db/journals/nn/

专知会员服务

60+阅读 · 2020年6月28日

专知会员服务

16+阅读 · 2019年11月30日