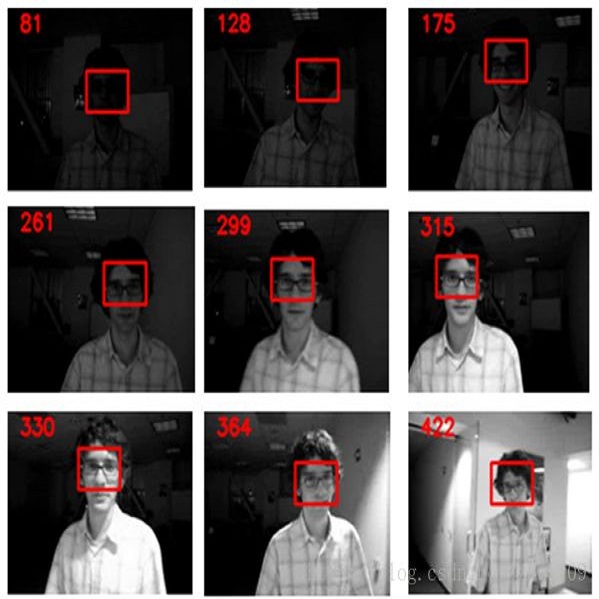

Event cameras are novel sensors that perceive the per-pixel intensity changes and output asynchronous event streams, showing lots of advantages over traditional cameras, such as high dynamic range (HDR) and no motion blur. It has been shown that events alone can be used for object tracking by motion compensation or prediction. However, existing methods assume that the target always moves and is the stand-alone object. Moreover, they fail to track the stopped non-independent moving objects on fixed scenes. In this paper, we propose a novel event-based object tracking framework, called SiamEvent, using Siamese networks via edge-aware similarity learning. Importantly, to find the part having the most similar edge structure of target, we propose to correlate the embedded events at two timestamps to compute the target edge similarity. The Siamese network enables tracking arbitrary target edge by finding the part with the highest similarity score. This extends the possibility of event-based object tracking applied not only for the independent stand-alone moving objects, but also for various settings of the camera and scenes. In addition, target edge initialization and edge detector are also proposed to prevent SiamEvent from the drifting problem. Lastly, we built an open dataset including various synthetic and real scenes to train and evaluate SiamEvent. Extensive experiments demonstrate that SiamEvent achieves up to 15% tracking performance enhancement than the baselines on the real-world scenes and more robust tracking performance in the challenging HDR and motion blur conditions.

翻译:活动相机是新颖的感应器,它能感知每像素强度变化和输出的同步事件流,显示与传统相机相比的许多优势,例如高动态范围(HDR)和没有运动模糊。已经显示,只有事件本身可以使用运动补偿或预测来跟踪物体。但是,现有的方法假设目标总是移动,并且是独立对象。此外,它们无法跟踪固定场景上被停止的非独立移动对象。在本文中,我们提议建立一个新型的事件跟踪框架,称为SiamEvent,通过边缘认知相似性学习使用Siamese网络。重要的是,为了找到目标最相似的边缘结构,我们提议在两个时间点将嵌入的事件联系起来,通过运动补偿或预测来跟踪目标的边缘。但是,现有的方法假设目标总是移动,并且是独立且不独立的非独立的移动对象。在固定场景上,我们提议一个基于事件的模糊对象跟踪框架,不仅适用于独立的独立移动对象,而且适用于各种相机和场景的设置。此外,在目标边缘初始初始和边缘探测器上,还有最相似的初始和边缘跟踪环境,我们所建的初始的初始和边缘探测器,还提议在两个轨道上进行SiamBrial的跟踪,以便,以便演示测测测测测测测测测,,以真实的测测测测测测,以整个,以整个,以真实的轨测测测测测测到整个,以真实的轨道,以真实的测,以真实性测。最后的测测测到整个,以真实性测到整个,以真实性测,以整个,以真实的轨测测测算。