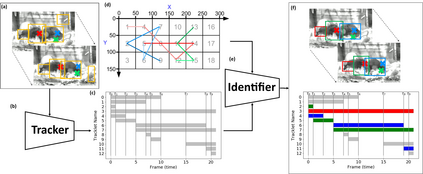

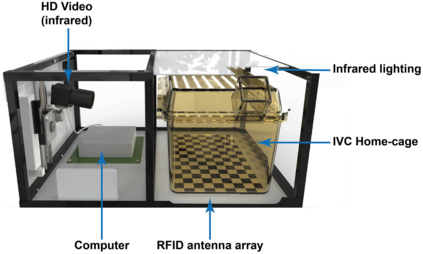

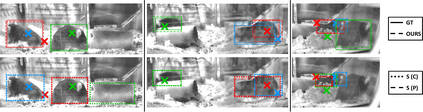

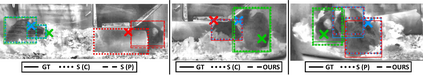

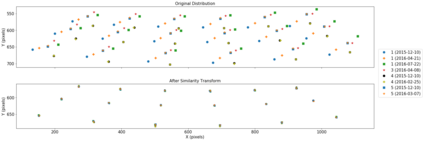

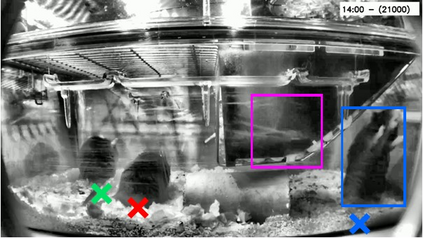

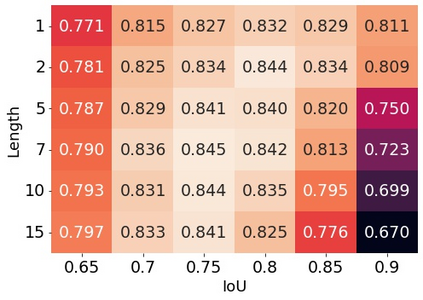

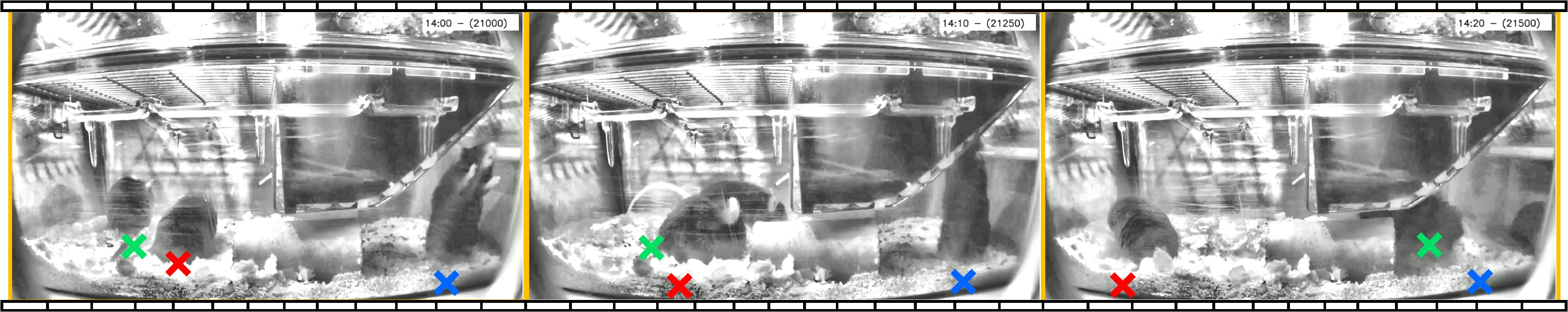

Our objective is to locate and provide a unique identifier for each mouse in a cluttered home-cage environment through time, as a precursor to automated behaviour recognition for biological research. This is a very challenging problem due to (i) the lack of distinguishing visual features for each mouse, and (ii) the close confines of the scene with constant occlusion, making standard visual tracking approaches unusable. However, a coarse estimate of each mouse's location is available from a unique RFID implant, so there is the potential to optimally combine information from (weak) tracking with coarse information on identity. To achieve our objective, we make the following key contributions: (a) the formulation of the object identification problem as an assignment problem (solved using Integer Linear Programming), and (b) a novel probabilistic model of the affinity between tracklets and RFID data. The latter is a crucial part of the model, as it provides a principled probabilistic treatment of object detections given coarse localisation. Our approach achieves 77% accuracy on this animal identification problem, and is able to reject spurious detections when the animals are hidden.

翻译:我们的目标是为每个鼠鼠寻找并提供一个独特的识别标志,在混乱的家庭笼子里,随着时间的推移,作为生物研究自动行为识别的前奏。这是一个非常具有挑战性的问题,因为(一) 缺乏对每个鼠的辨别性,以及(二) 场景的近距离,不断隔离,使得标准目视跟踪方法无法使用。然而,对每个鼠标位置的粗略估计来自独特的RFID植入,因此有可能最佳地将来自(弱)跟踪的信息与关于身份的粗糙信息结合起来。为了实现我们的目标,我们做出了以下关键贡献:(a) 将物体识别问题表述为指派问题(使用Integer线性编程),以及(b) 轨迹和RFID数据之间的近似性新颖的概率模型。后者是模型的一个关键部分,因为它提供了一种有原则的概率性处理方法,即以粗糙的本地化为特征的物体探测方法。我们的方法在动物识别问题上达到了77%的精确度,并且能够拒绝在动物是隐藏的动物时进行虚假的探测。