美国空军研究实验室《概率标签高效的深度生成结构(PLEDGES)》71页重点项目技术报告

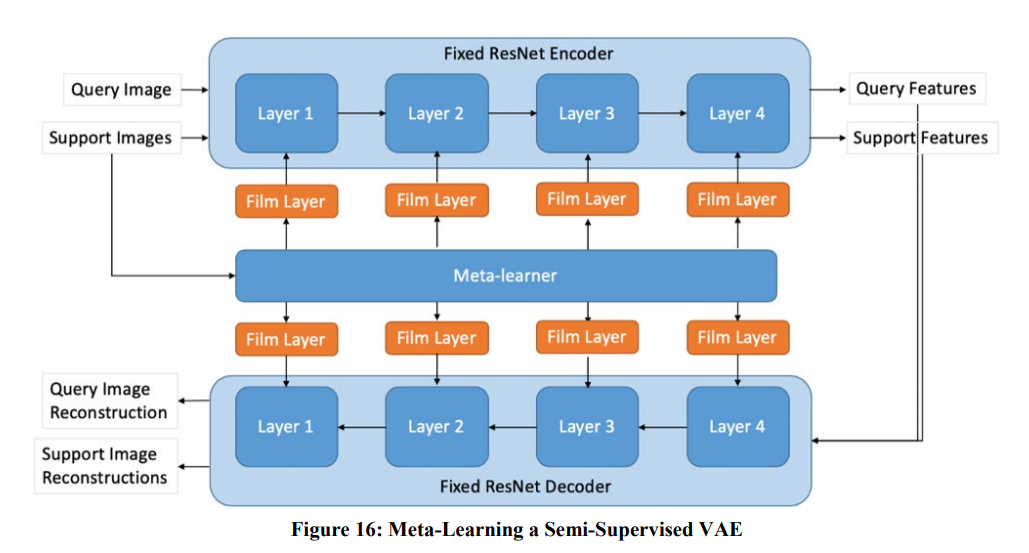

技术方法

技术目标

相关工作

专知便捷查看

便捷下载,请关注专知人工智能公众号(点击上方蓝色专知关注)

后台回复“PLED” 就可以获取《美国空军研究实验室《概率标签高效的深度生成结构(PLEDGES)》71页重点项目技术报告》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年9月12日

Arxiv

0+阅读 · 2022年9月9日

Arxiv

0+阅读 · 2022年9月9日