基于数据的分布式鲁棒优化算法及其应用【附PPT与视频资料】

关注文章公众号

回复"王卓琳"获取PPT与视频资料

视频资料可点击下方阅读原文在线观看

导读

鲁棒优化以及分布鲁棒优化问题已经成为当今优化领域的研究热点,在金融,调度以及机器学习等领域中都有着广泛的应用。本文主要介绍基于数据的分布鲁棒优化算法中的建模及其具体应用。

作者简介

王卓琳,清华大学自动化系在读博士,本科毕业于北京师范大学信息科学与技术专业,目前主要研究方向为鲁棒优化及其应用。

王卓琳

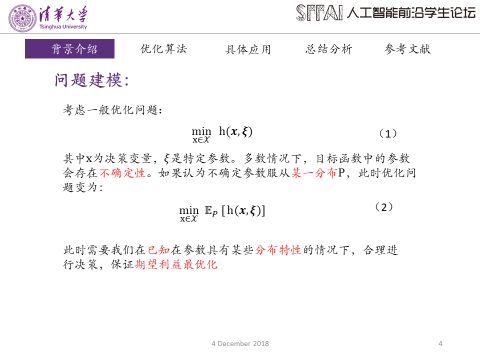

1、背景介绍

分布鲁棒优化问题是当前优化领域一个很重要的研究问题,在金融的投资组合理论,库存管理等问题以及机器学习中回归问题,分类问题中都有广泛的应用[1]。该研究问题的主要目标是,在

目标函数中参数以及其对应分布都具有不确定性时,如何对问题进行优化以获得鲁棒解:

2、优化算法

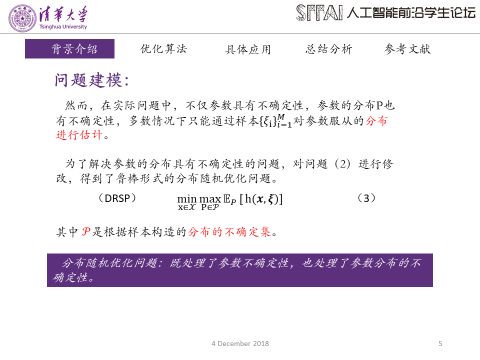

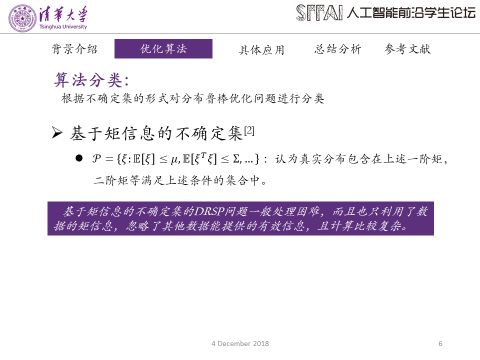

分布鲁棒优化算法的关键在于如何构建分布的不确定集,根据不确定集的形式可以对算法进行分类。

基于矩信息的不确定集[2]认为真实分布包含在一阶矩,二阶矩等满足一定条件的集合中,DRSP问题一般处理困难,只利用了数据的矩信息,忽略了其他数据能提供的有效信息,且计算比较复杂。

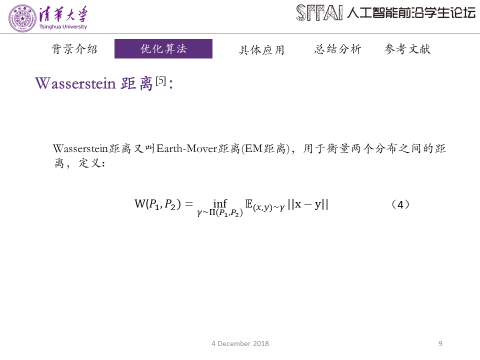

另一种常用的方法是利用概率距离构建分布的不确定集,其中Wasserstein距离[3]是一种常用的度量方式,把一个分布P“迁移”成另一个分布Q所需要的最小距离即为两个分布的Wasserstein距离。Wasserstein 距离不仅可以用在分布鲁棒优化问题中。目前有研究人员把它也用在了生成对抗网络里,解决了很多问题

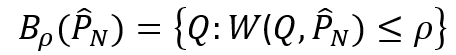

选定概率之间的距离度量后,就可以定义优化问题中的对应的不确定集:

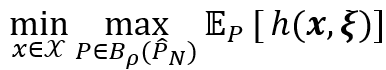

直观上可以认为该不确定集是以经验分布中心,半径为的一个球,球中包含了所有可能的概率分布。基于该不确定集,分布鲁棒优化问题此时可以建模成:

上述问题是一个无限维的优化问题,一般较难求解,但在文献[3]中说明,当目标函数满足一定条件时,分布优化问题可以转化为有限维的凸优化问题,此时问题可以利用现有优化技术进行求解。

3、应用

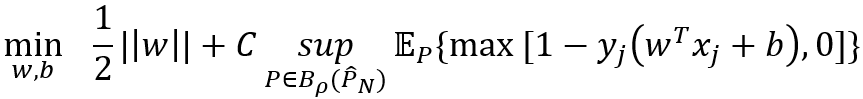

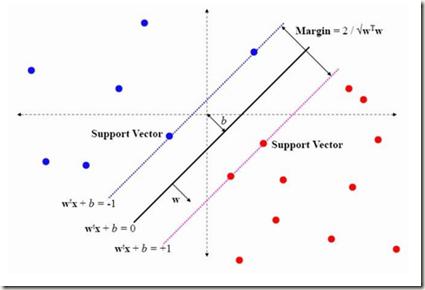

以机器学习中的经典分类器支持向量机(SVM)为例,认为训练样本具有不确定性且服从某一未知分布,考虑以下基于Wasserstein不确定集的分布鲁棒优化SVM问题:

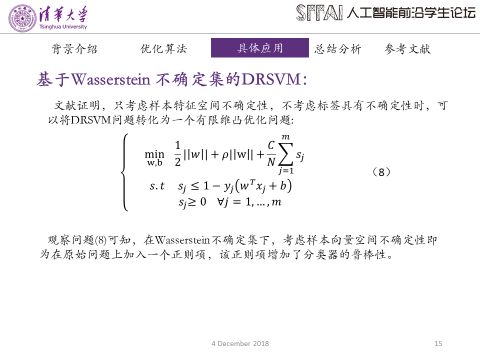

文献[4]表明,在只考虑样本向量空间不确定性而不考虑标签不确定性时,可以将上述分布鲁棒优化SVM问题转换为增加了一个正则项的软间隔SVM问题:

4、总结分析

此次分享和大家介绍了鲁棒优化和分布鲁棒优化的概率,也介绍了构建分布鲁棒优化问题中不确定集的方法。重点介绍了Wasserstein不确定集以及在此不确定集下分布鲁棒优化算法的建模和应用。

5、参考文献

[1] Bertsimas D, Brown D B, Caramanis C.Theory and Applications of Robust Optimization[J]. Siam Review, 2010,53(3):464-501.

[2] Delage E, Ye Y. Distributionally RobustOptimization Under Moment Uncertainty with Application to Data-DrivenProblems[J]. Operations Research, 2010, 58(3):595-612.

[3] Mohajerin Esfahani P , Kuhn D .Data-driven distributionally robust optimization using the Wasserstein metric:performance guarantees and tractable reformulations[J]. MathematicalProgramming, 2018, 171(1-2):1-52.

[4] Shafieezadehabadeh S, Kuhn D, Esfahani P M. Regularization via MassTransportation[J]. 2017.

SFFAI讲者招募

为了满足人工智能不同领域研究者相互交流、彼此启发的需求,我们发起了SFFAI这个公益活动。SFFAI每周举行一期线下活动,邀请一线科研人员分享、讨论人工智能各个领域的前沿思想和最新成果,使专注于各个细分领域的研究者开拓视野、触类旁通。

SFFAI目前主要关注机器学习、计算机视觉、自然语言处理等各个人工智能垂直领域及交叉领域的前沿进展,将对线下讨论的内容进行线上传播,使后来者少踩坑,也为讲者塑造个人影响力。

SFFAI还将构建人工智能领域的知识树(AI Knowledge Tree),通过汇总各位参与者贡献的领域知识,沉淀线下分享的前沿精华,使AI Knowledge Tree枝繁叶茂,为人工智能社区做出贡献。

这项意义非凡的社区工作正在稳步向前,衷心期待和感谢您的支持与奉献!

有意加入者请与我们联系:wangxl@mustedu.cn

历史文章推荐: