【泡泡图灵智库】基于通用优化的多传感器局部里程估计框架(arXiv)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:A General Optimization-based Framework for Local Odometry Estimation with Multiple Sensors

作者:Tong Qin, Jie Pan, Shaozu Cao, and Shaojie Shen

来源:arXiv

编译:万应才

审核:李雨昊

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——Mask R-CNN,该文章发表于arXiv。

目前,越来越多的传感器安装在机器人上,以提高机器人的鲁棒性和自主能力。我们已经在不同的平台上看到了各种传感器套件,例如地面车辆上的双目摄像机、移动电话上带有IMU(惯性测量单元)的单目摄像机,以及带有IMU的双目摄像机。尽管过去提出了许多状态估计算法,但它们通常应用于单个传感器或特定的传感器套件。它们中很少有能用于多种传感器选择。本文提出了一种支持多传感器集的里程估计通用优化框架。在我们的框架中,每个传感器都被视为一个通用factor。共享公共状态变量的factor有总结并建立优化问题。我们进一步论证了视觉和惯性传感器的普遍性,它们构成三个传感器套件(双目摄像机、带IMU的单眼摄像机和带IMU的双目摄像机)。我们在公共数据集上和通过多传感器的实际实验验证了系统的性能。结果与其他最先进的算法进行了比较。我们强调,我们的系统是一个通用的框架,可以很容易地融合各种传感器在一个姿势图优化。我们的实现是开放源码

code:https://github.com/HKUST-Aerial-Robotics/VINS-Fusion

主要贡献

1. 一个通用的基于优化的状态估计框架,支持多个传感器。

2.使用视觉和惯性传感器进行状态估计的详细演示,这些传感器构成不同的传感器套件(双目摄像头、单目摄像头+IMU和双目摄像头+IMU)。

3.在公共数据集和实际实验上评估提出的系统并开源了代码。

算法流程

1.算法整体框架

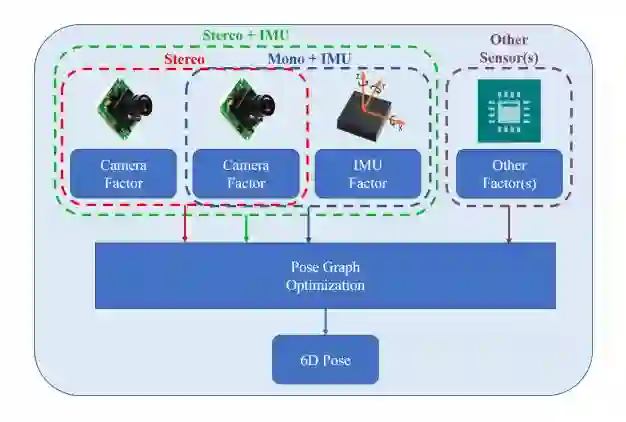

图1 状态估计框架的图示,它支持多种传感器选择,如双目摄像机、带IMU的单目摄像机和带IMU的双目摄像机。每个传感器都被视为一个通用因子。将共享公共状态变量的因子汇总在一起,建立优化问题。

由于大多数传统算法都是针对单个传感器或特定的传感器集而设计的,因此它们不能移植到不同的平台。即使对于一个平台,我们也需要在不同的场景中选择不同的传感器组合。因此,需要一种支持不同传感器套件的通用算法。另一个实际要求是,如果传感器出现故障,应移除一个不活动的传感器,并快速将另一个传感器添加到系统中。因此,需要一种与多传感器兼容的通用算法。

本文提出了一种通用的基于优化的姿态估计框架,该框架支持多传感器组合。我们进一步用视觉和惯性传感器来完善它,它们构成三个传感器套件(双目摄像机、带IMU的单目摄像机和带IMU的双目摄像机)。

2.姿势图表示

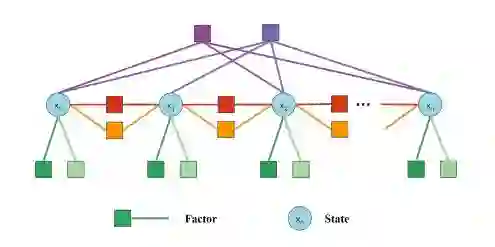

图2 姿态图。每个节点表示一个时刻的状态(位置、方向、速度等)。每个边代表一个因子,通过一次测量得出。边约束一个状态、两个状态或多个状态。将各传感器的测量值作为一个通用因子,因子及其相关状态构成姿态图。

姿态图如图2所示。每个节点表示一个时刻的状态(位置、方向、速度等)。每个边代表一个因子,通过一次测量得出。因子约束一个状态、两个状态或多个状态。对于IMU因子,它通过连续运动约束来约束两个连续状态。对于可视地标,其因子约束多个状态,因为它在多个帧上被观察到。一旦建立了图,优化它就等于找到尽可能匹配所有边的节点配置。

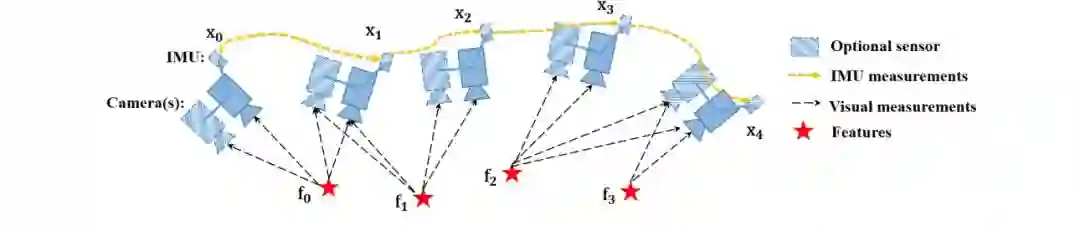

图3 带有视觉和惯性传感器的架的图示。IMU和其中一个摄像头是可选的。因此,它形成三种类型(双目摄像机、带IMU的单眼摄像机和带IMU的双目摄像机)。姿态图中存在几种相机姿态、IMU测量和视觉测量。

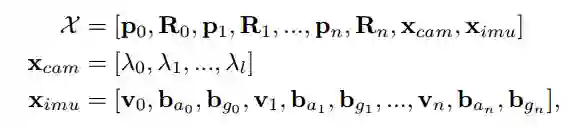

3. 状态表示.

X代表世界坐标,Xcam代表相机状态,Ximu代表IMU状态.

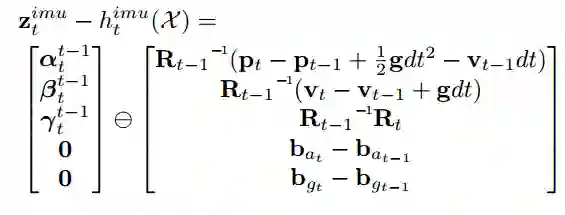

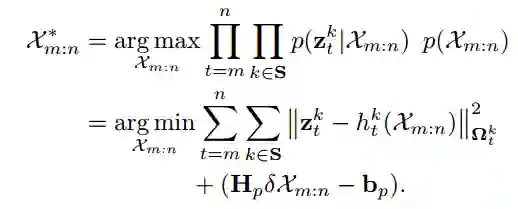

4.Cost Function

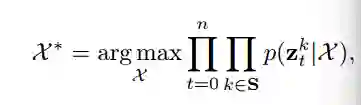

状态估计的本质是一个极大似然估计问题。MLE由机器人姿态在一段时间内的联合概率分布组成。假设所有的测量都是独立的,这个问题通常是可以看做高斯分布:

5.传感器组成

传感器组成可分为,相机和IMU两种.

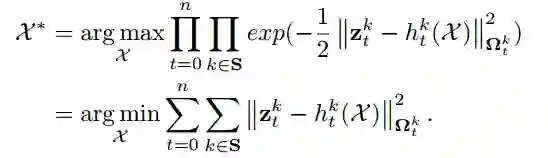

1)相机.该框架支持单眼和双目摄像机。每个摄像机的固有参数和摄像机之间的非固有变换应该是已知的,可以很容易地离线校准。考虑到图像i中首次观测到的特征l,以下图像t中观测的剩余量定义为:

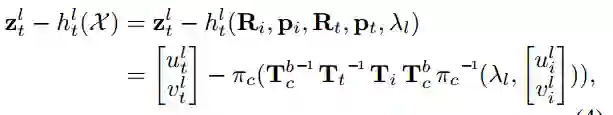

2) IMU.假设加速度和陀螺仪测量中的加性噪声是高斯白噪声。将时变加速度和陀螺偏压模拟为随机游动过程,其导数为高斯白噪声。由于IMU以比其他传感器更高的频率获取数据,因此通常在两个帧之间存在多个IMU测量。因此,我们对具有协方差传播的流形上的IMU测量进行了预积分。IMU积分形式可以表示为:

3)其他传感器.虽然我们只指定相机和IMU因素,但我们的系统不限于这两个传感器。其他传感器,如车轮速度计、激光雷达和雷达,可以不费吹灰之力就添加到我们的系统中。关键是将这些度量建模为一般剩余因子,并将这些剩余因子添加到成本函数中。

6. 优化问题

传统的非线性估计问题通过牛顿-高斯或者L-M算法.cost function根据状态的初始估计线性化。

7.边缘化

为了约束计算的复杂性,在不丢失有用信息的情况下将边缘化合并。边缘化程序将以前的度量转换为以前的术语,保留以前的信息。 MAP问题可以总结为:

主要结果

在第一个实验中,我们将该算法与另一个最先进的公共数据集算法进行了比较。然后我们在大规模的室外环境中测试我们的系统。通过数值分析,详细说明了系统的精度。我们使用Euroc MAV视觉惯性数据集评估我们的提出的系统。

在Euroc数据集上实验

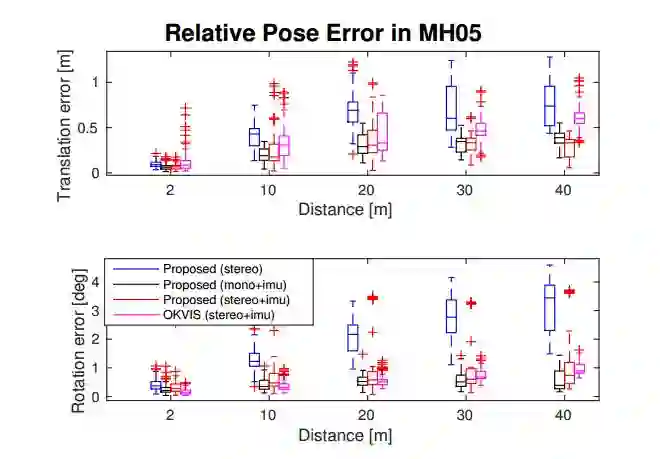

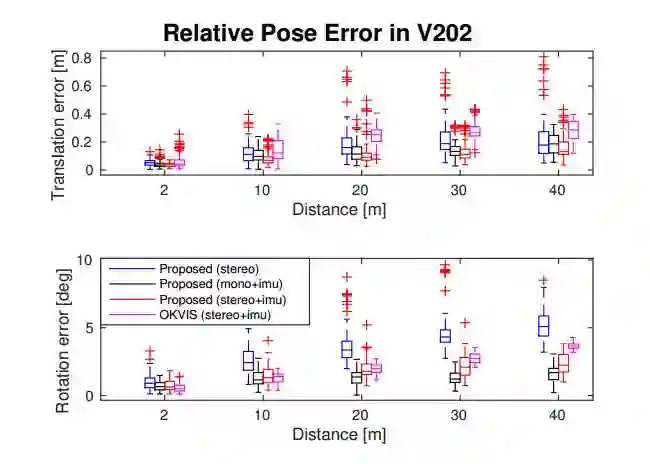

在这个实验中,我们将我们的结果与Okvis进行了比较,后者是一种最先进的VIO,可与双目摄像机和IMU配合使用。Okvis是另一种基于优化的滑动窗口算法。OKVIS是专门为视觉惯性传感器设计的,而我们的系统是一个更通用的框架,支持多种传感器组合。我们用欧洲数据集中的所有序列测试了提议的框架和OKVIS。我们用相对姿态误差和绝对轨迹误差来评估精度。RPE由[26]中提出的工具计算。图4和图5分别显示了两个序列的RPE(相对姿态误差)图,即MH 05困难和V2 02介质。

图4 相对姿态误差在MH05困难数据集上。两个图分别是平移和旋转的相对误差。

图5 V2 02介质中的相对姿态误差。两个图分别是平移和旋转的相对误差。

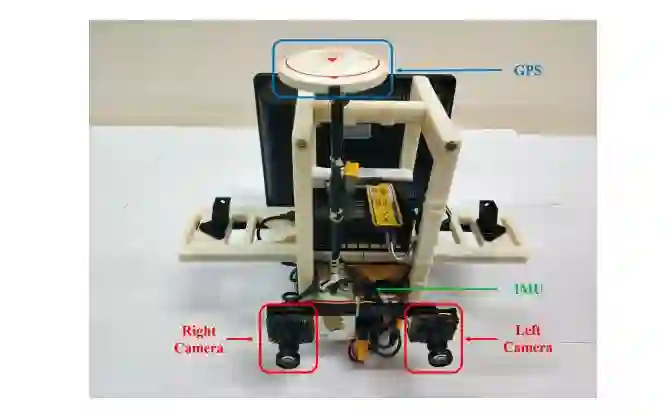

2. 户外实验

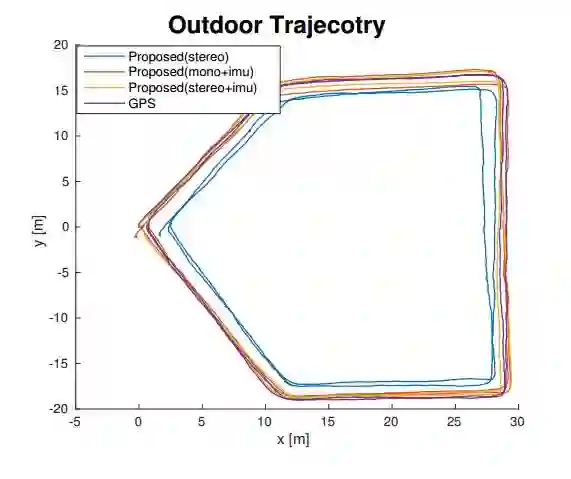

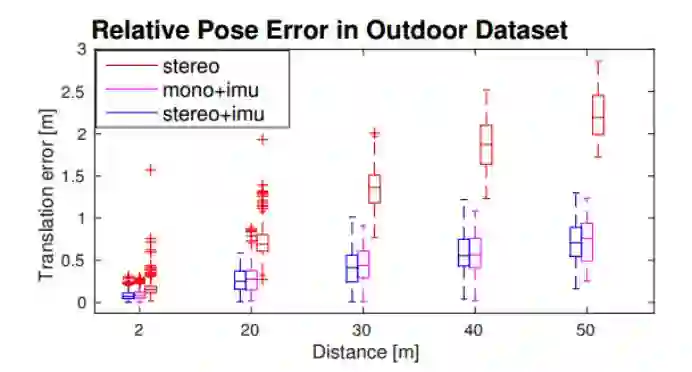

在室外地面上。我们使用三种不同的组合进行状态估计,分别是双目摄像机、带IMU的单眼摄像机和带IMU的双目摄像机。为了进行精度比较,我们在地面上走了两圈,并将我们的估计值与GPS进行了比较。轨迹如图7所示,相对姿态误差如图8所示。与数据集实验一样,只在双目场景中会出现明显的位置偏移。在IMU的帮助下,精度大大提高。涉及IMU的方法总是比仅双目效果更好。

图6 自主开发的传感器套件,用于户外环境。它包含双目摄像机(mvbluefox-mlc20w,20hz)和DJI A3控制器,其中包括内置IMU(200hz)和GPS接收器。

图7 户外实验中的估计轨迹

图8 室外实验中的相对姿态误差

Abstract

Nowadays, more and more sensors are equipped on robots to increase robustness and autonomous ability. We have seen various sensor suites equipped on different platforms,such as stereo cameras on ground vehicles, a monocular camera with an IMU (Inertial Measurement Unit) on mobile phones,and stereo cameras with an IMU on aerial robots. Although many algorithms for state estimation have been proposed in the past, they are usually applied to a single sensor or a specific sensor suite. Few of them can be employed with multiple sensor choices. In this paper, we proposed a general optimization-based framework for odometry estimation, which supports multiple sensor sets. Every sensor is treated as a general factor in our framework. Factors which share common state variables are summed together to build the optimization problem. We further demonstrate the generality with visual and inertial sensors, which form three sensor suites (stereo cameras, a monocular camera with an IMU, and stereo cameras with an IMU). We validate the performance of our system on public datasets and through real-world experiments with multiple sensors. Results are compared against other state-of-the-art algorithms. We highlight that our system is a general framework, which can easily fuse various sensors in a pose graph optimization. Our implementations are open source.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。提取码:jvqa

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com