DeepFakes=假货制造机?一文告诉你深度伪造技术的发展现状!

来源:AI科技大本营

作者:Kyle Wiggers

图:AI研究公司OpenAI的训练语言模型GPT-2的前端。 图片来源:OpenAI

图:AI研究公司OpenAI的训练语言模型GPT-2的前端。 图片来源:OpenAI

上图:使用最新方法制作的两个深度伪造视频 图片来源:SenseTime

上图:使用最新方法制作的两个深度伪造视频 图片来源:SenseTime

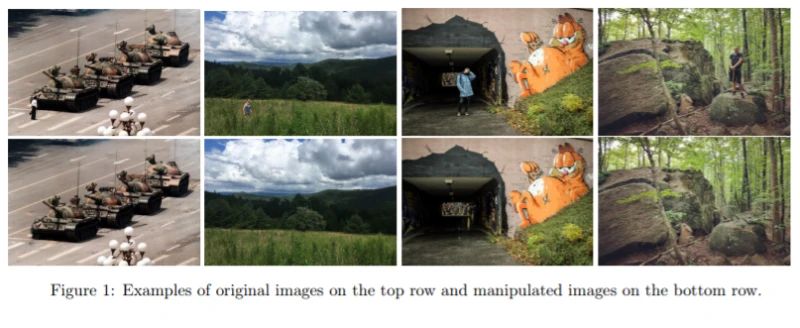

上图:人工智能系统生成的深度伪造图像

上图:人工智能系统生成的深度伪造图像

视频网址:

https://youtu.be/DWK_iYBl8cA

视频网址:

https://youtu.be/DWK_iYBl8cA

——END——