她坐在电脑前,看着屏幕里穿着露肩装,坐在床上,充满诱惑微笑着的女人。

那是她的脸,被无缝连接到了别人的身体上。一个色情片演员的身体上。

“我的朋友、同事看到会怎么想?他们会相信这视频是假的么?”她感到恶心和耻辱。

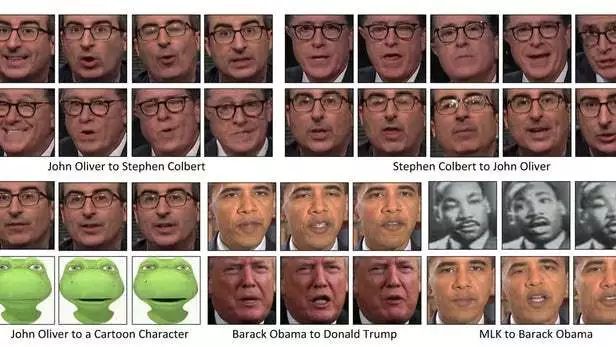

这是本周华盛顿邮报的一篇报道的开头。看到这,有些读者应该已经知道这位女性看到的这种视频是什么了。这就是从2017年底开始出现的“DeepFake”视频。简单说,就是利用人工智能算法,将一个人的脸合成到另一个人的视频中,当用来训练的数据足够多,相关计算能力足够强大时,你很难直接辨别视频的真伪。

这种以假乱真的技术在2017年底曾引发美国社会的广泛讨论,尽管对于大众来说,对于这种技术的了解,可能更多来自那些恶搞政治人物的搞笑小视频。但事实上,当这个技术第一次“亮相”时,它的“用途”就是将欧美女明星合成到色情片中。

2017年12月,在 Reddit 网站上出现一个名为“DeepFakes”的账号,它展示了通过AI合成的明星色情片,被用来展示的包括著名女影星盖尔-加朵等人。这种做法满足了许多人的幻想,同时也立刻引发广泛讨论。很快,Reddit 封掉了这个账号以及相关的群组,Google、Twitter 等网站禁止相关的搜索,而一些色情片大站也封禁了相关视频。

但“DeepFake”却从未真正消失,Reddit 上最初的那个始作俑者将它的代码开源,越来越多的人们在此基础上进行“改良”,不断更新工具。有人形容,这种制作视频的技术已经不只是一个开源代码,而是快要成为一个安装包了。也就是说,基本上,只要有足够的动机和精力,谁都能自己制作类似的视频。

基于 GANs 而来的 DeepFake

在原理上,DeepFake 使用的正是最知名的深度学习算法之一 GANs。GANs 全称为生成式对抗网络,由 Ian Goodfellow 在2014年发明。

在制作 DeepFake 的过程中,这个算法会让两个神经网络彼此对抗,就好像现实中一个山寨作者和一个真迹鉴别家之间的对抗一样。第一个神经网络被称为生成网络,它负责制作尽可能逼真的作品,而第二个网络为鉴别器,它将前者生成的作品和原始数据库中大量的“真迹”进行对比,来鉴别哪些是真的哪些是假的。

基于每一次的“对抗”结果,生成网络会调整它制作时使用到的参数,直到鉴别器无法辨别它生成的作品和真迹,就算“成功”。这时候,最终合成的视频基本可以以假乱真了。

任何人可以变成任何人

像 DeepFake 这样的技术,让曾经只有最专业的电影制作机构才能完成的任务,变得简单了,你只需要拥有想要 fake 的目标对象的照片,以及一定配置的计算机,就可以使用这些开源的算法来进行训练,并制作出相应的假视频。任何人都能变成另外任何一个其他的人,而且数据越多,训练效果越好,计算能力越强,完成度也会越高。

每个人都是潜在受害者

这给许多女性带来困扰,不只是明星,还包括普通人。在华盛顿邮报此次的一系列报道中,作者形容,在 DeepFake 出现一年多之后,这种技术已经变成一种针对女性的武器:

这种视频被不成比例的用来针对女性,代表了一种新的可耻的羞辱、骚扰和虐待方式。这些假视频越来越逼真,它们被上传到色情网站上,并且越来越难以识别。

报道中,许多普通女性成为这种假视频的受害者,一名匿名的受害者说“我只想把互联网的一切都撕碎,但我也知道我无能为力。”

而在受到这种视频骚扰的诸多明星中,斯嘉丽-约翰逊是最积极的反对者,她在华盛顿邮报的采访中这样形容这一切:

什么也阻止不了这些人把我的图片复制粘贴到另一个人的身体上,并且让它看起来逼真的可怕。

想要尝试在互联网和它的邪恶面前保护自己,大多数时候就是一个注定失败的事情。

而且,她和律师发现,如果她们想要起诉制作假视频的人,目前的法律似乎并不够完善。据华盛顿邮报的报道,这种制作假视频的行为甚至可能被归于言论自由等类似的权利,受到美国宪法第一修正案的保护。如果坚持起诉,最好的结果可能是以诽谤、侵犯名誉权等罪名进行定罪,这与实际造成的伤害完全不匹配。

除此之外,许多媒体的评论也指出,DeepFake 的危害可能更深,因为它开始让曾经被视作最重要证据形式的视频,也变得不那么可信。而且这种制造逼真的假视频的技术有可能被利用在更危险的事情上。

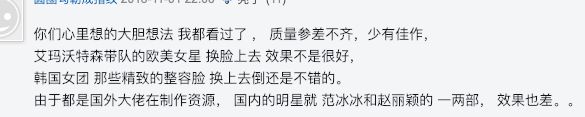

不过,与美国的广泛讨论不同,在中文互联网,尽管利用 DeepFake 作出的假视频也开始越来越多,但关于 DeepFake 的讨论还是更多地局限在那些小众论坛里。人们以一种猎奇的心态谈论着这些视频。比如这名用户,像点评普通电影一样点评着他看过的 DeepFake 视频。

而在许多中文相关报道中,也一样充满猎奇的气息,很多类似“宅男福音”,“DeepFake 教程”之类的文章,内容也充满“终于可以自己动手丰衣足食”之类的语句,并没有人真正讨论这件事情背后的性别问题、隐私问题以及关于如何使用新技术的问题。

尽管在人们眼中,似乎这些事情永远不会发生在自己身上,但事实是,在这种技术滥用面前,每个人都可能成为潜在的受害者。

“那些人攻击我,和攻击你本质上是一样的。每个人都可能成为受害者。”约翰逊在一份声明中这样说。“互联网就好像一个巨大的黑暗的虫洞,正在将自己吞噬。 ”

转载声明:本文转载自「硅星人」,搜索「guixingren123」即可关注。作者:玄宁