ACL2019最佳论文冯洋:Teacher Forcing亟待解决 ,通用预训练模型并非万能

机器之心原创

作者:一鸣

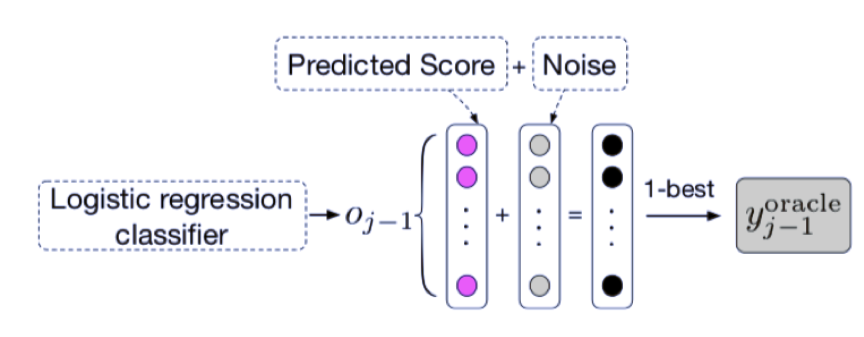

ACL 2019 大会近日落幕。来自中国科学院计算所、腾讯微信 AI 实验室、华为诺亚方舟、伍斯特理工学院等研究人员完成的机器翻译论文《Bridging the Gap between Training and Inference for Neural Machine Translation》获得了最佳长论文奖。在本文中,机器之心对此论文通讯作者、中国科学院计算所的冯洋老师进行了专访。

登录查看更多

相关内容

专知会员服务

43+阅读 · 2019年11月12日