DeepMind提出「心智神经网络ToMnet」,训练机器的「理解」能力

原文来源:arXiv

作者:Neil C. Rabinowitz、Frank Perbet、H. Francis Song、Chiyuan Zhang、S. M. Ali Eslami、Matthew Botvinick

「雷克世界」编译:嗯~阿童木呀、KABUDA

一般来说,心智理论(ToM,Premack和Woodruff于1978年提出)泛指人类理解自己与他人的心理状态,包括欲望、信仰和意图等,并基于此预测和解释他人行为的能力。我们打算对机器进行训练从而构建这样的模型。我们设计了一个心智理论神经网络——ToMnet,它使用元学习(meta-learning),通过对其所遇到的智能体的行为进行单独观察,从而构建该智能体模型。通过这个过程,它获得了一个智能体行为的强有力的先验模型,以及仅使用少量行为观察就能够更加丰富地预测特征特征和心理状态的能力。我们将ToMnet应用于在简单的gridworld环境中运行的智能体,显示它学习为来自不同群体的随机、算法和深度强化学习智能体进行建模,并且它通过了经典的ToM任务,如“SallyAnne”测试(Wimmer和Perner于1983年、BaronCohen等人于1985年提出),认识到其他人可能持有错误的世界观。我们认为这个系统,即自主学习如何在其世界中对其他的智能体进行建模,是开发多智能体AI系统、构建机器—人机交互的中介技术、推进可解释性AI发展的重要一步。

就目前而言,虽然在深度学习和深度强化学习领域取得了令人兴奋的发展成果,但有些人担心,我们对这些系统的理解已经落后了。神经网络通常被描述为不透明的、不可解释的黑盒子。即使我们对它们的权重有完整的描述,也很难掌握它们正在使用的模式以及它们可能出错的地方。随着人工智能体逐渐地进入人类世界,对于我们能够理解它们的需求也越来越大。

那我们不禁要问:“理解”另一个智能体究竟意味着什么?作为人类,我们每天都面对这一挑战,因为与我们所交流接触的人,他们的潜在特征、潜在状态和计算过程几乎完全无法访问。但我们具有非常出色的能力,我们可以对陌生人的未来行为进行预测,并推断出他们对世界的了解。我们对与他人的互动做出规划,并建立起与其之间的高效和有效沟通。

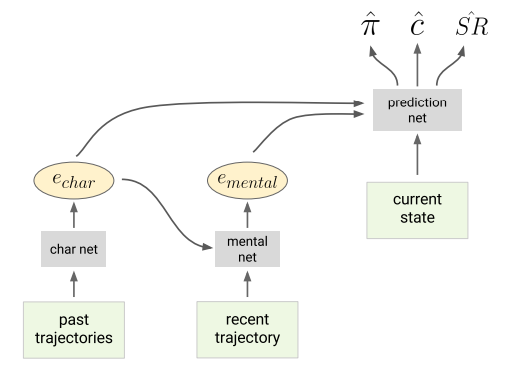

ToMnet架构

其他智能体的这些“理解”的一个突出特点是,他们几乎对智能体的真正潜在结构没有任何参考。我们通常不会试图估计他人神经元的活动,推断他们前额皮质的连通性,或者计划与其他人的海马体地图(hippocampal maps)动态的详细近似进行交互。认知心理学的一个重要观点是,我们的社会推理取决于其他智能体的高层次模型(Gopnik和Wellman于1992年提出)。这些模型涉及的抽象概念并未描述所观察行为的基础的详细物理机制。相反,我们理解的是他人的心理状态,例如他们的欲望、信仰和意图。而这种能力通常被描述为我们的心智理论(Premack和Woodruff于1978年提出)。尽管在某些情况下,我们也可以利用我们自己的想法对他人的想法进行模拟(例如Gordon于1986年、Gallese和Goldman于1998年提出),但我们对其他智能体的最终理解并不是通过我们的模型与机械基础事实之间1-1对应来实现的,而是由这些模型为诸如预测和规划等任务提供了多少支持(Dennett于1991年提出)实现的。

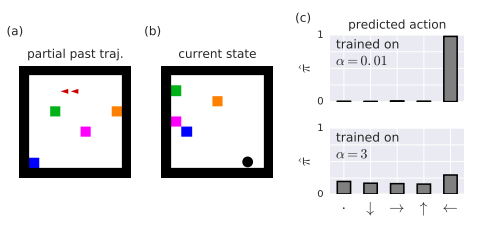

一个随机智能体在其中活动的gridworld示例

在本文中,我们从人的心智理论中获得灵感,并试图建立一个能够学习如何对其他智能体进行建模的系统。我们将此描述为机器心智理论(Machine Theory of Mind)。我们的目标不是提出一种智能体行为的生成式模型以及对其进行反转的算法。相反,我们的关注点在于,观察者是如何自主学习使用有限的数据为其他智能体进行建模的(Botvinick等人于2017年提出)。这将使我们的研究与以前的研究成果区分开来,以往研究依赖于将手工制作的智能体模型作为嘈杂理性的规划者(noisy-rational planners),例如,使用反向强化学习、贝叶斯推理、贝叶斯心智理论或博弈论等。与其相反的是,我们学习智能体模型,并学习如何从头开始,通过元学习来对它们进行推理。

构建一个丰富、灵活并具有高性能的机器心智理论对于AI而言可能是一个巨大的挑战。我们并不是要在这里解决所有问题。本文要传递的一个主要信息是,只要它们以正确的方式表达,构建ToM的许多初始挑战可以被视为简单的学习问题。我们这里的工作就是要弄明白这些简单公式。

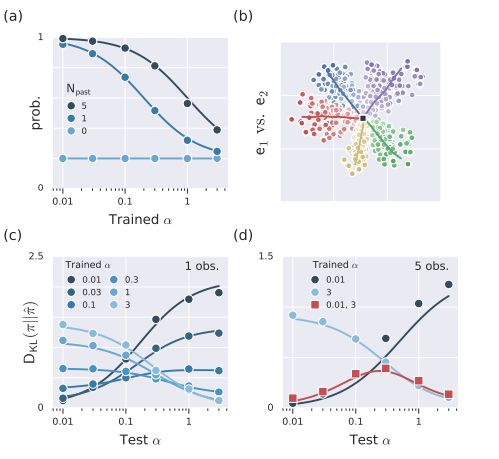

在随机智能体上进行训练的ToMnet

这项工作具有很多的潜在应用,学习他人的丰富模型将改善复杂的多智能体任务的决策,尤其是在需要基于模型的规划和想象力的情况下(Hassabis等人于2013年,Hula等人于2015年,Liehok和Amato于2016年提出)。这些模型对于价值调整(Hadfield Menell等人于2016年提出)和灵活合作(Nowak于2006年,Kleiman-Weiner等人于2016年,Barrett等人于2017年提出)是重要的,并且可能成为未来机器伦理决策(machines’ ethical decision making)的一个组成部分(Churchland等人于1996年提出)。它们对传播学和教育学也非常有用(Dragan等人于2013年,Fisac等人于2017年,Milli等人于2017年提出),因此可以在人机交互中起到关键作用。探索产生这些能力产生的条件可以揭示我们人类能力的起源(Carey等人于2009年提出)。最终,这样的模型可能成为我们人类理解人工智能体的重要媒介。

最后,我们强烈的动机是使人类理解人工智能体,我们在此尝试了一种新颖的方法:我们试图建立一个中介系统,以减少行为空间的维度,并以更易理解的形式展现它们,而不是修改智能体结构以人类易于理解的解释方式揭示其内部状态。在这方面,对Machin ToM的追求是为了在机器和人类期望之间建立缺失的界面(Cohen等人于1981年提出)。

在本文中,我们使用元学习来构建一个系统,用来学习如何对智能体进行建模。我们通过一些列实验展示了ToMent如何在训练分布中学习智能体的通用模型,以及如何在观察一个新智能体的同时,在线构建一个特定智能体模型。ToMent可以在一系列不同类型的智能体上灵活地学习这些模型,并且对驱动这些智能体制定决策的生成过程几乎没有做出任何假设。ToMnet还可以发现行为空间内的抽象概念。

我们注意到,我们在这里进行的实验很简单,旨在说明这一系统的核心思想和功能。要将ToMnet扩展到更广阔的领域,还有许多工作要做。

第一,由于这种环境具有控制力,因此导致我们完全在gridworld内工作。我们期待将这些系统扩展到复杂的3D视觉环境中,并在其他具有丰富状态空间的POMDP中运行。

第二,我们在这里没有尝试限制观测者本身的可观测性。这显然是现实世界社交活动中的一个重要挑战,例如,我们试图确定别人知道我们所不知道的是什么时,这本质上是一个推理问题(Baker等人于2017年提出),学习如何做到这一点是ToMnet未来面临的挑战。

第三,我们希望能在其他更多维度上描述智能体的特征,例如,它们是否有生命(Scholl和Tremoulet于2000年提出),友好还是敌对(Ullman等人于2009年提出),被动的还是有计划的(Sutton和Barto等人于1998年提出)。或许更令人感兴趣的是利用ToMnet发现自然或人工种群行为的新结构的可能性,即作为一种机器人类学(machine anthropology)。

第四,心智理论对社会人而言十分重要,因为它能指导我们的社会决策。这项研究的一个重要步骤是将ToMnet放置在人工智能体内部,人工智能体必须学习执行多智能体任务。

在追求这些目标的过程中,我们预见了许多未来的需求:丰富ToMnet必须做出一系列预测;向ToMnet的智能体行为生成式模型中引入温和的归纳偏见;思考智能体如何从它们自身的经验和知识中不断总结,以便让它们的模型了解他人。解决这些问题对于推进机器心智理论是必要的,该理论可以学习负责任的社会人士所具有的丰富能力。

未来智能实验室是人工智能学家与科学院相关机构联合成立的人工智能,互联网和脑科学交叉研究机构。由互联网进化论作者,计算机博士刘锋与中国科学院虚拟经济与数据科学研究中心石勇、刘颖教授创建。

未来智能实验室的主要工作包括:建立AI智能系统智商评测体系,开展世界人工智能智商评测;开展互联网(城市)云脑研究计划,构建互联网(城市)云脑技术和企业图谱,为提升企业,行业与城市的智能水平服务。

如果您对实验室的研究感兴趣,欢迎加入未来智能实验室线上平台。扫描以下二维码或点击本文左下角“阅读原文”