题目: Towards Explainable Deep Neural Networks (xDNN)

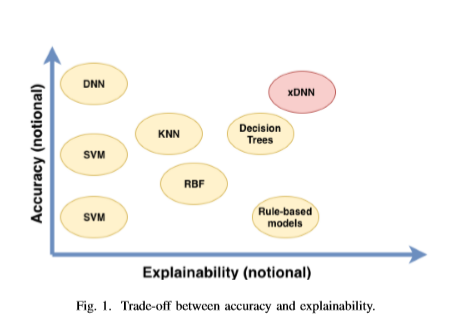

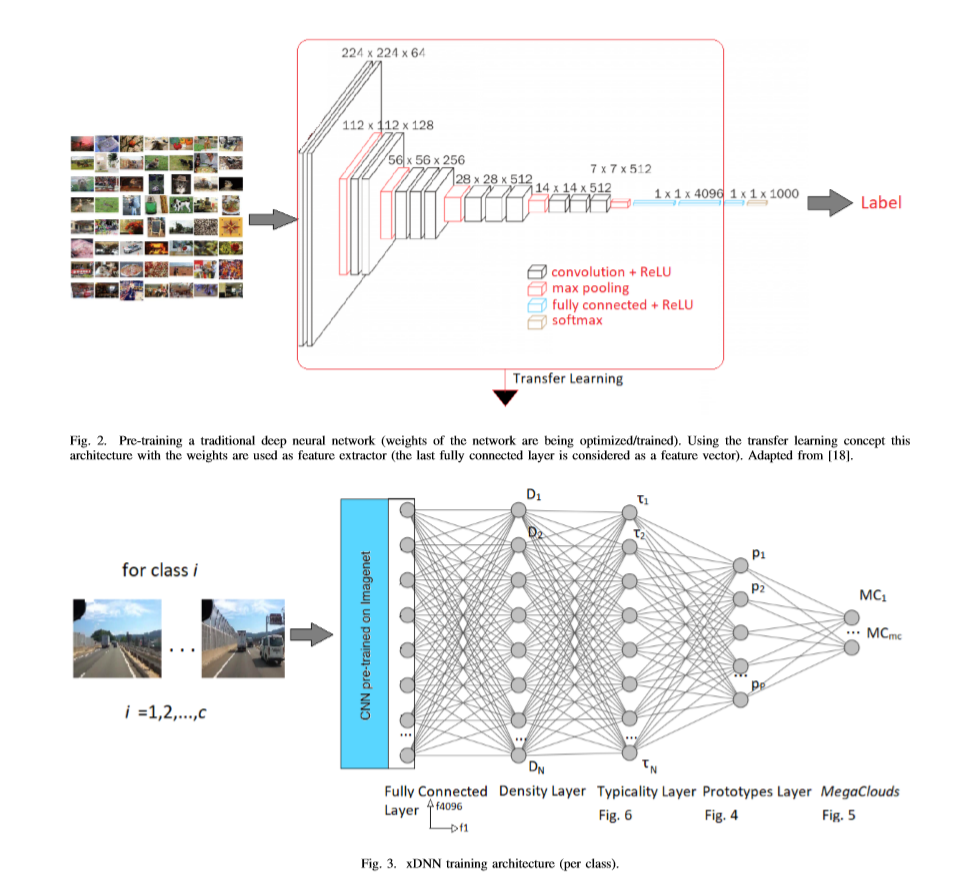

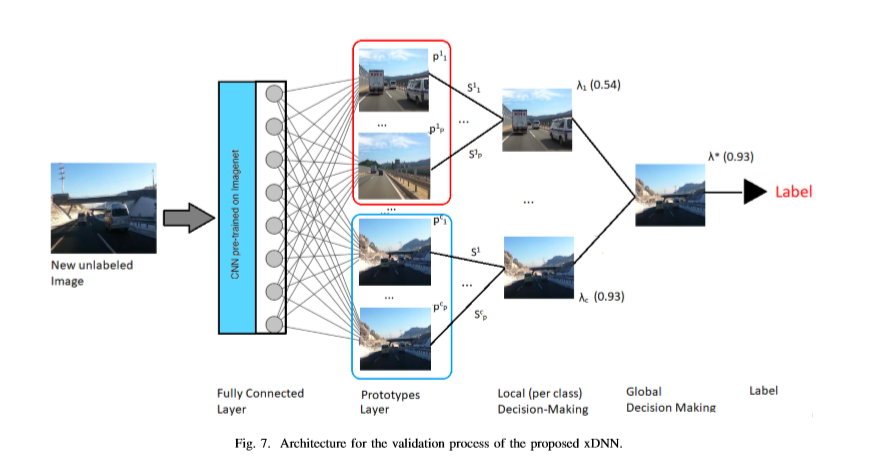

简介: 在本文中,我们提出了一种解决方案,该解决方案直接解决了传统深度学习方法的瓶颈,并提供了一种清晰可解释的内部架构,该架构可以胜过现有方法,只需要很少的计算资源(不需要GPU)并且训练时间短(以秒为单位)。提出的方法xDNN原型,原型是实际的训练数据样本(图像),是经验数据分布的局部峰值(称为典型性)以及数据密度。这种生成模型以封闭形式识别,但可以自动且完全从训练数据中得出,而无需用户或问题特定的阈值,参数或干预。xDNN提供了一种新的深度学习架构,该架构将推理和学习结合在一起。它是非迭代且非参数的,这从时间和计算资源上解释了其效率。从用户的角度来看,用户显然可以理解所提出的方法。我们在一些著名的基准数据集(例如iRoads和Caltech-256)上对其进行了测试。 xDNN在准确性,训练时间方面优于其他方法,包括深度学习,并提供了一个清晰可解释的分类器。

成为VIP会员查看完整内容

相关内容

专知会员服务

27+阅读 · 2019年12月19日