斯坦福大学2020《自然语言处理CS224n》课件合集

最新课程CS224n——自然语言处理与深度学习,主讲人是斯坦福大学Chris Manning,他是斯坦福大学机器学习教授,语言学和计算机科学教授,斯坦福人工智能实验室(SAIL)主任,以人为本的人工智能研究所副所长。

近年来,深度学习方法在许多不同的NLP任务中获得了非常高的性能,使用不需要传统的、特定于任务的特征工程的单个端到端神经模型。在本课程中,学生将深入了解NLP深度学习的前沿研究。通过讲座、作业和期末专题,学生将学习设计、实施和理解自己的神经网络模型所需的必要技能。本课程使用Pytorch 进行教学。

https://web.stanford.edu/class/cs224n/

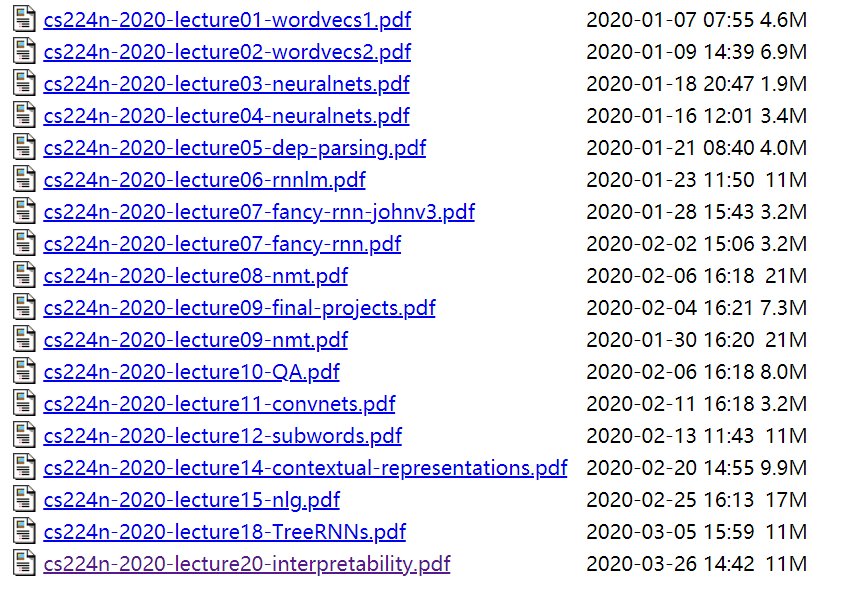

该课程已经结束,课件如下:

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“CS224N” 可以获取《斯坦福大学2020《自然语言处理CS224n》课件合集》专知下载链接索引

克里斯托弗·曼宁(Christopher Manning)是斯坦福大学(Stanford University)计算机科学和语言学系机器学习教授,斯坦福大学人工智能实验室(SAIL)主任。他的研究目标是能够智能处理、理解和生成人类语言材料的计算机。曼宁是将深度学习应用于自然语言处理领域的领军人物,在树递归神经网络、词向量手套模型、情感分析、神经网络依赖分析、神经机器翻译、问答和深度语言理解等领域都有著名的研究成果。他还专注于解析、自然语言推理和多语言处理的计算语言方法,包括斯坦福依赖关系和通用依赖关系的主要开发者。曼宁与人合著了《自然语言处理的统计方法》(Manning and Schütze 1999)和《信息检索》(Manning,Raghavan and Schütze,2008)两本领先的教科书,还合著了关于能性和复杂谓词的语言学专著。他是ACM Fellow,AAAI Fellow,ACL Fellow,也是前ACL主席(2015)。他的研究曾获得ACL、Coling、EMNLP和CHI最佳论文奖。1994年,他在澳大利亚国立大学获得学士学位,在斯坦福大学获得博士学位。在回到斯坦福大学之前,他曾在卡内基梅隆大学和悉尼大学担任教职。他是斯坦福NLP小组的创始人,负责斯坦福大学CoreNLP软件的开发。

个人主页:https://nlp.stanford.edu/~manning/

课程安排

01: 介绍和词向量(Introduction and Word Vectors)

Gensim字矢量示例(Gensim word vectors example:)

02:单词向量2和单词意义(Word Vectors 2 and Word Senses)

03:Python复习课(Python review session)

04:词窗口分类、神经网络和矩阵演算(Word Window Classification, Neural Networks, and Matrix Calculus)

05:反向传播和计算图(Backpropagation and Computation Graphs)

06:语言结构:依存分析(Linguistic Structure: Dependency Parsing)

07:一个句子的概率?递归神经网络和语言模型(The probability of a sentence? Recurrent Neural Networks and Language Models)

08:消失的梯度和花哨的RNNs (Vanishing Gradients and Fancy RNNs)

09:机器翻译,Seq2Seq and Attention (Machine Translation, Seq2Seq and Attention)

10:最终项目的实用技巧(Practical Tips for Final Projects)

11:问答和默认的最终项目(Question Answering and the Default Final Project)

12:NLP的ConvNets(ConvNets for NLP)

13:部分单词(子单词模型)和转换器结构的信息(部分单词(子单词模型)和转换器结构的信息)

14:上下文单词表示(Contextual Word Representations)

15:使用的建模上下文:上下文表示和预训练(Modeling contexts of use: Contextual Representations and Pretraining)

16:自然语言生成(Natural Language Generation)

17:语言参考和共指解析(Reference in Language and Coreference Resolution)

18:AI中的公平和包容(Fairness and Inclusion in AI)

19:选区解析和树递归神经网络(Constituency Parsing and Tree Recursive Neural Networks)

20:NLP以及深度学习的未来(NLP+深度学习的未来)