2021 IEEE热门AI话题盘点:模仿生物大脑打造神经网络、GPT3“不当言论”惹关注…

行早 发自 凹非寺

量子位 报道 | 公众号 QbitAI

马上就到元旦啦~站在2021年尾,IEEE Spectrum回顾了今年AI的“注意力”都放在了哪里。

其中不仅有对AI本身具体技术的关注,像仿生蜻蜓神经网络取得的突破;也有对整个行业的思考,例如吴恩达李飞飞对AI医疗的看法。

我们从中提炼了7个关注度高的话题,带你把握2021AI的关注点。

AI的“注意力”都放在了哪里

1、仿生蜻蜓的神经网络

△图源:IEEE Spectrum

注意值:⭐️⭐️

在神经网络都在增加复杂度的时候,桑迪亚国家实验室的Frances Chance从蜻蜓中产生了新的思考:为什么这种昆虫只需要100万个神经元就能敏捷高效地捕获猎物?

于是Frances Chance尝试通过仿生蜻蜓的大脑来构建神经网络。

首先我们可以做一个简单的估算:蜻蜓只需要50ms就可以对猎物的动作做出反应,假设眼睛中的细胞需要10ms来检测并传输信息,肌肉细胞需要5ms来发力。

那就只剩下35ms留给神经网络进行计算。

如果单个神经元需要10ms来整合信息,整个网络最多也就三四层的样子。

Frances Chance基于此设计了一个三层的神经网络。

第一层是一个包含441(21x21)个代表视觉输入的神经元,每个神经元覆盖视野的一个特定区域。

第二层使用了214个神经元,用来判断蜻蜓需要朝哪个方向转动去接近猎物。

最后一层是运动命令层,输出与运动相关的指令。

这样就可以模拟蜻蜓捕猎的“脑回路”,还原出来是这样的:

下图中红色轨迹代表昆虫的运动轨迹,黑色轨迹代表蜻蜓的捕猎轨迹。

△图源:IEEE Spectrum

从中可以很清晰地看到,在注意到昆虫之后,蜻蜓马上调整方向,带有“预判”地直扑猎物。

除此之外,蜻蜓自身也有“注意力”机制。在视野中出现一只猎物的时候,会只瞄准这一只。或许我们也能从中挖掘出一些快速高效低成本的注意力算法。

不过,蜻蜓给我们带来的启发远不止算法方面,还可能影响系统设计。例如蜻蜓的眼睛每秒可以播放200帧,但是空间分辨率很差。

这种“技能点”的点法也能有效地帮助蜻蜓捕食。或许也能从中得到一些改进系统设计的灵感。

再把思路拓宽一些,我们“拜师”的范围还可以更广泛:蚂蚁,蝴蝶,蜜蜂……它们都有专业且高效的微型处理器,可能会让下一代神经网络获益良多。

Frances Chance还考虑了这项仿生学成就的应用,例如可以应用到自动驾驶算法中,或者配置到无人机上用来避障等。

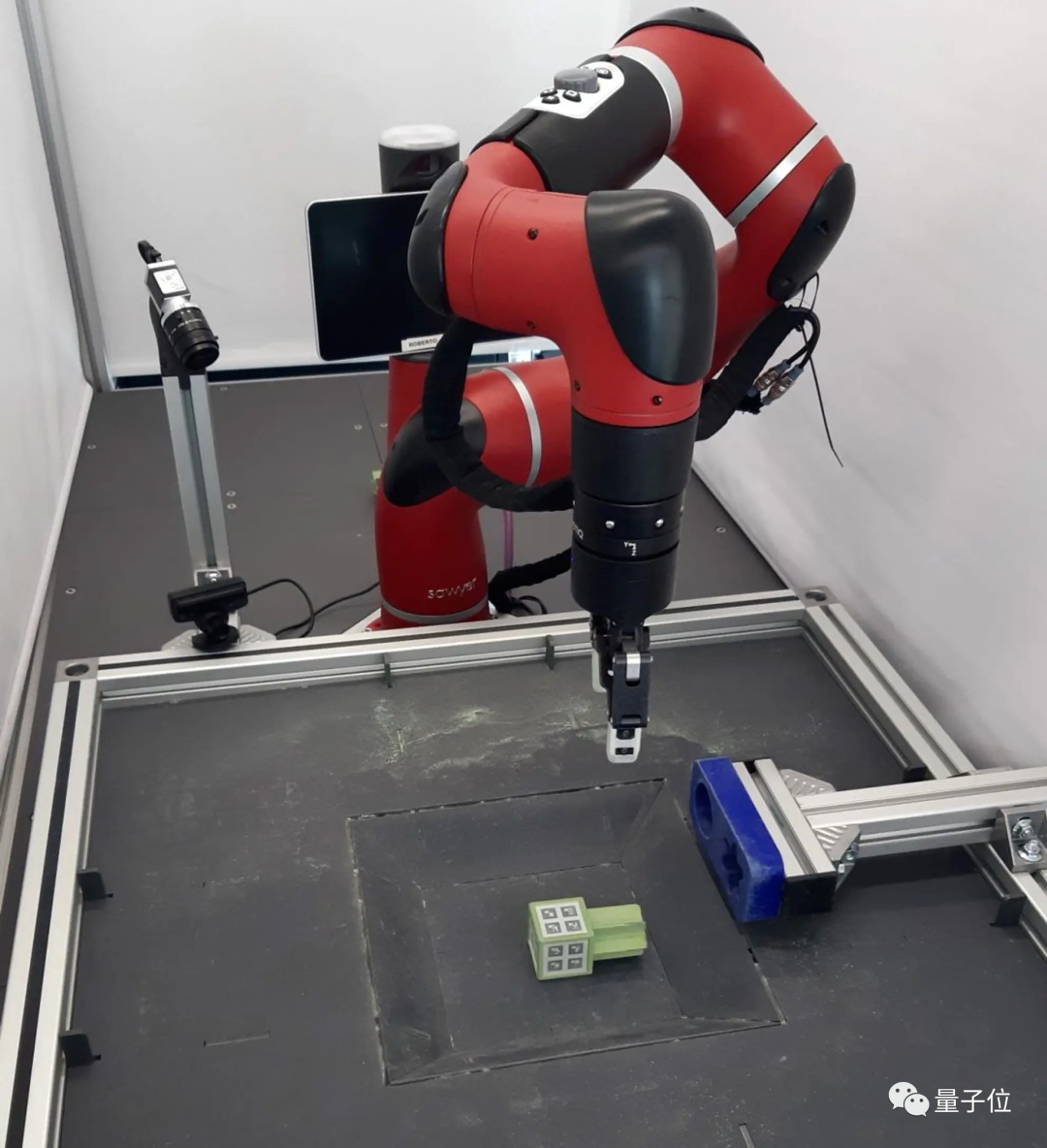

2、Deepmind如何重塑机器人

△图源:IEEE Spectrum

注意值:⭐️⭐️⭐️⭐️

DeepMind的机器人技术负责人Raia Hadsell表示,她正在尝试做一个多才多艺、适应性强的机器人。(但是必须先解决灾难性遗忘的问题)

在一些科幻电影或者日常想象中,我们都把人工智能当作全职保姆:开车、做家务、应急救援、干体力活、从事农业生产……

想得很美,但是具体到神经网络上来说,如果想达成这种效果,就得解决灾难性遗忘的问题。

因为和人脑的记忆功能相比,神经网络的记忆能力实在是太差了。

例如一个辨别猫狗的神经网络,让它来区分公交车和汽车,它之前的所有训练都毫无作用。

因为神经网络只能针对一类图片调整权重,不能增量式地学习处理不同的任务。

所以机器人也就很难成为“全职保姆”。

不过DeepMind正在通过多种手段,例如弹性权重巩固算法、渐进式神经网络、知识蒸馏等,去构造多才多艺的机器人。

△图源:IEEE Spectrum

3、吴恩达李飞飞聊AI医疗未来

△图源:IEEE Spectrum

注意值:⭐️⭐️⭐️

在斯坦福HAI的一场会议上,吴恩达和李飞飞聊到了AI医疗的未来。

简单来说,在AI医疗行业,我们离实践还有很长的距离。

So even though at a moment in time, on a specific data set, we can show this works, the clinical reality is that these models still need a lot of work to reach production.

吴恩达表示,“即使某时这些模型在特定数据集上表现得好,到了真正的临床上,还欠很多功夫。”

并且这种科研和实践的差距不仅限于AI医疗,还广泛存在于整个机器学习领域:

All of AI, not just healthcare, has a proof-of-concept-to-production gap.

另外,在Numenta的创始人Jeff Hawkins与IEEE Spectrum的访谈中,提到了神经科学对AI的重要性,这也可能成为未来AI的发展方向之一。

4、GPT3会生成不当言论

△图源:IEEE Spectrum

注意值:⭐️⭐️⭐️

在了解了一些AI的发展前景之后,也需要一些反思。

在一款AI问答程序(Philosopher AI)中,它的一篇关于埃塞俄比亚的回答却包含一些种族歧视的句子。

这是因为Philosopher AI底层的GPT3使用的是互联网上的语言数据进行训练,不仅包括新闻、维基百科和电子书,还包括Reddit等其他网站上的不当言论。

但是这种情况又很难消除,因为偏见的定义很模糊,不同敏感程度的人听到的感觉也不同。

于是AI就像一面镜子一样,反照出人们自身的不良行为,在解决问题和反省自己两个方面都值得反思。

5、AI的七个缺点

△图源:IEEE Spectrum

注意值:⭐️

虽然AI在某些领域可以叱咤风云,但是在另外一面,它也是一个脆弱的、健忘的、缺乏常识的数学差生……

这一点也不可避免地受到了关注。

IEEE Spectrum总结了AI的七个缺点:脆弱、包含偏见、灾难性遗忘、可解释性差、难以量化不确定性、缺乏常识、不擅长数学。

举个栗子,对于一些处理图像分类的AI,即使只改变一个像素,AI就开始“指鹿为马”了。

再比如上文提到的AI偏见。在2019年,科学家就发现美国的医疗保健算法存在偏见。

这个算法用于判断患者是否应该纳入重症监护计划,但是它通常会优先白人,即使黑人病情更严重。

这可能是因为用于训练算法的数据集中会有人类自身不良行为的影子。

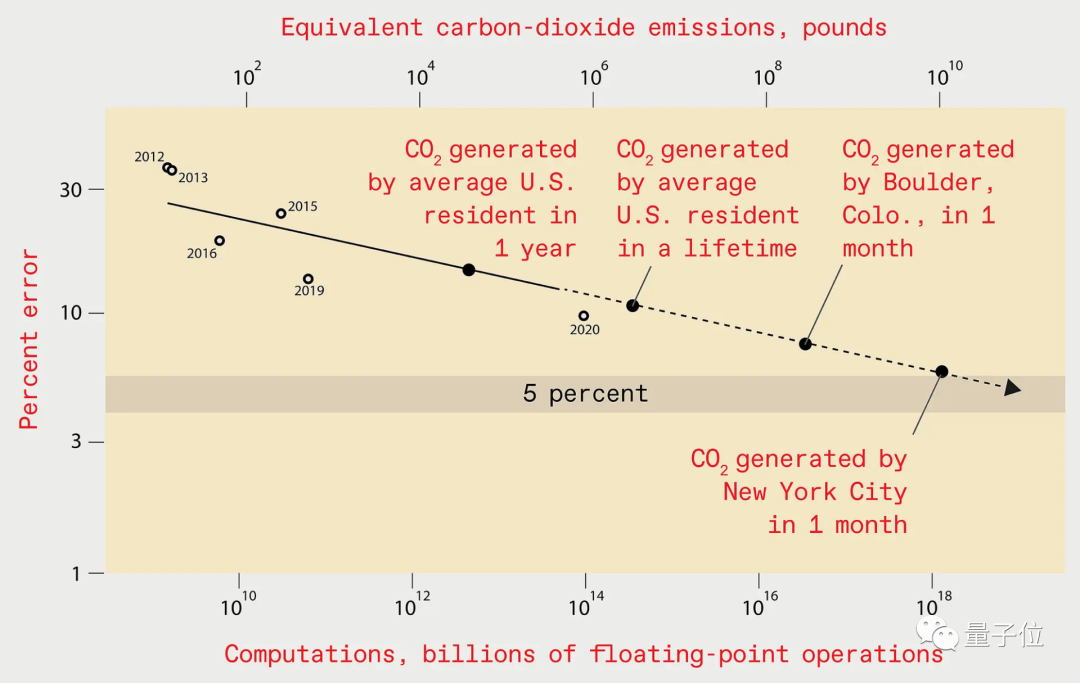

6、深度学习收益递减

△图源:IEEE Spectrum

注意值:⭐️⭐️⭐️⭐️⭐️

麻省理工学院的Neil Thompson和他的几位合作者发表了一篇关于训练深度学习系统的计算和能源成本的专题文章。

这篇文章通过分析图像分类器的改进工作,发现了一个重大问题:

对于图形分类器来说,成本实在是顶不住啊~

来看这张错误率和成本之间的统计关系图:

![]() △图源:IEEE Spectrum

△图源:IEEE Spectrum

上图中纵轴代表当前错误率,上边的横轴代表等价的二氧化碳排放成本,下边的横轴代表计算机浮点计算次数。

从前几年的数据中可以看出,随着错误率的下降,计算次数和二氧化碳排放成本都在不断攀升。

如果按照这条回归曲线的走势来看,到2025年,为识别ImageNet数据集中的对象而设计的最佳深度学习系统的错误水平应该降低到仅5%。

但是,降至5%的错误率的成本是百亿磅量级的二氧化碳排放。

也就是说训练一个这样的系统,排放的二氧化碳和纽约市一个月排放的二氧化碳一样多,耗资高达1000亿美元……

大家可以自行换算成其他经济单位(狗头)~

不过,这个问题也不是一点办法都没有。

例如,可以寻找一些完全不同的硬件框架,可能是基于光学或者量子系统的硬件;或者将专家知识和神经网络相结合降低训练成本等。

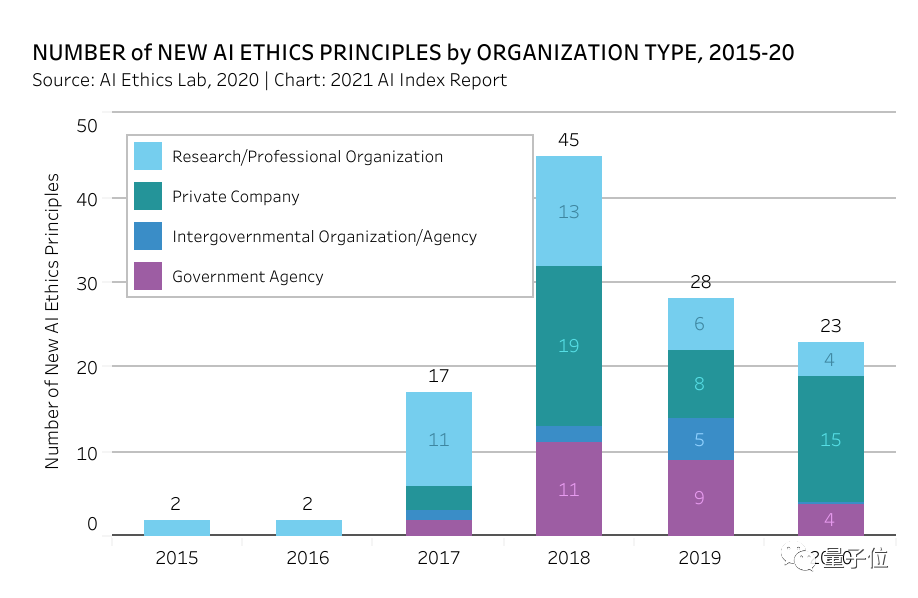

7、人工智能指数报告

△图源:IEEE Spectrum

注意值:⭐️⭐️⭐️⭐️⭐️

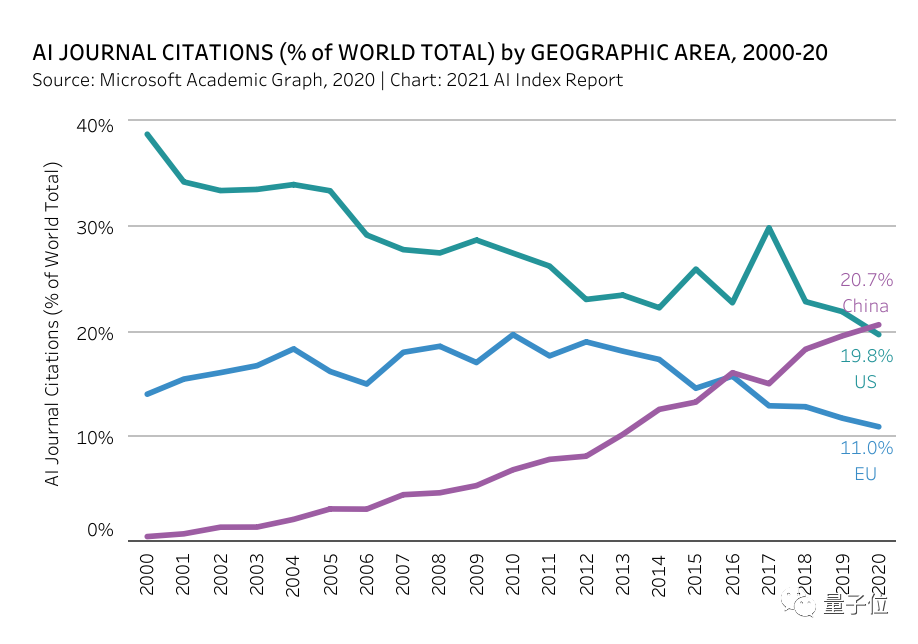

在最后,来自斯坦福的《2021年人工智能指数报告》如期而至,也成为了最受关注的话题之一。

其中包含了技术,教育,研发,伦理等多项人工智能统计,反映了近期AI的发展情况。

这里选择了学术、经济、伦理方面的几则统计数据来展示。

例如在学术方面,中国人工智能期刊引用量(紫色曲线)超过美国:

△图源:《人工智能指数报告》

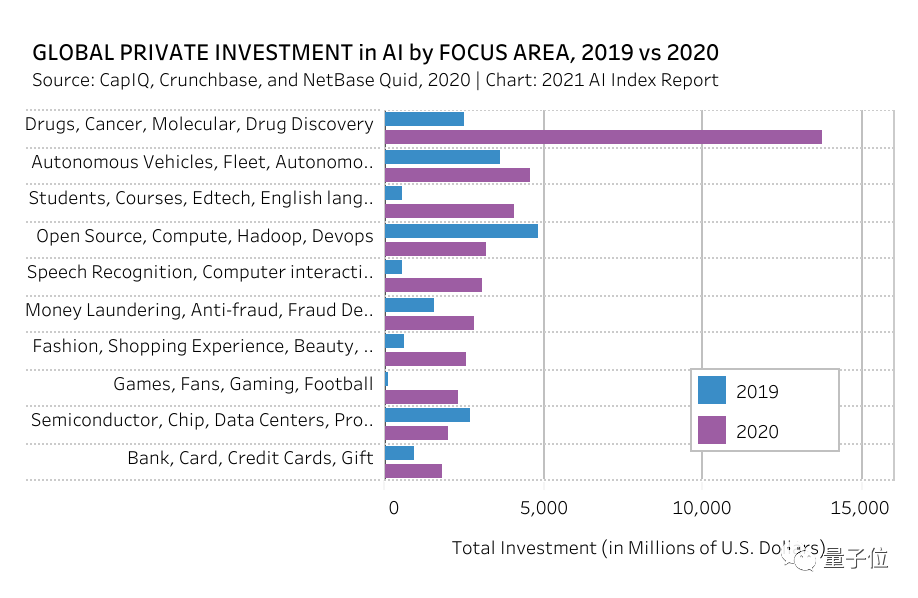

在经济层面,在AI不同领域的投资情况如下图。

其中可以明显看出AI在生物医药方面的投资,由于受疫情影响提高了数倍。

对于教育行业也是如此。

另外在语音识别、游戏、银行等行业也有不同程度的提高:

![]() △图源:《人工智能指数报告》

△图源:《人工智能指数报告》

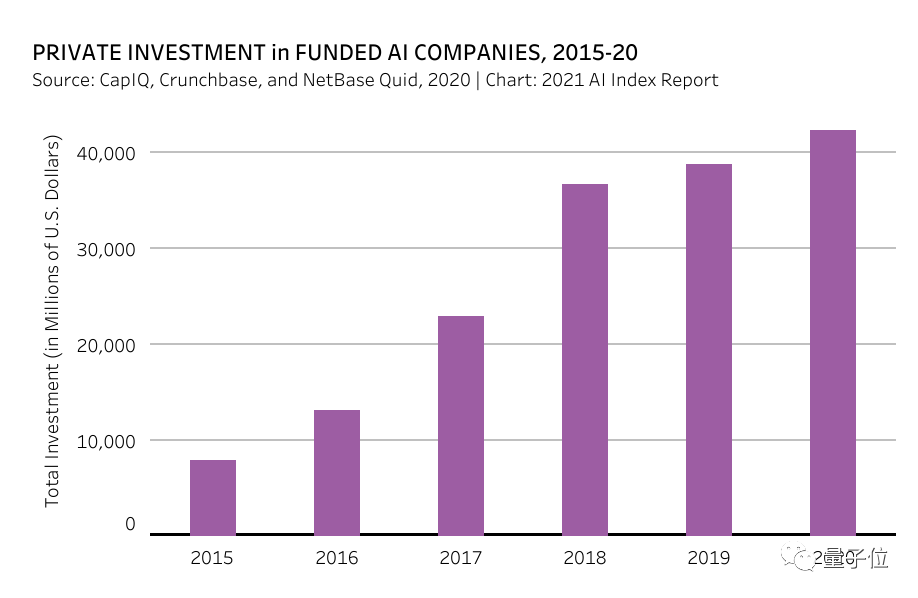

针对AI公司的投资也是逐年上升:

![]() △图源:《人工智能指数报告》

△图源:《人工智能指数报告》

不过,在道德伦理层面,目前人工智能伦理还缺乏基准和共识,下图为不同组织提出的人工智能新伦理准则,已连续两年下降。

人工智能伦理的缺乏可能会导致一些诸如侵犯隐私、种族歧视等问题。

![]()

△图源:《人工智能指数报告》

除此之外,还有更多内容,可以参考斯坦福《2021人工智能指数报告》~

参考链接:

[1]https://spectrum.ieee.org/artificial-intelligence-2021

[2]https://aiindex.stanford.edu/report/

[3]https://arxiv.org/abs/1710.08864

— 完 —

本文系网易新闻•网易号特色内容激励计划签约账号【量子位】原创内容,未经账号授权,禁止随意转载。

「智能汽车」交流群招募中!

欢迎关注智能汽车、自动驾驶的小伙伴们加入社群,与行业大咖交流、切磋,不错过智能汽车行业发展&技术进展。

ps.加好友请务必备注您的姓名-公司-职位哦~

点这里👇关注我,记得标星哦~

一键三连「分享」、「点赞」和「在看」

科技前沿进展日日相见~

△图源:IEEE Spectrum

△图源:IEEE Spectrum

△图源:《人工智能指数报告》

△图源:《人工智能指数报告》 △图源:《人工智能指数报告》

△图源:《人工智能指数报告》