ECCV 2020|全新行人ReID域适应联合学习框架,达到SOTA效果!

作者 | Barack

论文链接:https://arxiv.org/abs/2007.10315

论文链接:https://arxiv.org/abs/2007.10315

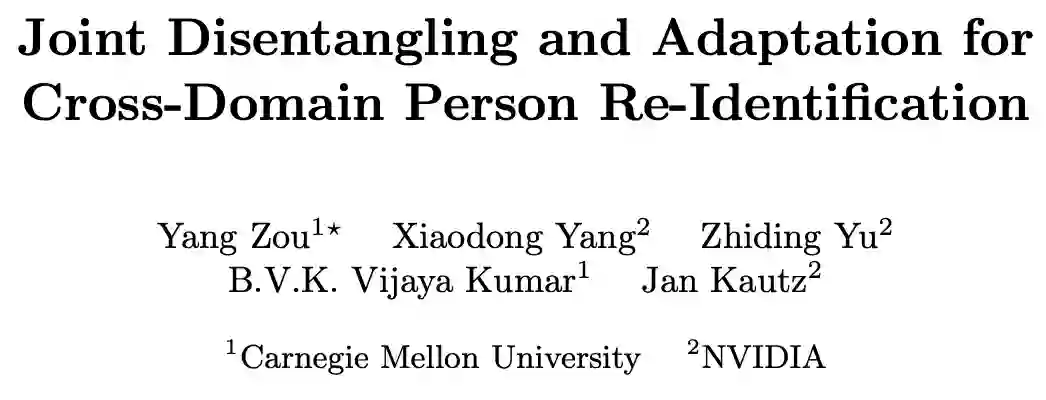

动机

方法

由于目标域缺乏标签,同时对id不相关特征也没有明确的定义,直接进行特征解藕具有一定的难度,作者巧妙的引入了循环一致性图像生成任务(cycle-consistency generation),让网络自动区分两种特征,同时只在id相关特征构成的特征空间中执行域适应,图像生成任务由循环一致损失和交叉熵损失监督,图像生成的质量越高,特征解藕的效果就越好,域适应过程也就更容易。

由于目标域缺乏标签,同时对id不相关特征也没有明确的定义,直接进行特征解藕具有一定的难度,作者巧妙的引入了循环一致性图像生成任务(cycle-consistency generation),让网络自动区分两种特征,同时只在id相关特征构成的特征空间中执行域适应,图像生成任务由循环一致损失和交叉熵损失监督,图像生成的质量越高,特征解藕的效果就越好,域适应过程也就更容易。

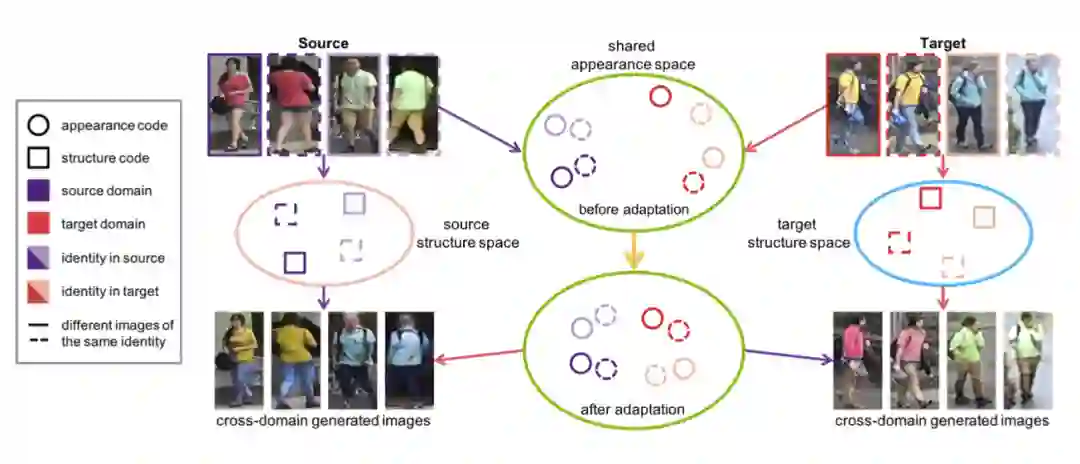

网络结构

注:图中虚线箭头表示对输入图像进行灰度处理后输入到下一模块。

注:图中虚线箭头表示对输入图像进行灰度处理后输入到下一模块。

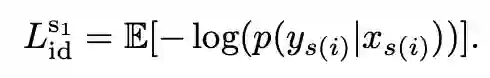

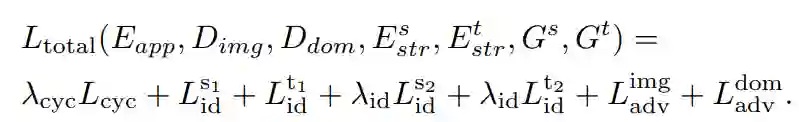

损失函数

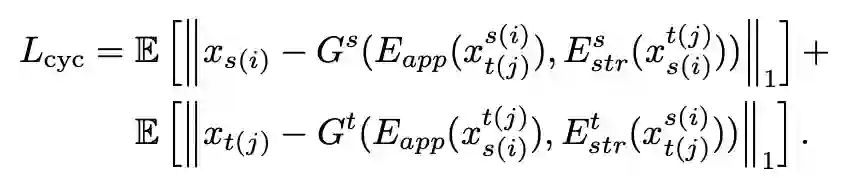

循环

一致性损失用来保证图像的生成质量,上式中G(E_app(x), E_str(x))分别表示特征重组后的生成图像。

循环

一致性损失用来保证图像的生成质量,上式中G(E_app(x), E_str(x))分别表示特征重组后的生成图像。

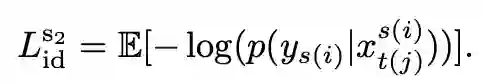

上式为标准的图像对抗损失,用来拉近真实图像与生成图像的特征分布,其中D_img是参数共享的,其会直接驱动E_app生成domain-invariant的特征。

上式为标准的图像对抗损失,用来拉近真实图像与生成图像的特征分布,其中D_img是参数共享的,其会直接驱动E_app生成domain-invariant的特征。

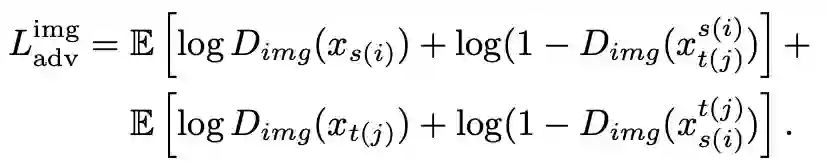

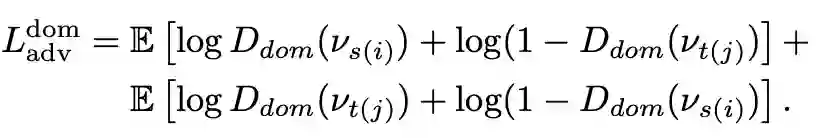

其中特征分布对齐使用对抗学习方式,上式为domain的判别器损失。

为了消除两个domain之间的差异,需要保证E_app产生的id相关特征是域无关的,也就是说对于同一id的图像,不论它来自源域还是目标域,E_app都可以提取到相似的特征。

其中特征分布对齐使用对抗学习方式,上式为domain的判别器损失。

为了消除两个domain之间的差异,需要保证E_app产生的id相关特征是域无关的,也就是说对于同一id的图像,不论它来自源域还是目标域,E_app都可以提取到相似的特征。

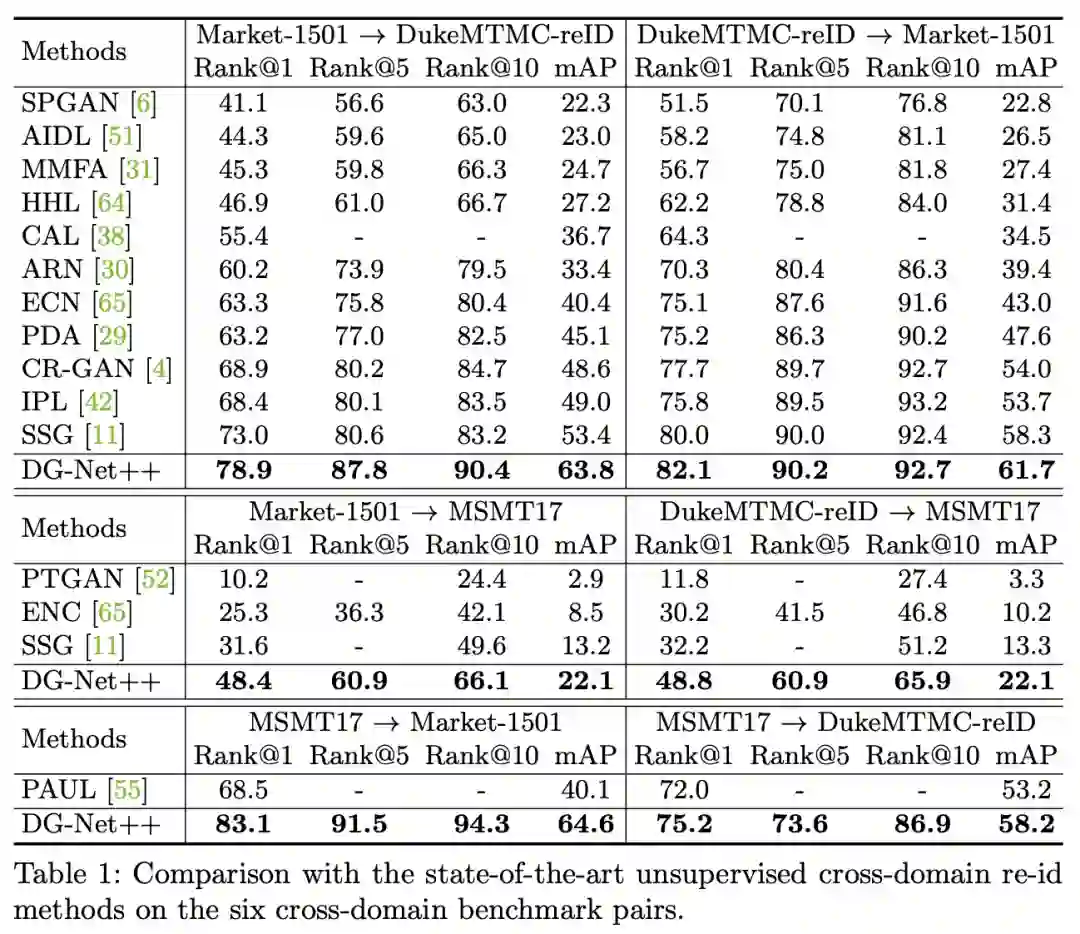

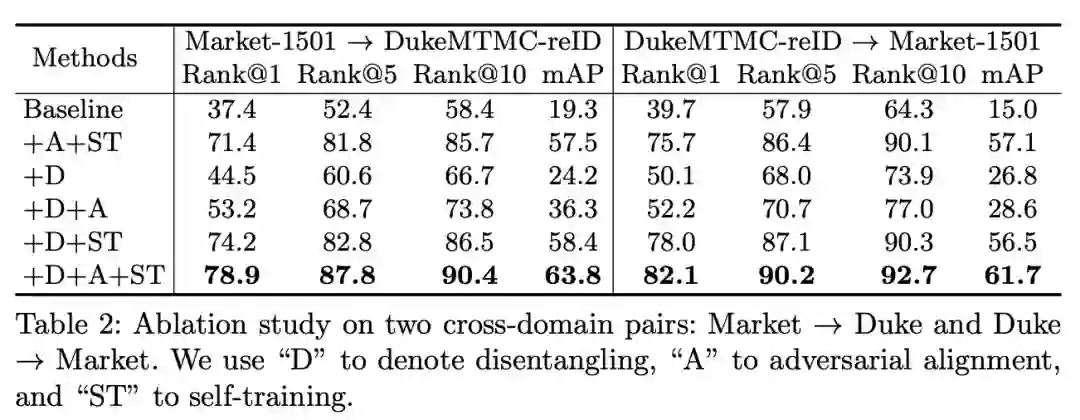

实验结果

分别与现有的无监督域适应方法进行了对比,可以看到本文的方法有明显的提升,同时作者还强调本文的特征解藕模块可以应用到其他的域适应方法中来提高性能。

分别与现有的无监督域适应方法进行了对比,可以看到本文的方法有明显的提升,同时作者还强调本文的特征解藕模块可以应用到其他的域适应方法中来提高性能。

相辅相成的特征解耦和域适应

总结

阅读原文,直达“ ECCV”小组,了解更多会议信息!

登录查看更多