学界 | Adobe提出深度抠图:利用卷积网络分离图像前景与背景

选自arXiv

机器之心编译

参与:蒋思源

抠图,一直是一件体力活,它需要大量的操作与时间。而传统抠图算法主要是以色彩为特征分离前景与背景,并在小数据集上完成,而这就造成了传统算法的局限性。在 Adobe 等机构新提出的论文中,其采用了大规模数据集与深度神经网络学习图像的自然结构,从而进一步分离图像的前景与背景。

论文地址:https://arxiv.org/abs/1703.03872

摘要

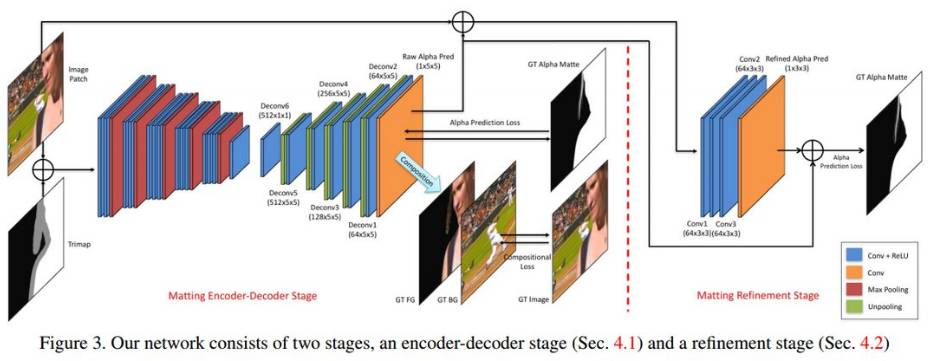

抠图(Image matting)是一项基本的计算机视觉问题,并拥有广阔的应用空间。当图像的前景(foreground)和背景颜色或复杂纹理类似时,早先的算法表现得差强人意。主要是因为:1. 只有低级特征(low-level features);2. 缺乏高层次上下图境(high-level context)。在本篇论文中,我们提出了一种基于深度学习的新算法,该算法可以解决这两个问题。我们的深度模型分为两个阶段。第一阶段是深度卷积编码-解码网络(deep convolutional encoder-decoder network),该神经网络将图像和相对应的三分图(trimap)作为输入,并预测图像的α蒙版(alpha matte)。第二阶段是一个小型卷积神经网络,该神经网络对第一个网络预测的α蒙版进行精炼从而拥有更准确的α值和锐化边缘。另外,我们还创建了一个大规模抠图数据集(large-scale image matting dataset),该数据集包含 49300 张训练图像和 1000 张测试图像。我们在抠图基准、测试数据集和各种真实图像上评估了我们的算法。实验结果清楚地表明了我们的算法比先前的方法更具优越性。

简介

抠图(Image matting),即在图像或视频中精确估计前景的问题,具有很重要的实用性。它是图像编辑和电影制作的关键技术,高效的自然图像抠图方法能极大地提升当前的图像视频处理流程的效率。并且这种技术是无约束场景(unconstrained scenes)下处理真实世界图像的必要方法。

然而,目前抠图算法还是具有很大的局限性:

首先第一个局限性就是目前用来求解抠图方程式(matting equation)的方法存在问题。

其中 Ii 是像素块 i 的 RGB 色彩,已知前景色彩 Fi,背景色彩 Bi,未知蒙版估计(matte estimation)αi。在这个方程式中,抠图问题形式化为两种颜色的线性组合,因此大多数现存的算法很大一部分都是将其近似求解色彩的问题。

另一个局限性就因为小数据集而产生。一般用于抠图的数据真值(ground truth)是很复杂的,而 alphamatting.com 数据集通过提供标记数据集对抠图研究做出了很重要的贡献。不过因为该数据集仅仅只由 27 张训练图像和 8 张测试图像组成,那么这样大小的数据集会带来自然偏差(nature biased),训练出来的算法也会很难进行泛化。

在这项研究中,我们提出了一种旨在克服这些局限性的方法。我们的方法就是使用深度学习在给定输入图像和三分图的基础上直接计算α蒙版(alpha matte)。我们的神经网络并不首要依赖于色彩信息,它会学习图像的自然结构,并将其反映到α蒙版中。例如毛发(通常需要将其抠出来)就拥有很强的结构和纹理图案,它们通常存在能抽取出的共同结构或α蒙版轮廓。并且由于低层次的特征并不会捕获这些结构,那么就需要深度神经网络去表征它们了。我们的两阶段神经网络包含了编码器-解码器阶段和使用小型残差网络进行精炼阶段。我们是第一个证明了在给定输入图像和三分图的情况下能采用端到端的方式学习到α蒙版。

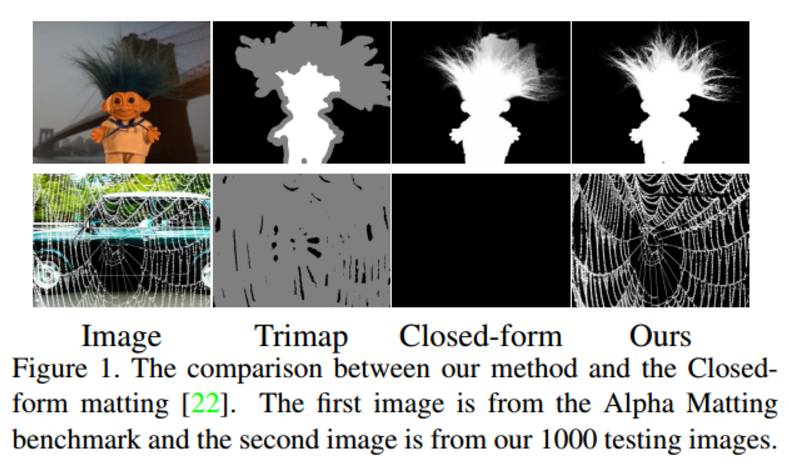

如下图所示,实际上我们能在三分图(trimap)未知前景或背景的情况下产生很好的结果,而在这种情况下,大多数算法都返回不了什么内容。

图 1:我们的方法和封闭形式的抠图(Closed form matting)对比。第一张图像是从 Alpha Matting 基准而来,第二张图像是从我们千张测试图像中抽取的。

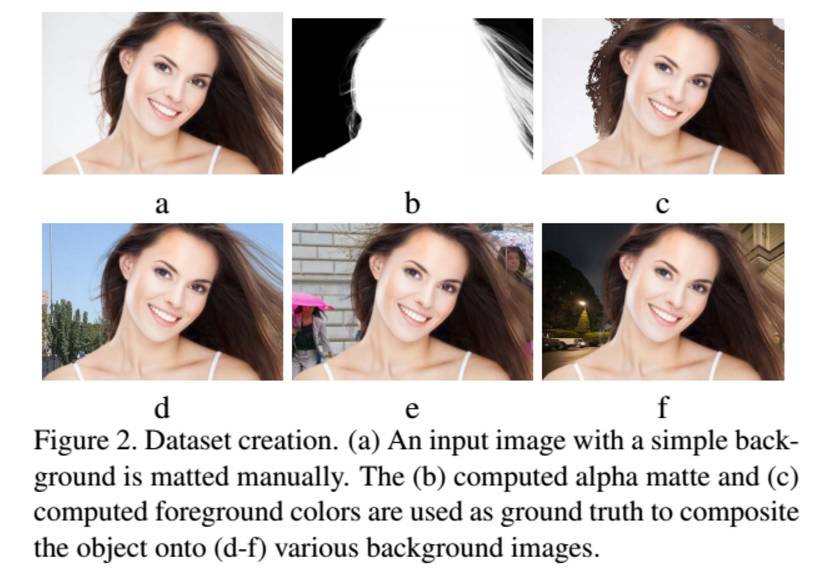

为了训练我们的深度神经网络,如下图所示,我们将识别目标(前景)抠取出来,并放入不同的背景而构建一个大型抠图数据集。

图 2:创建数据集。a) 一张手动抠图的前景图(拥有简单背景)作为输入。b) 经计算的α蒙版。c) 经计算的前景图像,可以作为对象放入到各种背景图像(d-f)中。

我们通过深度学习解决抠图问题。给定一个新的数据集(大规模抠图数据集),我们的神经网络能充分利用这些数据进行训练。并且该神经网络由以下两个阶段组成。

图 3:我们的神经网络由两阶段组成,编码-解码阶段(Sec. 4.1)和精炼阶段 (Sec. 4.2)

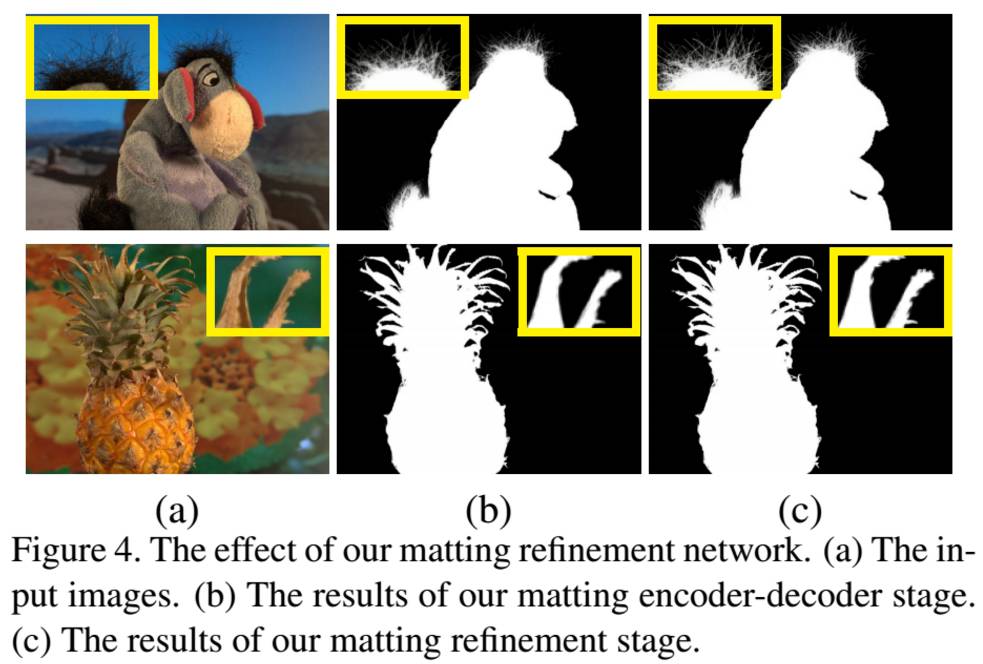

精炼图像的效果在图 4 中展示了。注意,该精炼网络并没有大规模改变α蒙版,只不过是精炼并锐化α值。

图 4:抠图精炼网络的效果。a) 输入图像。b) 编码-解码阶段的输出。c) 精炼阶段的输出结果

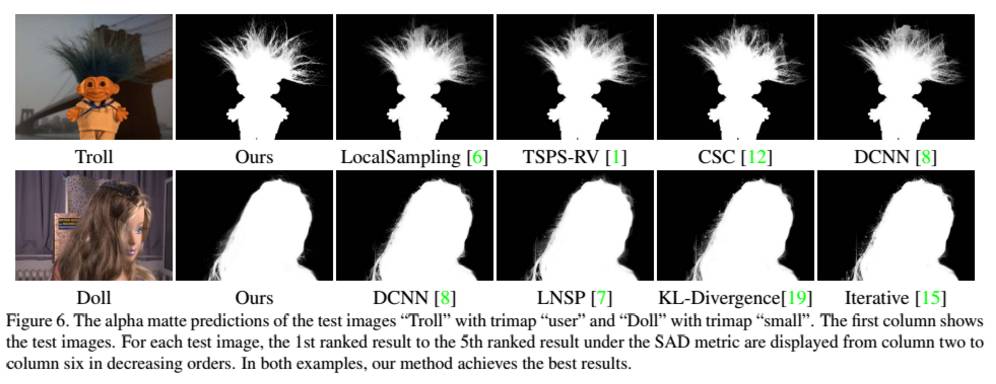

下一张图表明了在 SAD 度量(SAD metric)下的排名结果。

图 6:α蒙版预测使用「user」三分图的「Troll」和「small」三分图的「Doll」作为测试图像。第一列显示了测试图像。对于每一张测试图像,按照降序从第 2 列到第 6 列显示了 SAD 度量(SAD metric)下的排名结果(排名 1 到 5)。在这两个例子中,我们的方法都实现了最好的结果。

结论

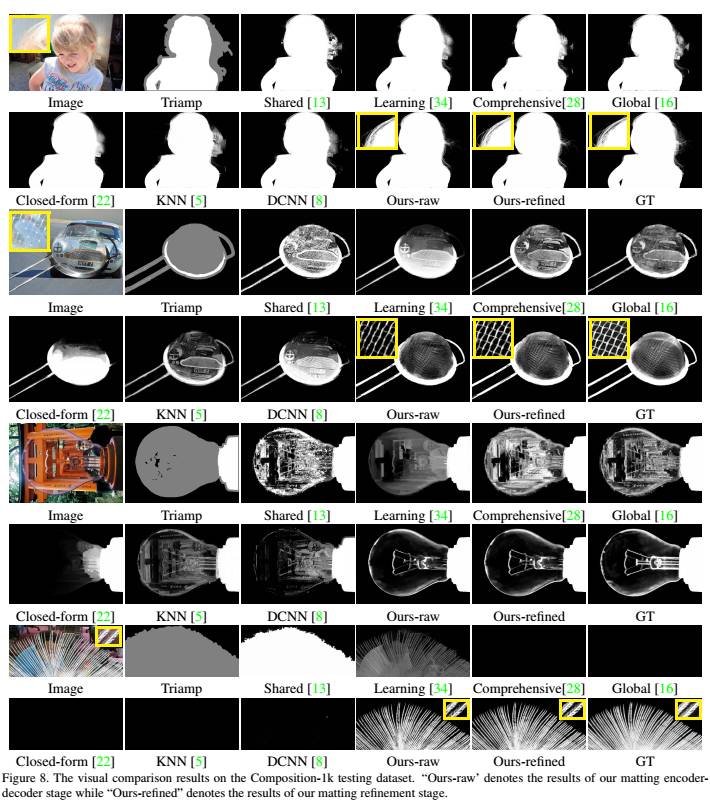

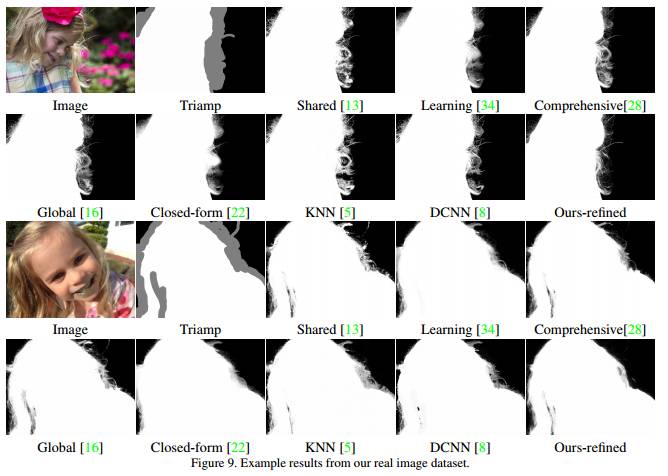

为了泛化到自然图像中,抠图算法必须超越以色彩作为主要线索,并能利用更加结构性和语义性的特征(structural and semantic features)。在该项研究中,我们展示了一种神经网络,它有足够的能力捕捉到高层次特征(high-order features),并利用它们计算且提升抠图效果。实验还展示了我们的方法不仅在标准数据集上优于以前的方法,而且它在泛化到真实图像上也显著地比现存算法表现更优良一些。

机器之心编译,转载请联系本公众号获得授权。

✄------------------------------------------------

加入机器之心(全职记者/实习生):hr@jiqizhixin.com

投稿或寻求报道:editor@jiqizhixin.com

广告&商务合作:bd@jiqizhixin.com