让梦露和龙妈学着你说话,只需一张静态图和一个视频 | 项目开源

十三 发自 凹非寺

量子位 报道 | 公众号 QbitAI

想让名人学着你说话,怎么办?

很简单,只要一张名人的照片,配上你说话的视频,分分钟就能搞定。

来看下效果:

无论你是挤眉弄眼,还是摇头晃脑,照片里的名人们都能跟你神同步!

这就是来自意大利特伦托大学的一项研究:

利用一个一阶运动模型 (First Order Motion Model),静态图也能动起来,换脸也不在话下。

当然,这么有意思的项目,已经开源了!

一个川普在说话,一群史塔克也有话说

其实,这项研究早在数月前便已发表。

当时用的输入视频是川建国同志,静态照片用的是一组《冰与火之歌》史塔克家族及剧中其他人物图片。

效果是这样的:

可以看到,无论川建国同志是眨眼、晃头,史塔克家族的人们做到了神同步。

就连那张标志性的O型嘴,也“模仿”的惟妙惟肖。

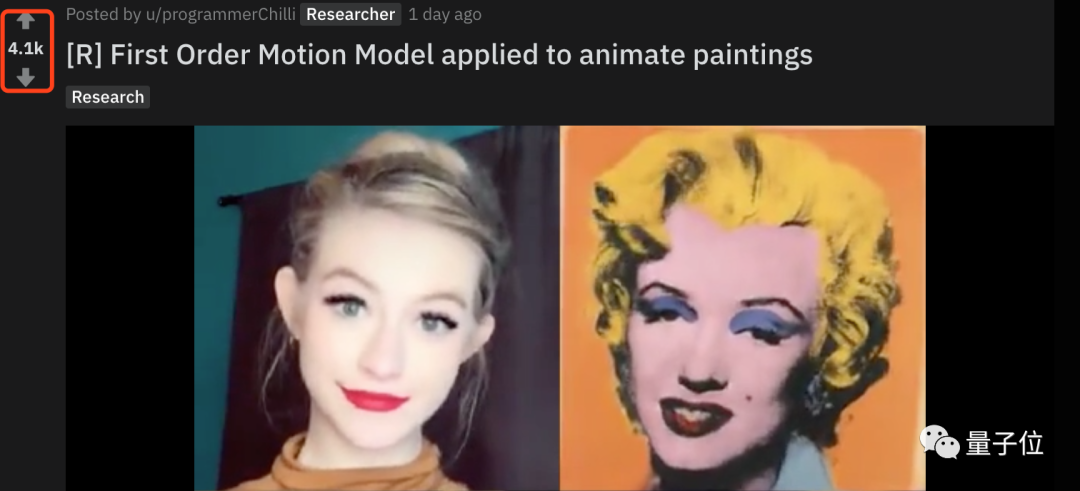

而时隔几个月,这项技术又在Reddit爆火了起来。

一个可能的原因是,这次输入的视频来自流行的短视频平台,也就是说我们自己录一段视频也能用。

加上效果的逼真、有趣,或许用不了多长时间,短视频内容平台可能就会推出这个功能了吧。

当然,这个模型的魔力不止于此。

输入一个模特换pose的视频,再配上多张静态服饰照片,就能批量输出动态展示服装的视频了。

换脸,也是小菜一碟。

不过,也要温馨提醒一句:慎用静态照片,不然出来的效果可能就不太像“阳间的东西”了……

一阶运动模型

在训练阶段,研究人员采用了大量的视频序列集合,包含相同类别的对象。模型通过结合视频中的单帧,和学习到的潜在运动表示,来训练重构视频。

在测试阶段,研究人员将模型应用于由源图像和驱动视频的每一帧组成的对,并执行源对象的图像动画。

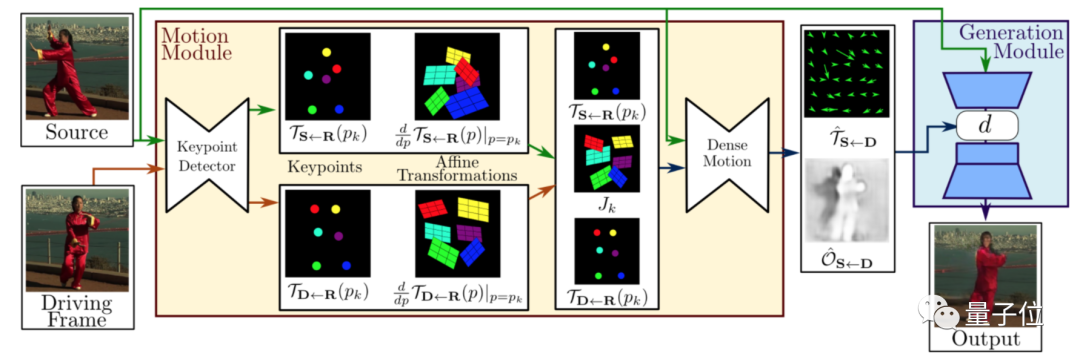

模型的框架就如下图所示:

框架主要由2部分构成:运动估计模块和图像生成模块。

运动估计模块的目的,是预测一个密集的运动场。研究人员假设存在一个抽象的参考框架,并且独立估计两个变换,分别是「从参考到源」和「从参考到驱动」。这样就能够独立处理源帧和驱动帧。

研究人员认为这个步骤是必要的,因为在测试时,模型会接收从不同视频中采样的源图像和驱动帧对,它们在视觉上可能非常不同。

在第一步中,研究人员从稀疏轨迹集近似这两种变换,通过使用以自监督方式学习的关键点来获得。利用局部仿射变换对每个关键点附近的运动进行建模。

在第二步中,密集运动网络结合局部近似得到密集运动场。除此之外,这个网络还输出遮挡的mask,指示哪些图像的驱动部分可以通过源图像的扭曲(warping)来重建,哪些部分应该被绘制(根据上下文推断)。

在第三步中,生成模块按照驱动视频中,提供的源对象移动的图像进行渲染。此处,研究人员使用一个生成器网络,根据密集的运动对源图像进行扭曲,并对源图像中被遮挡的图像部分进行着色。

最后,这个模型已经在GitHub上开源,我们在“传送门”中已经奉上地址链接。

快去试试吧~

传送门

GitHub项目地址:

https://github.com/AliaksandrSiarohin/first-order-model

论文地址:

https://arxiv.org/pdf/2003.00196.pdf

作者系网易新闻·网易号“各有态度”签约作者

— 完 —

抽奖啦~ 智能音箱陪你居家

抽2位小伙伴,各送一台「小度在家1C 红色版智能音箱」!

点击“阅读原文”,转发微博、并关注@量子位,即可参与抽奖,5月1号10点开奖哦 ~

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态

喜欢就点「好看」吧 !