fastHan: 基于BERT的中文NLP集成工具

作者:邱锡鹏(复旦大学计算机科学技术学院教授)

知乎专栏:深度学习&自然语言处理

原文地址,点击文末阅读原文直达:

https://zhuanlan.zhihu.com/p/147665538

简介

fastHan是基于fastNLP与pytorch实现的中文自然语言处理工具,像spacy一样调用方便。

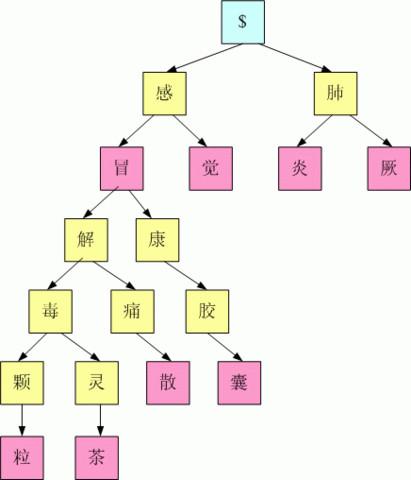

其内核为基于BERT的联合模型,其在13个语料库中进行训练,可处理中文分词、词性标注、依存句法分析、命名实体识别四项任务。fastHan共有base与large两个版本,分别利用BERT的前四层与前八层。base版本在总参数量150MB的情况下各项任务均有不错表现,large版本则接近甚至超越SOTA模型。

项目地址为:

https://github.com/fastnlp/fastHan

安装

fastHan的安装非常简便。它存在如下包的依赖:

fastNLP>=0.5.0

pytorch>=1.0.0

执行指令 pip install fastHan 即可安装。

使用

fastHan的使用非常简单,只需要两步,加载模型、输入句子。

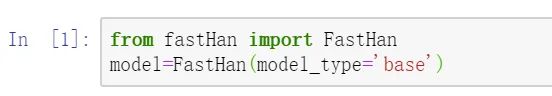

加载模型:执行以下代码即可加载模型:

用户首次初始化模型时模块将自动从服务器下载参数。模型默认初始化base版本,可修改model_type参数值为’large’加载large版本。

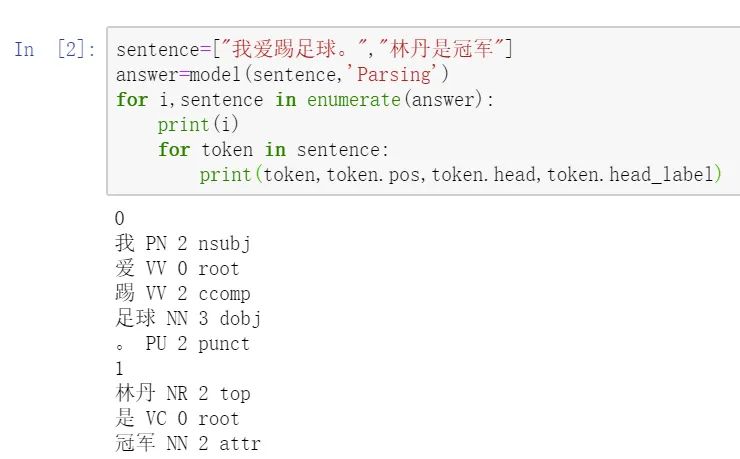

输入句子:输入模型的可以是单独的字符串,也可是由字符串组成的列表。如果输入的是列表,模型将一次性处理所有输入的字符串,所以请自行控制 batch size。模型对句子进行依存分析、命名实体识别的简单例子如下:

其中,target参数可在'Parsing'、'CWS'、'POS'、'NER'四个选项中取值,模型将分别进行依存分析、分词、词性标注、命名实体识别任务,模型默认进行CWS任务。其中词性标注任务包含了分词的信息,而依存分析任务又包含了词性标注任务的信息。命名实体识别任务相较其他任务独立。

模型的输出是在fastHan模块中定义的sentence与token类。模型将输出一个由sentence组成的列表,而每个sentence又由token组成。每个token本身代表一个被分好的词,有pos、head、head_label、ner四项属性,代表了该词的词性、依存关系、命名实体识别信息。

如果分别运行CWS、POS、Parsing任务,模型输出的分词结果等可能存在冲突。如果想获得不冲突的各类信息,可以直接运行包含全部所需信息的那项任务。

模型的POS、Parsing任务均使用CTB标签集。NER使用msra标签集。

正如上图所示,模型基础的使用流程非常简单。此外,模型还可调整分词风格、切换设备。

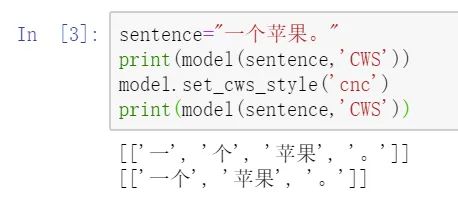

调整分词风格:模型是在13个语料库中进行训练,其中包含了10个分词语料库。不同语料库的分词粒度均不同,如本模型默认的CTB语料库分词粒度较细。如果想切换不同的粒度,可以使用模型的set_cws_style函数,例子如下:

在分词风格中选择'as'、'cityu'可进行繁体字分词,这两项为繁体语料库。由于各项任务共享词表、词嵌入,这意味着即使不切换模型的分词风格,模型对繁体字也具有执行分词及其他任务的能力。此外,模型对数字、英文字母也具有一定的识别能力。

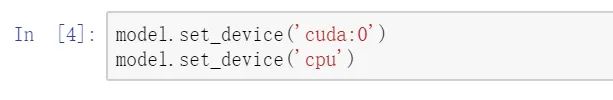

切换设备:可使用模型的set_device函数,令模型在cuda上运行或切换回cpu,示例如下:

模型表现

模型在以下数据集进行测试和训练:

CWS:AS, CITYU, CNC, CTB, MSR, PKU, SXU, UDC, WTB, ZX

NER:MSRA、OntoNotes

POS & Parsing:CTB9

注:模型在训练NER OntoNotes时将其标签集转换为与MSRA一致。

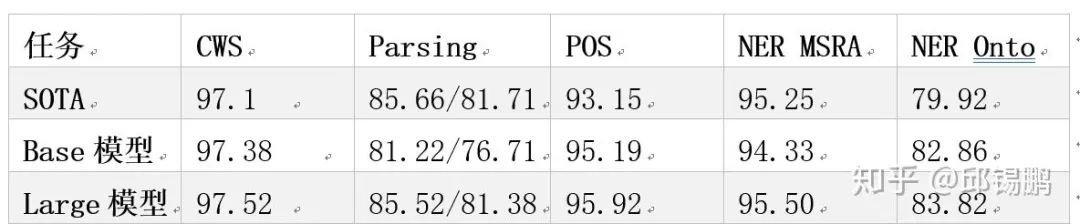

最终模型在各项任务中取得的F值如下:

表格中单位为百分数。CWS的成绩是10项任务的平均成绩。Parsing中的两个成绩分别代表F_{ldep}和F_{udep}。SOTA模型的数据来自笔者对网上资料及论文的查阅,如有缺漏请指正,不胜感激。这五项SOTA表现分别来自如下五篇论文:

[1] Huang W, Cheng X, Chen K, et al. Toward Fast and Accurate Neural Chinese Word Segmentation with Multi-Criteria Learning.[J]. arXiv: Computation and Language, 2019.

[2] Hang Yan, Xipeng Qiu, and Xuanjing Huang. "A Graph-based Model for Joint Chinese Word Segmentation and Dependency Parsing." Transactions of the Association for Computational Linguistics 8 (2020): 78-92.

[3] Meng Y, Wu W, Wang F, et al. Glyce: Glyph-vectors for Chinese Character Representations[J]. arXiv: Computation and Language, 2019.

[4] Diao S, Bai J, Song Y, et al. ZEN: Pre-training Chinese Text Encoder Enhanced by N-gram Representations[J]. arXiv: Computation and Language, 2019.

[5] Jie Z, Lu W. Dependency-Guided LSTM-CRF for Named Entity Recognition[C]. international joint conference on natural language processing, 2019: 3860-3870.

更多关于模型结构、模型训练的信息,未来将在项目网站中进行更新。

推荐阅读

征稿启示| 200元稿费+5000DBC(价值20个小时GPU算力)

文本自动摘要任务的“不完全”心得总结番外篇——submodular函数优化

斯坦福大学NLP组Python深度学习自然语言处理工具Stanza试用

太赞了!Springer面向公众开放电子书籍,附65本数学、编程、机器学习、深度学习、数据挖掘、数据科学等书籍链接及打包下载

数学之美中盛赞的 Michael Collins 教授,他的NLP课程要不要收藏?

关于AINLP

AINLP 是一个有趣有AI的自然语言处理社区,专注于 AI、NLP、机器学习、深度学习、推荐算法等相关技术的分享,主题包括文本摘要、智能问答、聊天机器人、机器翻译、自动生成、知识图谱、预训练模型、推荐系统、计算广告、招聘信息、求职经验分享等,欢迎关注!加技术交流群请添加AINLPer(id:ainlper),备注工作/研究方向+加群目的。

阅读至此了,点个在看吧👇