霉霉 vs AI:谁的歌词写的更好

翻译 | AI科技大本营(rgznai100)

参与 | Shawn

从小到大我一直都是Taylor Swift的死忠粉。上初中时,我的 iPod Nano 里播放最多的就是《Speak Now》。还记得上大二时,我趁着爸妈在睡觉,偷偷在 Tumblr 上熬夜寻找《Red》的 小样,因为我当时买不起这张专辑。

上周霉霉放出了新专辑《Reputation》的首支单曲,为了第一时间听到,作为死忠粉的我苦苦熬了好几天夜。但是当《shattering YouTube records》放出《Look What You Made Me Do》时,我有点……失望。Guys,别误会我,我还是听了至少 20 遍。但是霉霉一贯动人的歌词和好听的旋律哪去了?这首歌怎么充满了仇恨和复仇呢?

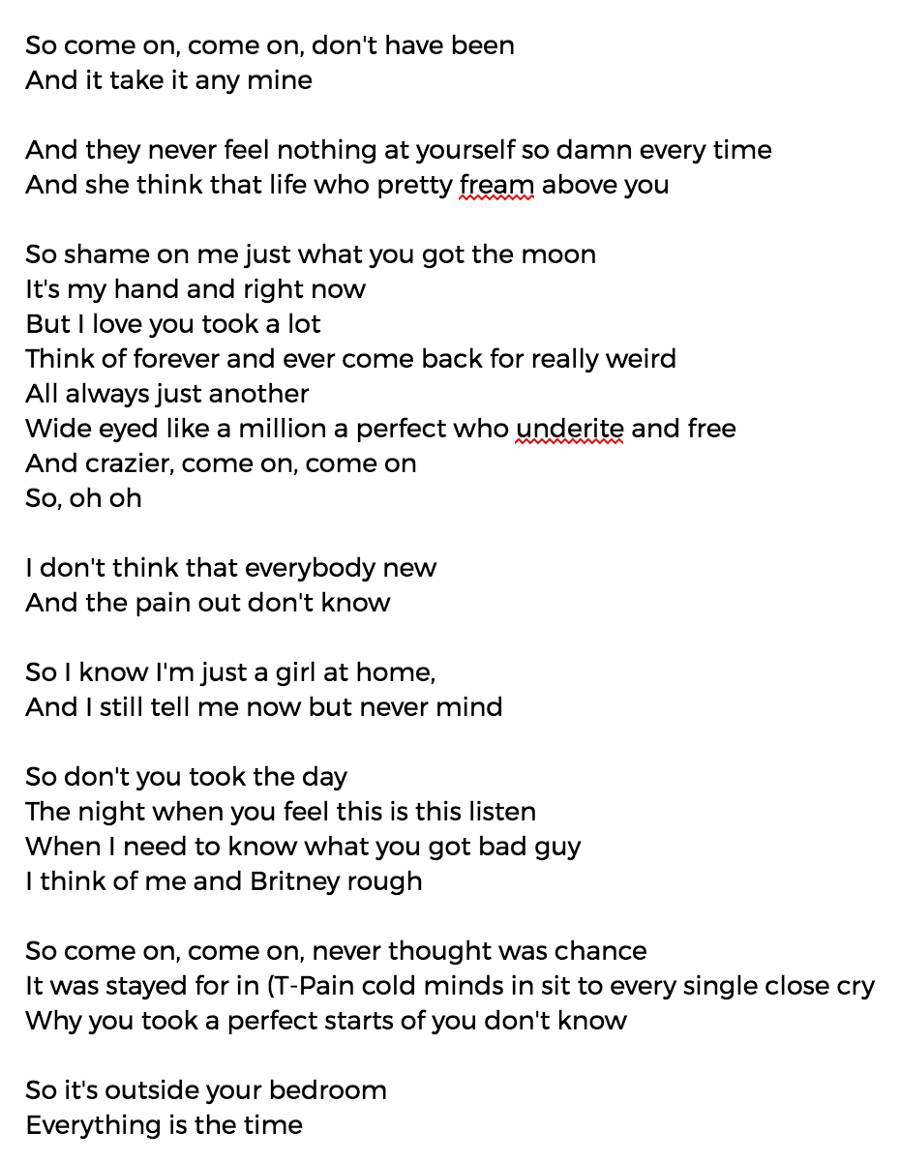

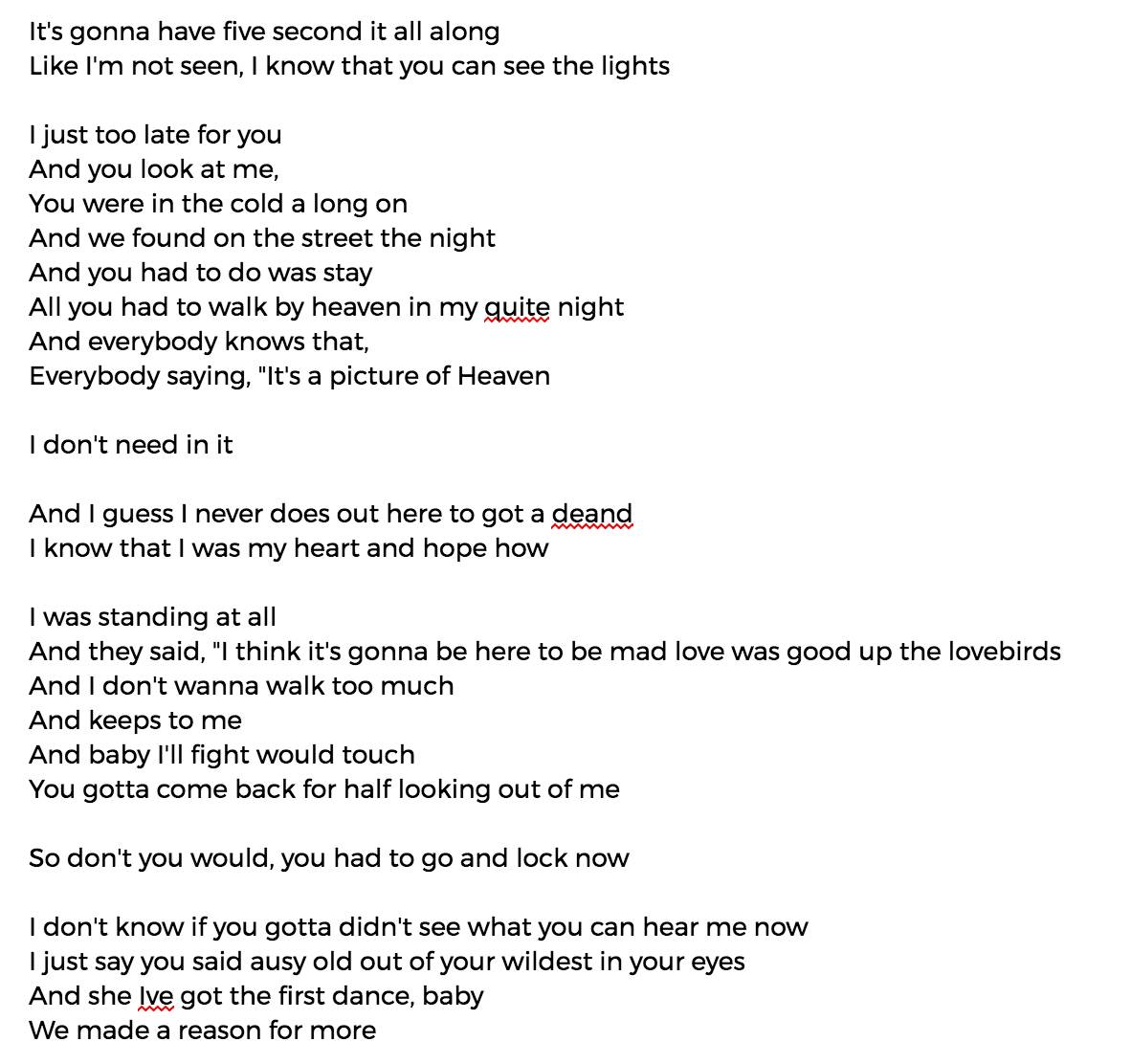

上周,我想看看机器学习(ML)能否拯救一下霉霉的歌?我将霉霉所有歌的歌词输入到一个循环神经网络(RNN)中,并采样了一些新歌词。以下就是我得到的结果(一点也没改,直接从复制粘贴的):

歌词1

“Anything a good taft?”听起来有些怪啊。但是还是有些能够打动我的歌词,如 “Your love through all” 或“I don’t wanna see the way”。

https://github.com/shreyashankar/char-rnn-tensorflow

原文地址

https://medium.com/towards-data-science/https-medium-com-sh-reya-taylor-swift-or-artificial-intelligence-19f2989ab7a4

精选福利

关注AI科技大本营,进入公众号,回复对应关键词查看分类专题;回复“入群”,加入AI科技大本营学习群。

回复“深度学习”,一文囊括30篇深度学习精华文章。

回复“机器学习”,一文推荐30篇机器学习优质文章。

回复“访谈”,查看吴喜之、周志华、杨强、蚂蚁金服漆远、今日头条李磊的独家访谈实录。

回复“资源”,一文梳理机器学习,深度学习,神经网络等各方面的资源。

回复“视频”,5分钟的视频带你轻松入门人工智能。

回复“程序员”,带你了解别人家的程序员如何学好AI。

回复“数据”,帮你弄清楚人工智能与数据科学之前的关系。

回复“课程”,跟我一起免费学习:谷歌大脑深度学习&Fast.ai最实战深度学习&David Silver深度强化学习。

2012 年 10 月上市的第七代 iPod nano,配备 2.5 寸触摸显示屏,有八种颜色,使用最新的 Lightning 数据接口。

2012 年 10 月上市的第七代 iPod nano,配备 2.5 寸触摸显示屏,有八种颜色,使用最新的 Lightning 数据接口。