中科院提出TargetDrop:一种用于CNN的新正则化方法

点击上方“CVer”,选择加"星标"置顶

重磅干货,第一时间送达

本文转载自:AI人工智能初学者

本文提出TargetDrop:一种新的正则化方法,其结合了注意力机制以删除判别特征单元,实验证明,性能优于AttentionDrop、DropBlock等正则化方法。

作者单位:中科院, 国科大

1、简介

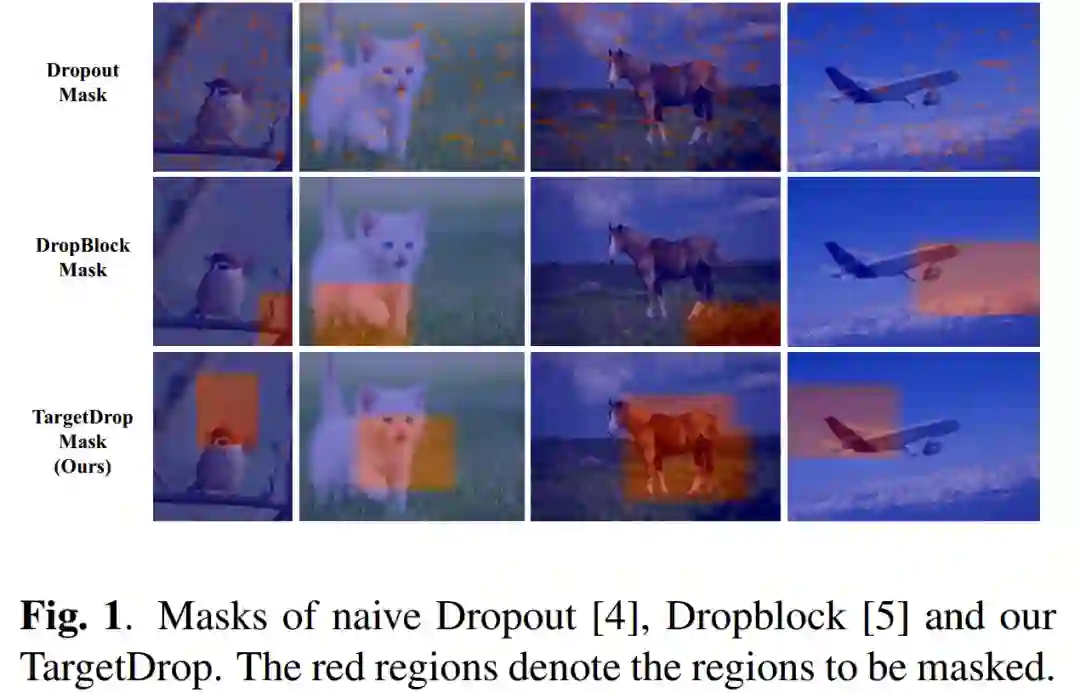

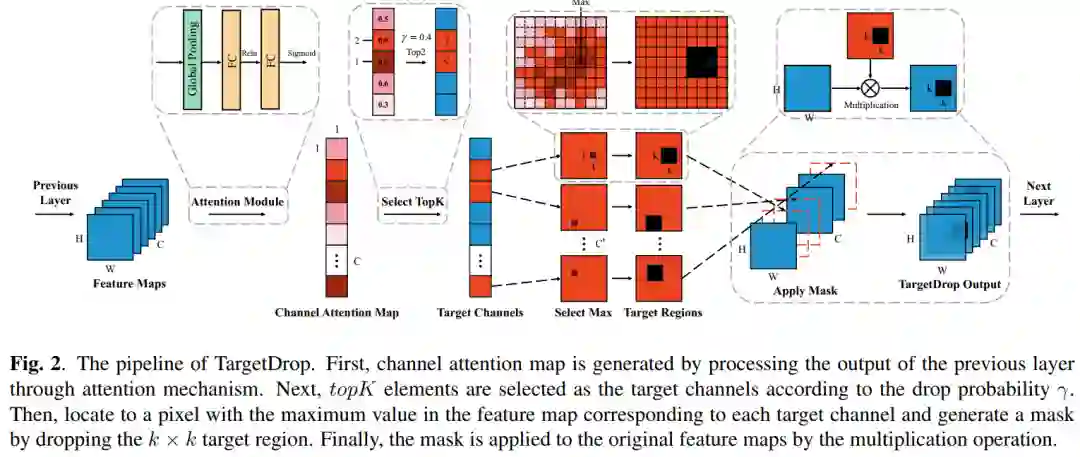

Dropout正则化已在深度学习中广泛使用,但对卷积神经网络的效果不佳,因为空间相关的特征允许丢弃的信息仍流经网络。已经提出了一些结构化的dropout形式来解决此问题,但是由于特征被随机丢弃,容易导致正则化过度或不足。在本文中提出了一种名为TargetDrop的正则化方法,该方法结合了注意力机制以删除区分特征单元。具体地,其掩盖了与目标通道相对应的特征图的目标区域。与其他方法进行比较或应用于不同网络的实验结果证明了我们方法的正则化效果。

2、本文方法

2.1、Target Channels

这里给出输出的前一层卷积,其中H和W分别表示Feature Map的高度和宽度,C是channel的个数;

第1步:

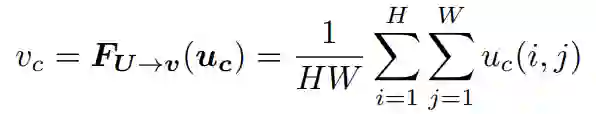

首先是使用了全局平均池化操作,该向量

可视为通过空间维度H*W收缩产生的统计量,该操作F可定义为:

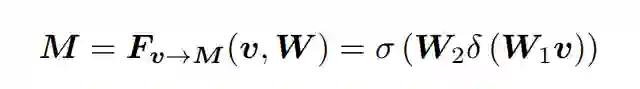

式中, 表示 向量的第c个元素,为了进一步捕获channel上的依赖关系,向量被转发到共享网络以生成channel attention map M,共享网络由2个FC层和2个激活层,分别由参数为 的降维层、ReLU、参数为 的增维层与Sigmoid函数交替连接:

这里,r是调整瓶颈的缩减率。

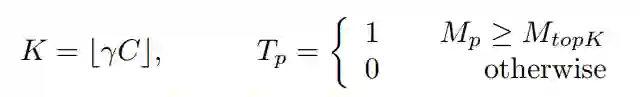

第2步:

对M中的所有值进行排序,根据drop probability(drop probability),以top K的值为目标(标签“1”表示被选中,否则为“0”)。

式中, 和 表示M和T的第p个元素。在此基础上进一步从原始的H*W特征图中选取目标通道对应的目标区域。

2.2、Target Regions

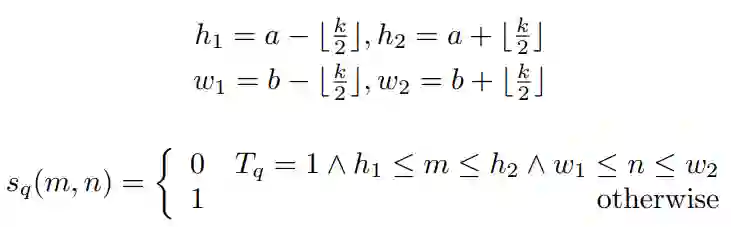

对于与目标通道对应的每一个feature map,在卷积操作中利用空间注意力机制进一步寻找一个具有较多鉴别信息的区域。如卷积核大小为7×7的卷积操作是不必要的,可能会导致大量的额外计算。考虑到图像像素值的连续性,可以简单地定位到一个最大的像素,而分布在周围连续区域的其他top值最有可能是主要对象的某些关键特征。因此选择位置最大值(a,b),并去掉以其为中心的k×k区域。 表示目标区域的边界,TargetDrop掩码 可以描述为:

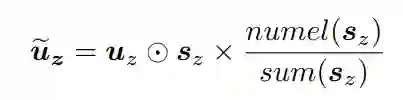

其中 和 表示s和T的第q个元素。最终输出为,最后对Feature进行mask掩码和NormLize操作:

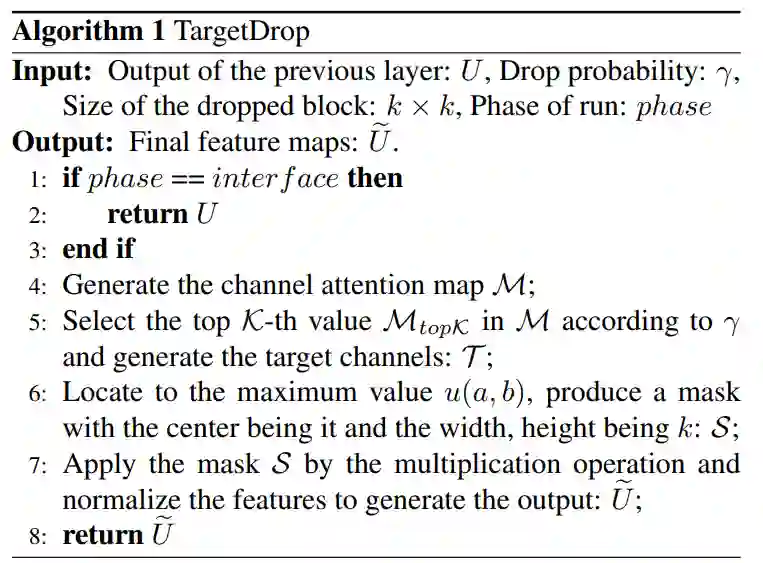

2.3、TargetDrop

3、实验

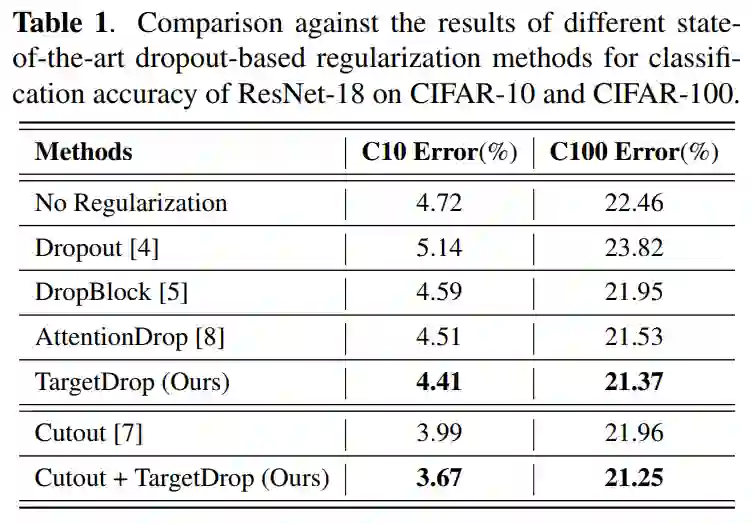

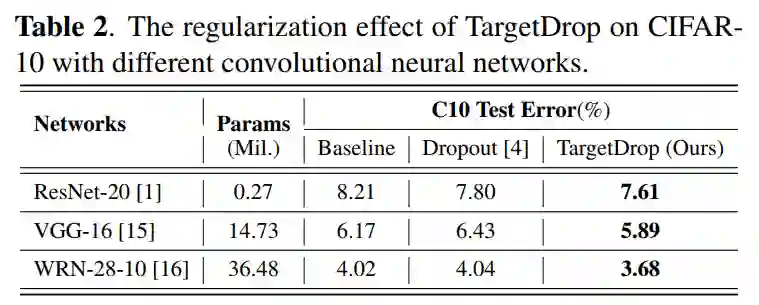

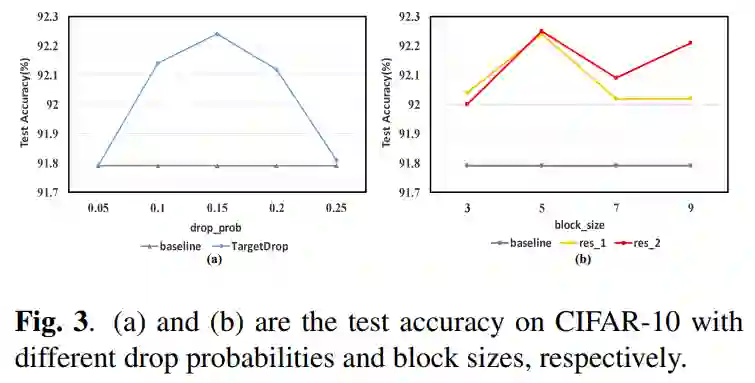

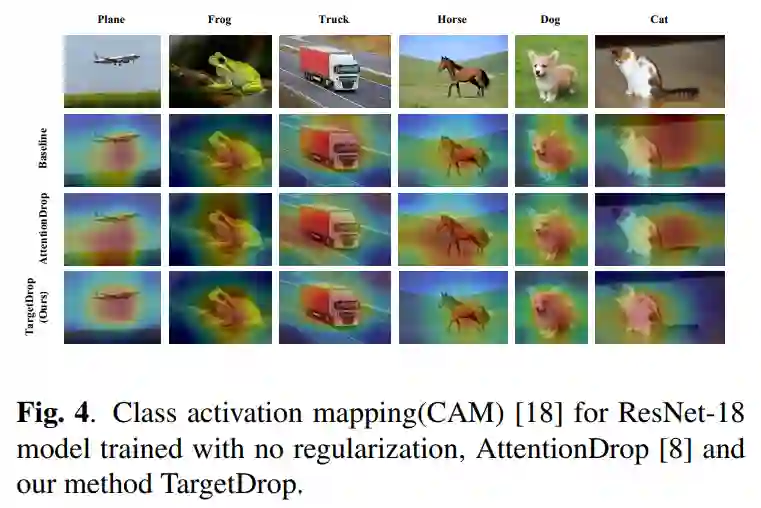

文中主要是比较了TargetDrop与其他最先进的基于dropout的方法在CIFAR-10和CIFAR-100上的实验,并将其应用于不同的体系结构。进一步分析了超参数的选择和类激活映射的可视化。

通过以上的2组表格可以看出相较于DropOut、DropBlock、AttentionDrop以及CutOut等方法,TargetDrop错误率更低;

通过类激活映射也可以看出,基于TargetDrop的方法对于检测的区域更加的精准和集中。

由于笔者能力和时间有限,其中有理解错误的地方还请担待,如果想了解更多详细信息,可以参考论文原文。

参考:[1].TARGETDROP:A TARGETED REGULARIZATION METHOD FOR CONVOLUTIONAL NEURAL NETWORKS

论文地址:https://arxiv.org/abs/2010.10716

论文PDF下载:

上述论文已打包好,在CVer公众号后台回复:TargetDrop,即可下载论文PDF,推荐阅读学习!

下载1

在CVer公众号后台回复:PRML,即可下载758页《模式识别和机器学习》PRML电子书和源码。该书是机器学习领域中的第一本教科书,全面涵盖了该领域重要的知识点。本书适用于机器学习、计算机视觉、自然语言处理、统计学、计算机科学、信号处理等方向。

PRML

下载2:CVPR / ECCV 2020开源代码

在CVer公众号后台回复:CVPR2020,即可下载CVPR 2020代码开源的论文合集

在CVer公众号后台回复:ECCV2020,即可下载ECCV 2020代码开源的论文合集

重磅!CVer-论文写作与投稿交流群成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满2400+人,旨在交流顶会(CVPR/ICCV/ECCV/NIPS/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI/TIP等)、SCI、EI、中文核心等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

整理不易,请给CVer点赞和在看!