【泡泡一分钟】基于无标记人体的形态和姿势的实时精准估计(3dv-61)

每天一分钟,带你读遍机器人顶级会议文章

标题:Towards Accurate Marker-less Human Shape and Pose Estimation over Time

作者:Yinghao Huang, Federica Bogo, Christoph Lassner, Angjoo Kanazawa, Peter V. Gehler, Javier Romero, Ijaz Akhter, Michael J. Black

来源:3dv 2017 ( International Conference on 3D Vision)

播音员:zzzzzq

编译:Fei(88)

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

现有的无标记运动捕捉方法通常假设背景已知,静态相机和特定路线的运动先验,这些假设限制了它们的应用场景。这里我们提出了一个全自动的方法,给出了多视图视频,估计3D人体姿势和身体形态。我们采取了最近提出的SMPLify方法[12]作为基础方法,并以几种方式扩展它。首先,我们使一个3D人体模型和在多视图图像中检测到的2D特征相匹配;第二,我们使用CNN方法来分割每个图像中的人物,并用三维人体模型和这些轮廓相匹配拟合,进一步提高准确性;第三,我们利用一个通用的、鲁棒的DCT短时先验,来处理往往是由2D姿态估计引起的左右侧交换问题。验证标准基准的测试显示我们的结果和之前的结果相比是无比优越的,同时我们的方法也可以提供一个逼真的3D形状化模型。我们也将其应用于HumanEva的例子和挑战了一个YouTube上的单目跳舞序列,都得到了准确的结果。

补充说明:

文中的方法为MuVS(Muti-View SMPLify),对比之前的方法,MuVS限制条件更少,且误差更小。

·文中的方法得到的结果更准确、真实、自然,并且整个过程都是自动生成的

图1 从上而下:输入例子;由[39]中方法得到的3D姿态估计网格;由MuVS得到的3D姿态估计网格

·可利用DCT短时先验帮助解决换腿问题

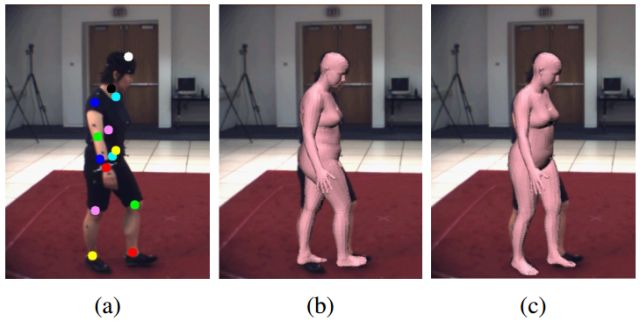

图3 a)换腿的姿态检测;b)没有结合DCT短时先验时的MuVS方法结果;c)结合DCT短时先验时的MuVS方法结果

·MuVS方法比单视图的SMPLify方法表现得更好

图4 左边栏图是应用SMPLify方法得到的结果;右边栏图是应用MuVS方法得到的结果

Abstract

Existing markerless motion capture methods often assume known backgrounds, static cameras, and sequence specific motion priors, limiting their application scenarios. Here we present a fully automatic method that, given multi-view videos, estimates 3D human pose and body shape. We take the recently proposed SMPLify method [12] as the base method and extend it in several ways. First we fit a 3D human body model to 2D features detected in multi-view images. Second, we use a CNN method to segment the person in each image and fit the 3D body model to the contours, further improving accuracy. Third we utilize a generic and robust DCT temporal prior to handle the left and right side swapping issue sometimes introduced by the 2D pose estimator. Validation on standard benchmarks shows our results are comparable to the state of the art and also provide a realistic 3D shape avatar. We also demonstrate accurate results on HumanEva and on challenging monocular sequences of dancing from YouTube.

[12] F. Bogo, A. Kanazawa, C. Lassner, P.Gehler, J. Romero, and M. J. Black. Keep it smpl: Automatic estimation of 3d human pose and shape from a single image. In European Conference on Computer Vision, pages 561–578. Springer, 2016.

[39] H. Rhodin, N. Robertini, D. Casas, C. Richardt, H.-P. Seidel, and C. Theobalt. General automatic human shape and motion capture using volumetric contour cues. In European Conference on Computer Vision, pages 509–526. Springer, 2016.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

链接: https://pan.baidu.com/s/1uo4sPd1lrdX2JdTeUjCXUg 密码: wnhr

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com