CVPR 2020 | CMU & HKUST提出binary网络自动化搜索,同时实现超高压缩与高精度

这项工作由卡内基梅隆大学,香港科技大学合作完成,目的是通过网络自动化搜索,找到在已知网络的权重(weight)和激活值(activation)都为二值化{-1,+1}的情况下,搜索最能充分利用二值化卷机层的表达能力的网络结构。

该工作是第一篇在 depth-wise 的卷积中通过搜索 group conv 来实现网络二值化的算法。实验结果表明,本方法能取得和接近 XNOR-Net 的精度,而所需的 FLOPs 仅约为 XNOR-Net 的 1/5。借助于 Matrix 层面的参数共享机制,整个搜索过程只需要~30 GPU hours。

论文标题:Binarizing MobileNet via Evolution-based Searching

论文来源:CVPR 2020

论文链接:https://arxiv.org/abs/2005.06305

深度卷积神经网络(CNN)量化是一种常用的网络压缩方法,而网络二值化是极端情况下的量化,即每个 weight 和 activation 仅用 -1 或 +1 表示。 一方面,在这种极端压缩的情况下,网络的表达能力会受到非常大的限制。另一方面,近来越来越多的学者以及工程师更加关心如何压缩哪些原本就经过了紧凑型网络设计的小网络,如 MobileNet。这就给网络量化提出了新的挑战。

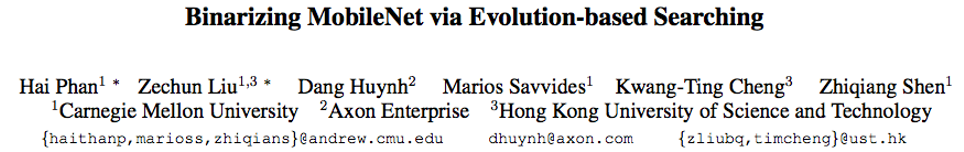

为了应对这一挑战,本文从 MobileNet 网络框架出发,根据二值化网络特性,搜索最佳网络结构。在分析二值化网络的表达能力的时候我们发现,当二值化卷机层是 depth-wise 卷积时,输出的 feature map 中的激活值的取值范围将局限于(-3x3,3x3)之间,由此也导致了 binarize MobileNet 难以收敛。而如果把 MobileNet 中的 depth-wise 卷积替换成全卷积,则会导致參数量增加,从而降低二值化网络的高压缩率。

为了取得压缩率与网络精度之间的权衡,我们认为,每一层卷积对应的feature的抽象化程度不同,因此,对于表达能力的要求也不一样。基于这个假设,我们提出用网络自动搜索(NAS)的方法搜索每一层的组卷积的最优group数,作为depth-wise 卷积和全卷积之间的trade-off。

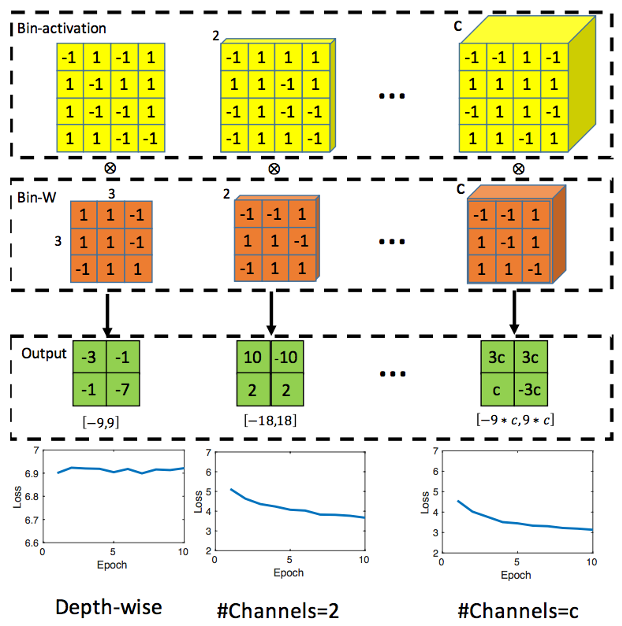

我们的框架基于 one-shot architecture search,包含三步:

第一步:训练一个参数共享网络。

第二步:用遗传算法在参数共享网络中搜索出最优的 每一层组卷积的 group 数目。

第三步:训练搜索得到的最优网络。

特别的,在训练参数共享网络时,我们为组卷积搜索设计了 matrix-level 的参数共享。

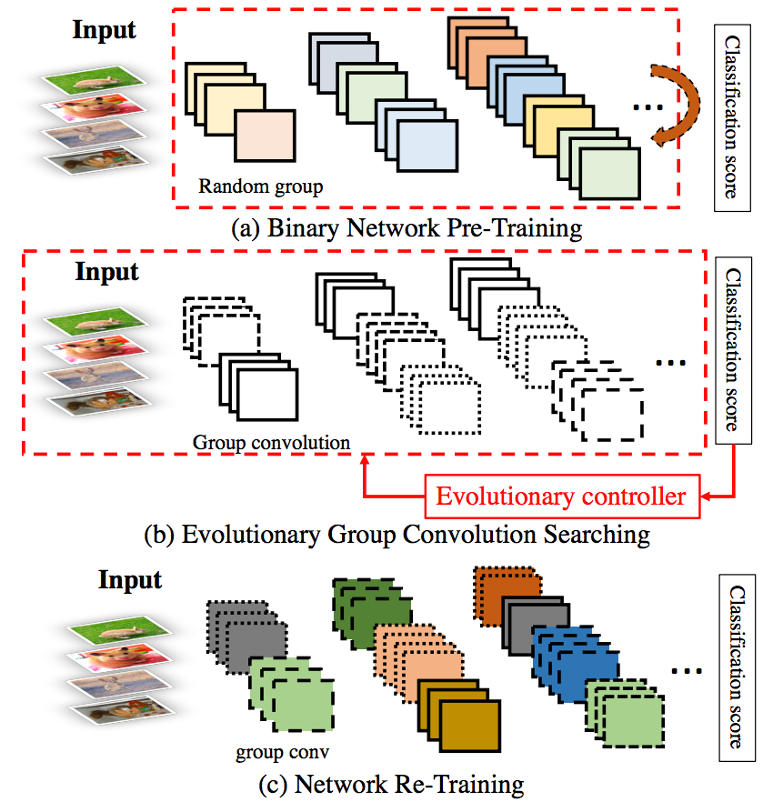

如图所示,在一个输入 6 通道输出 6 通道的卷机层中,可以选取的 group 数目为 1,2,3,6。group=1 时为全卷积,训练参数为存储的所有 weights。当 group=6 时为 depth-wise 卷积,训练参数为对角线上的所选 weights。为了方便直观化表示,下图的每一个 cell 代表了一个 3x3 的卷积核。

实验结果

更多阅读

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。