【泡泡点云时空】通过核相关及图池化挖掘点云局部结构(CVPR2018-12)

泡泡点云时空,带你精读点云领域顶级会议文章

标题:Mining Point Cloud Local Structures by Kernel Correlation and Graph Pooling

作者:Yiru Shen, Chen Feng, Yaoqing Yang, Dong Tian

来源:CVPR2018 ( IEEE Conference on Computer Vision and Pattern Recognition)

编译:郑英林

审核:李敏乐

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

简介

与图像不同,由于自然无序的数据结构,使用深度网络的3D点云的语义学习具有挑战性。

在现有的工作中,PointNet通过直接学习点集取得了可喜的成果。然而,它没有充分利用包含细粒度结构信息的点的局部邻域。

在这方面,我们提出了两项新的操作,以更有效地利用局部结构来改进PointNet。第一个侧重于局部3D几何结构。类似于图像的卷积核,我们将点集内核定义为一组可学习的3D点,它们根据由核相关性度量的几何亲和力联合响应一组相邻数据点,改编自点云配准的相似性技术。第二个操作通过在从3D位置计算的最近邻图上的递归特征聚合来利用局部高维特征结构。

总的来说,我们使用一个简单的基于图的网络,KCNet:构造K最近邻图(KNNG)以利用邻域信息进行核相关,并递归地在每个节点邻域中进行最大池化操作,洞察到局部点共享相似的几何结构。 实验表明,我们的网络可以有效地捕获局部信息,并在主要数据集上鲁棒地实现更好的性能。

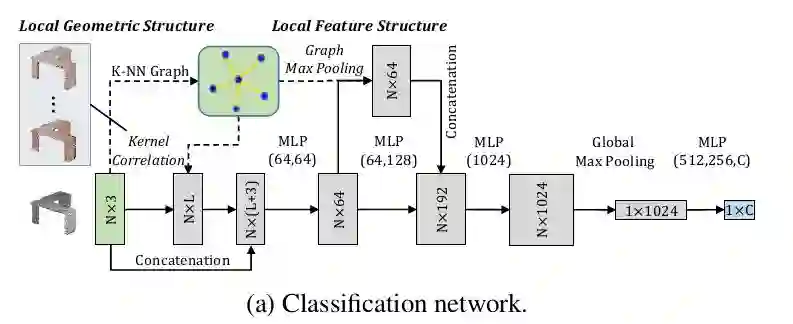

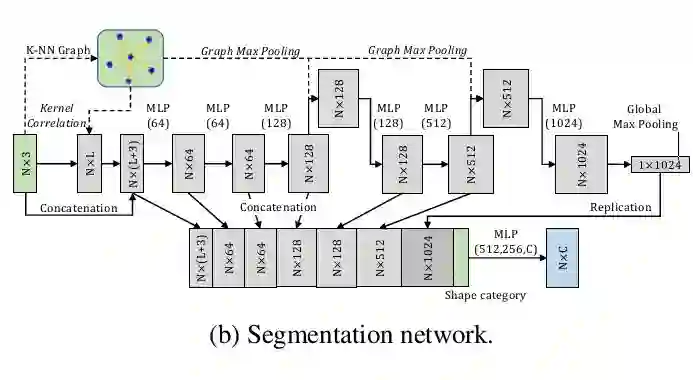

图2 显示了KCNet架构。前端核相关层利用局部几何结构计算每个数据点的K个最近邻点和L个点集内核之间的不同亲和度,每个内核包含M个可学习的3D点。得到的响应与原始3D坐标连接。稍后,图池化层将利用局部特征结构,每个3D对象实例共享相同的从点云的3D欧几里德邻域离线构建的图。

图1 学习到的核相关可视化

该图显示了内核点位置和宽度,如球体中心和半径(顶行),以及5个内核对4个对象的相应滤波器响应(其他行)。颜色表示在每个对象中标准化的亲和力(红色:最强,白色:最弱)。

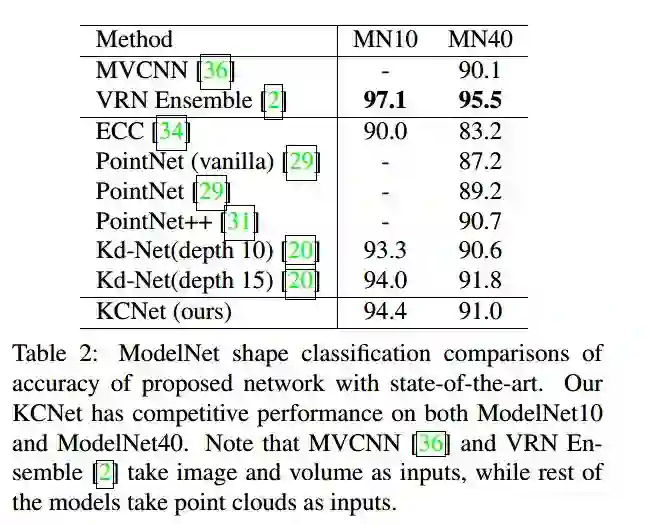

表2 显示了 所提出KCNet和其他最先进网络在 ModelNet形状分类的精确度。

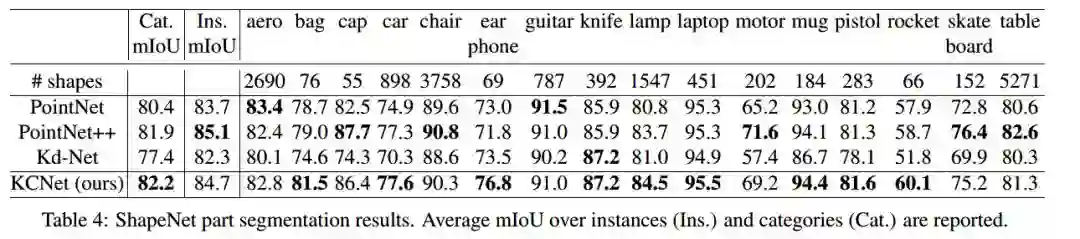

表4 显示了 KCNet在 ShapeNet part segmentation 的结果。

Abstract

Unlike on images, semantic learning on 3D point clouds using a deep network is challenging due to the naturally unordered data structure. Among existing works, Point-Net has achieved promising results by directly learning on point sets. However, it does not take full advantage of a point’s local neighborhood that contains fine-grained structural information which turns out to be helpful towards better semantic learning. In this regard, we present two new operations to improve PointNet with a more efficient exploitation of local structures. The first one focuses on local 3D geometric structures. In analogy to a convolution kernel for images, we define a point-set kernel as a set of learnable 3D points that jointly respond to a set of neighboring data points according to their geometric affinities measured by kernel correlation, adapted from a similar technique for point cloud registration. The second one exploits local high-dimensional feature structures by recursive feature aggregation on a nearest-neighbor-graph computed from 3D positions. Experiments show that our network can efficiently capture local information and robustly achieve better performances on major datasets. Our code is available at http://www.merl.com/research/license#KCNet

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com