目标检测竞赛利器:中星微一步法模型获国际算法竞赛第一名!

新智元报道

来源:中星微

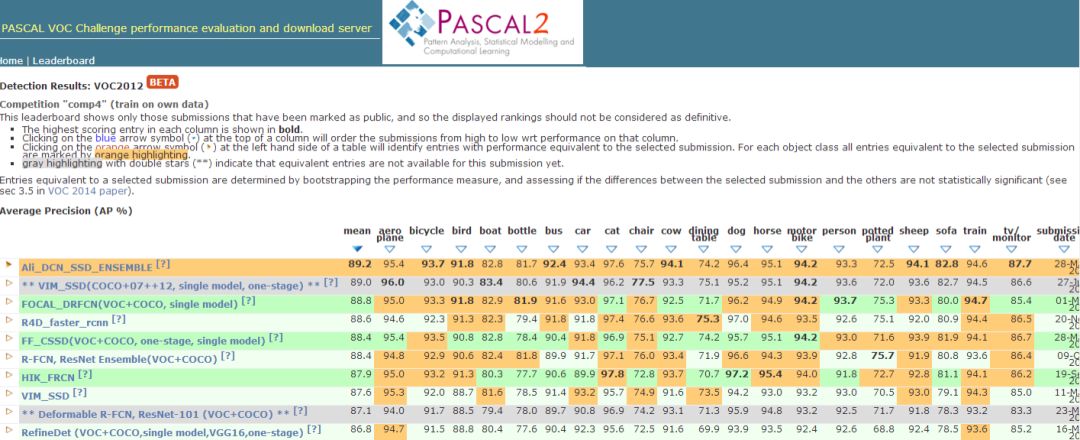

【新智元导读】近日,在国际计算机视觉竞赛PASCAL VOC,中星微以89.0分的总成绩位列第一,获得目标检测单模型第一名。获胜的模型是一步法的目标检测模型,本文带来技术详解。

近日,在PASCAL VOC comp4目标检测竞赛中,中星微再创佳绩,获得了目标检测单模型第一名。

Pascal VOC是世界计算机视觉领域知名的竞赛,比赛中,参赛者要对人、猫、鸟、飞机、汽车、船、盆栽等20类物体进行检测。由于训练样本较少,场景变化多端,非常具有挑战性。中星微人工智能参赛团队VIM_SSD以89.0分的总成绩位列第一。

中星微人工智能芯片技术公司董事长兼总经理张韵东表示:“本次参赛的模型适合终端设备部署的简单模型一步法算法,能够取得与云端服务器复杂多模型算法相媲美的结果,实属不易。作为人工智能芯片公司,我们不仅要在芯片设计方面精益求精,同时更要在算法的精简优化方面取得突破,为客户提供前端智能设备的整体解决方案。”

中星微本次提交的深度学习模型和上次参加比赛的深度学习模型基本一致,仍然沿用了一步法的目标检测模型,基础网络采用VGG16,并未使用ResNet-101, ResNet-152等更复杂的网络,保证精度的情况下速度更快。第一次参加比赛的成绩是87.6,这次是89.0,精度提高很多。该结果不仅领先于所有的一步法算法,同时击败了所有的二步法算法。

中星微人工智能芯片技术公司研发副总裁艾国表示:“本次我们深度学习模型是上次模型的全面升级,仍然沿用了一步法的网络架构,重点改进和优化了训练相关的方法和技术,在不增加算法复杂度的情况下,使得网络的精度越来越高,这是我们公司要打造的核心技术。在前端嵌入式设备计算资源受限的情况下,我们通过调整网络结构和训练的方法提高精度,而不是不断增加网络复杂度。”

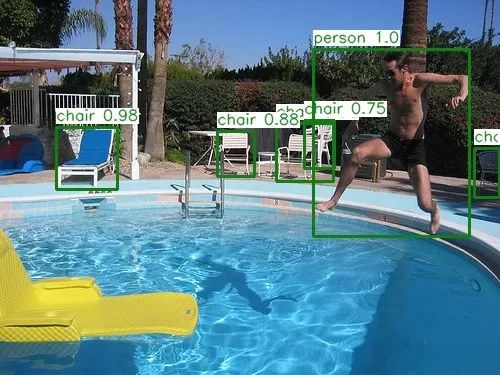

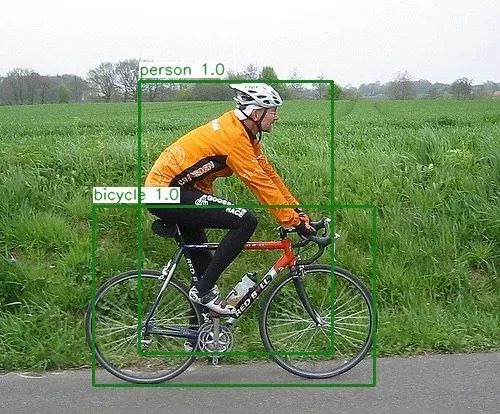

VOC 2012数据集图片测试结果

多模型融合是深度学习比赛中经常使用到的一个利器,它通常可以在各种不同的机器学习任务中使结果获得提升。顾名思义,多模型融合就是综合考虑多个不同模型的情况,并将它们的结果融合到一起。

虽然通过模型进行融合往往效果较好,但是其实现代价和计算开销也比较大。目前,中星微主要是从实际项目应用的角度来考虑,特别是前端应用,一般都是单模型。当然,后期也会考虑使用模型融合,来提升比赛结果的精度。

下表是目前PASCAL VOC竞赛前十名,可以看出,下面算法中大部分应用了更复杂的基础网络ResNet-101和ResNet-152,并且是两步法,也有多模型融合(ensemble)。而中星微的模型不仅是单模型,而且是一步法,在嵌入式NPU可以达到很高的帧率。

Method |

Backbone |

mAP (%) |

||

Ali_DCN_SSD_ENSEMBLE |

ResNet-101 |

89.2 |

ensemble |

|

VIM_SSD(COCO+07++12, single model, one-stage) |

VGG16 |

89.0 |

one-stage |

single |

FOCAL_DRFCN(VOC+COCO, single model) |

ResNet-152 |

88.8 |

two-stage |

single |

R4D_faster_rcnn |

- |

88.6 |

- |

- |

FF_CSSD(VOC+COCO, one-stage, single model) [?] |

ResNet101 |

88.4 |

one-stage |

single |

R-FCN, ResNet Ensemble(VOC+COCO) |

ResNet |

88.4 |

two-stage |

ensemble |

HIK_FRCN |

ResNet-101 |

87.9 |

two-stage |

single |

VIM_SSD |

VGG16 |

87.6 |

one-stage |

single |

Deformable R-FCN, ResNet-101 (VOC+COCO) |

ResNet-101 |

87.1 |

two-stage |

single |

RefineDet(VOC+COCO,singlemodel,VGG16,one-stage) |

VGG16 |

86.8 |

one-stage |

single |

阿里巴巴达摩院多模型融合网络Ali_DCN_SSD_ENSEMBLE的得分是89.2,只比中星微单模型网络高了0.2点,而阿里巴巴达摩院FF_CSSD(VOC+COCO, one-stage, single model)一步法单模型的精度是88.4,基础网络是ResNet101,和中星微差了0.6个点。

目标检测技术应用广泛,是AI场景落地的关键性技术之一。中星微的深度学习模型运行在前端智能设备(如智能摄像头上),广泛用于安防监控、安全生产、环境保护、个人健康监测等领域。

下面是一个环境保护的例子,在我国西部及藏区应用,其采用人工智能、深度学习对野生保护动物进行检测、识别、统计。从而达到对野生动物保护,生态环境平衡的目标。根据国家要求,增强保护野生动物、保护环境的意识,特别是对濒临灭绝的野生动物的研究和保护,更要加大力度;要从科研、技术角度解决野生动物保护和数量的实时状态。

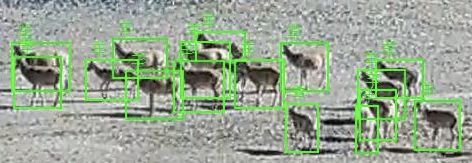

如下图,是对藏羚羊的检测、识别、统计:

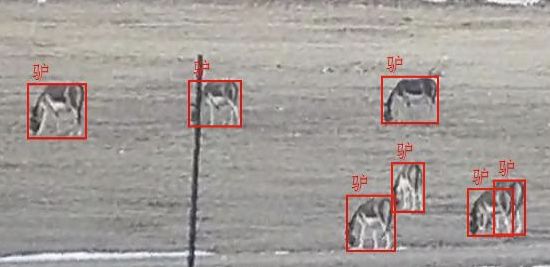

如下图,是对藏野驴的监测、识别、统计:

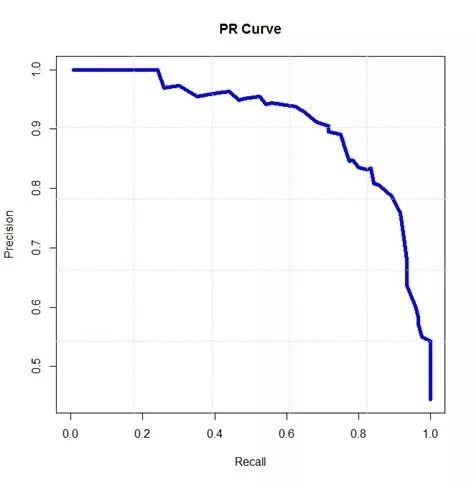

精度:目标检测中衡量识别精度的指标是mAP(mean average precision)。在多个类别物体检测中,每一个类别都可以根据recall和precision绘制一条曲线,AP就是该曲线下的面积,mAP是多个类别AP的平均值,理论上最高mAP为1.0,也就是我们说的100分,89分其实就是0.89 mAP,下面是示例说明。

前端智能和云端智能:前端智能是将智能分析算法嵌入到前端设备,拿安防摄像机举例,就是摄像机采集的视频内容立即进行分析,提取出画面中关键的、感兴趣的、有效的信息,形成结构化的数据。前端智能因受各种资源限制,需要对算法复杂度、网络模型大小等有限制。

云端智能是将前端传感器采集的数据通过云端来完成智能分析,一般通过大型的GPU服务器来完成。因此相对于前端智能,计算资源、内存资源、存储资源、网络资源等都较大,因此对算法模型的限制比较小,可以部署很大的很复杂网络模型。

【加入社群】

新智元 AI 技术 + 产业社群招募中,欢迎对 AI 技术 + 产业落地感兴趣的同学,加小助手微信号: aiera2015_3 入群;通过审核后我们将邀请进群,加入社群后务必修改群备注(姓名 - 公司 - 职位;专业群审核较严,敬请谅解)。