大会 | DiracNets:无需跳层连接的ResNet

AI 科技评论按:本文作者 David 9,首发于作者的个人博客,AI 科技评论获其授权转载。

虚拟化技术牺牲硬件开销和性能,换来软件功能的灵活性;深度模型也类似,如果把网络结构参数化,得到的模型更灵活易控,但是计算效率并不高。 — David 9

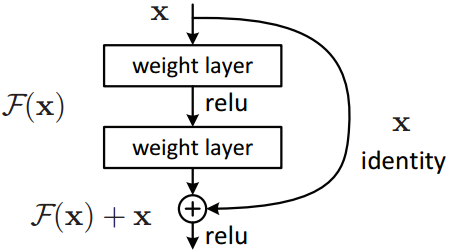

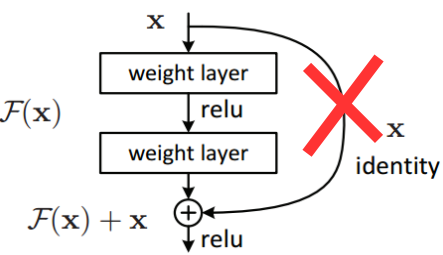

近年来深度网络结构的创新层出不穷:残差网络,Inception 系列, Unet 等等...微软的残差网络 ResNet 就是经典的跳层连接(skip-connection):

来自:https://arxiv.org/pdf/1512.03385.pdf

上一层的特征图 x 直接与卷积后的 F(x)对齐加和,变为 F(x)+x (特征图数量不够可用 0 特征补齐,特征图大小不一可用带步长卷积做下采样)。这样在每层特征图中添加上一层的特征信息,可使网络更深,加快反馈与收敛。

但是 ResNet 也有明显的缺陷:我们无法证明把每一层特征图硬连接到下一层都是有用的;另外实验证明把 ResNet 变「深」,不如把 ResNet 变「宽」, 即,到了一定深度,加深网络已经无法使 ResNet 准确度提升了(还不如把网络层像 Inception 那样变宽)。

于是,DiracNets 试图去掉固定的跳层连接,试图用参数化的方法代替跳层连接:

有一点是确定的,我们知道 F(x)+x 的对齐求和操作是线性的,卷积操作 F 也是线性的,所以,理论上 F(x)+x 可以合并成一个卷积操作(或者一个线性变换):

其中 x 即输入特征图。其中

就是合并后的卷积核窗口参数矩阵(这个参数已经蕴含了卷积操作和跳层操作)。

其中

代表卷积操作。

最后,让我们再把上式的参数拆分开来:

其中 W 即代表 ResNet 中的卷积操作的参数,I 即代表 ResNet 中的跳层操作的参数。

有没有觉得 I 和单位矩阵很像? 你猜对了 ! I 就是由卷积窗口导出的单位参数矩阵,也叫 Dirac delta 变换,任何输入 x 经过这个 I 矩阵 的变换,其输出还是 x 本身。

而 diag (a) 也是一个可训练的向量参数,用来控制需要跳层连接的程度(需要单位矩阵的程度)。

现在我们看看这种参数化的 ResNet 是不是更灵活了?

如果 diag(a)向量都是趋近于 0 的,那么 I 单位矩阵就基本起不到作用, 那么跳层连接就被削弱了。这时原始的卷积操作 W 就认为占主导作用。

如果 diag(a)向量都是趋近于 1 的,并且 W 参数都非常小,那么卷积操作就被削弱了,输出和输入的特征图 x 很相似。

通过训练 diag(a),我们可以控制 ResNet 中的跳层操作和卷积操作两者的权重。而不是像传统 ResNet,不得不硬连接加上一个跳层连接(无论有用或没用)。

代码实现上,PyTorch 提供了许多灵活的方法,torch.nn.functional 接口允许你人工指定各个参数矩阵:

import torch.nn.functional as F

def dirac_conv2d(input, W, alpha, beta)

return F.conv2d(input, alpha * dirac(W) + beta * normalize(W))

上面代码把参数矩阵对于之前说的拆分成两部分:

-

alpha * dirac(W) + beta * normalize(W)

幸运的是pytorch提供现成的计算dirac单位矩阵的函数(http://pytorch.org/docs/0.1.12/nn.html#torch.nn.init.dirac):

-

torch.nn.init.dirac(tensor)

如需深入研究,别错过源代码:

https://github.com/szagoruyko/diracnets

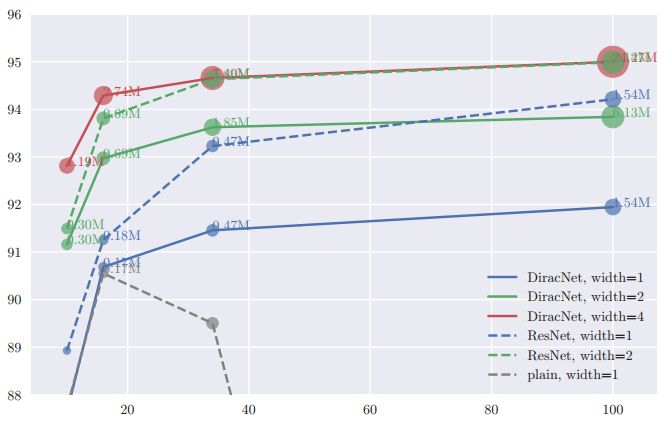

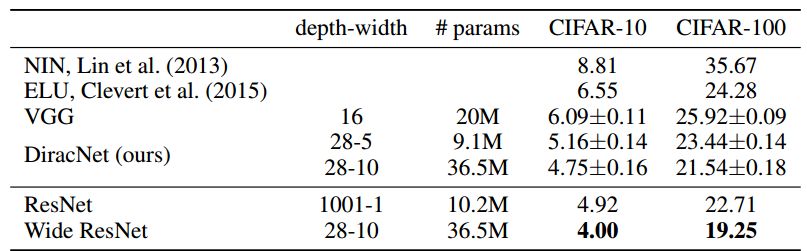

最后我们看看实验结果.

在同等深度的情况下,DiracNets 普遍需要更多的参数才能达到和 ResNet 相当的准确率:

来自:https://arxiv.org/pdf/1706.00388.pdf

来自:https://arxiv.org/pdf/1706.00388.pdf

而如果不考虑参数数量,DiracNets 需要较少的深度,就能达到 ResNet 需要很深的深度才能达到的准确率:

来自:https://arxiv.org/pdf/1706.00388.pdf

参考文献:

DiracNets: Training Very Deep Neural Networks Without Skip-Connections

https://github.com/szagoruyko/diracnets

Deep Residual Learning for Image Recognition

https://zh.wikipedia.org/wiki/%E7%8B%84%E6%8B%89%E5%85%8B%CE%B4%E5%87%BD%E6%95%B0

http://pytorch.org/docs/0.1.12/_modules/torch/nn/functional.html

残差网络:

https://arxiv.org/abs/1512.03385

Unet:

https://github.com/zhixuhao/unet

ResNet:

https://arxiv.org/abs/1512.03385

DiracNets:

https://arxiv.org/abs/1706.00388

本文采用署名 – 非商业性使用 – 禁止演绎 3.0 中国大陆许可协议进行许可。著作权属于「David 9的博客」原创,如需转载,请联系微信: david9ml,或邮箱:yanchao727@gmail.com

————— AI 科技评论招人了 —————

————— 给爱学习的你的福利 —————

三大模块,五大应用,手把手快速入门NLP

海外博士讲师,丰富项目经验

算法+实践,搭配典型行业应用

随到随学,专业社群,讲师在线答疑

点击阅读原文或扫码了解详情

▼▼▼

————————————————————