【泡泡图灵智库】黑暗图像的可视化(CVPR-36)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Learning to See in the Dark

作者:Chen Chen,Qifeng Chen,Jia Xu,Vladlen Koltun

来源:CVPR 2018

播音员:王肃

编译:皮燕燕

审核:杨小育

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——黑暗图像的可视化,该文章发表于CVPR 2018。

低光子数和低信噪比(SNR)使得低照度下的成像具有挑战性。在低照度条件下,短时间的曝光使得图像的噪声大,而长时间的曝光将会导致图像模糊,而且长时间的曝光往往是不切实际的。现有的各种技术如去噪、去模糊和增强技术等的有效性在极限条件下受到限制,如夜间视频速率成像条件。为此文章基于原始短曝光低照度图像的数据集以及相应的长曝光参考图像,开发了基于学习的低照度图像处理流程。基于上述数据集,文章开发的算法流程基于全卷积的端对端训练网络,可被用于处理低照度图像。算法所采用的训练网络直接处理原始的传感器数据,取代了很多传统的图像处理中对原始数据处理不好得流程。文章给出了采用所提出的算法处理新数据集得到的令人满意的结果,分析了影响处理结果的因素,并给出了未来工作的一些方向。

主要贡献

1. 提出了一种新的图像处理流程,通过数据驱动的方法解决极低照度摄影的挑战。

2.创建了一个低光照条件下快速曝光拍摄的原始图像的新数据集。数据集中每个低照度图像都有对应的长曝光高质量参考图像。

算法流程

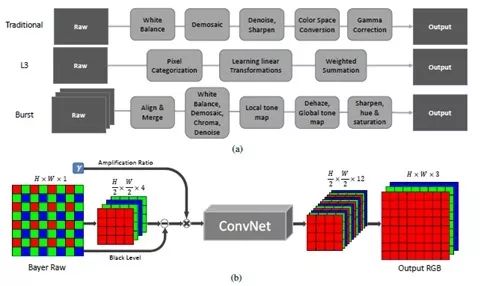

图1 不同图像处理流程的框图

(a)从上至下分别是:传统图像处理流程,L3流程以及多帧图像处理流程(b)文章的流程

第一步:将原始的Bayer阵列,作为输入打包到四个通道中,然后将高度和宽度两个维度的分辨率减少两倍。

第二步:获得X-trans阵列(未在图中给出)。方法:将原始数据储存在6×6的数据块中,通过交换相邻元素将上述数据打包成9个通道而不是36个通道。然后将数据减去黑电平后按照所需的比例(例如,x100,x300)缩放数据。

第三步:打包和放大的数据作为全卷积网络的输入进行处理。

第四步:经过全卷积网络处理得到具有一半空间分辨率的12通道图像。

第五步:采用亚像素层处理第四步得到的半尺寸图以恢复原始的分辨率。

主要结果

文章结果:

1. 定性对比结果。

1.1 与传统的流程进行对比,基于传统流程处理获得的图片噪声大,而且颜色失真。

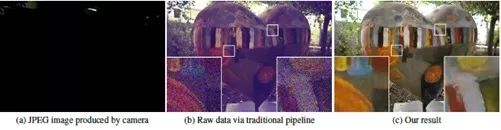

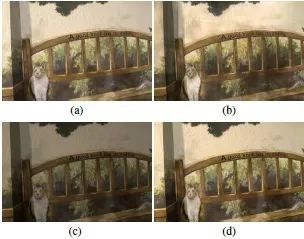

图2 (a) 富士X-T2相机在夜间拍摄的ISO 800,光圈f / 7.1和曝光1/30秒的图像。相机的照度约为1lux(b)基于传统流程处理的结果,不能有效处理噪声和数据中的颜色失真。(c)文章处理的结果

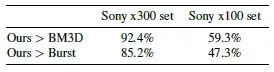

1.2 与事后去噪和多帧处理进行对比。事后去噪无法解决盲噪声抑制以及传统流程处理结果中其它的不好的结果例如图像失真的问题如图3所示。同时经过10名MTurk的工作人员1180次的盲评结果可知文章处理所得到的图片的效果优于BM3D以及多帧处理方式,见图4。

图3 Sony x300获得的低照度图片。

(a)由传统流程处理以及线性缩放的结果。

(b)(a)基础上进行BM3D去噪。 (c)文章的结果

图4 参评人员得到的感知结果。文章的方法

在处理具有挑战性的sony x300图片时得分高于基于BM3D和多帧处理的结果。在处理较为简单的sony x100图片时得分与基于BM3D和多帧处理的结果旗鼓相当

1.3 对智能手机拍摄图像处理结果进行定性对比。传统处理低照度图片具有严重的噪声和色移。文章采用的网络通过训练来自不同相机的图像获得,具有良好的对比度,低噪音和色彩保真。

图5 带有ISO 400,光圈f / 2.2 的iPhone 6s在夜间拍摄的曝光时间为0.05s的原始图像,(a) 基于传统流程处理以及匹配参考图像亮度处理后得到的结果(b)文章的结果

2. 定量分析结果。

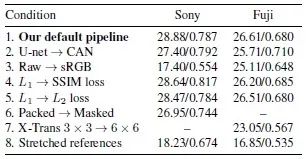

将算法流程中组成部分对处理结果的影响进行了定量评价,评价基于峰值信噪比(PSNR)和结构相似性(SSIM)两个参数。结果如图6所示。

图6 定量试验结果,表中的数值代表PSNR/SSIM的均值

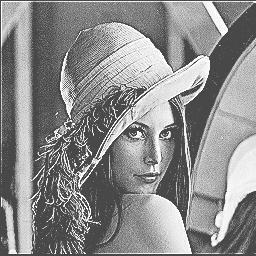

2.1 将文章使用的网络结构U-net替换为CAN,可以看到U-net的PSNR高于CAN。尽管CAN的SSIM高于U-net,但是处理得到的图片颜色失真,如图7所示。

图7 不同网络结构对Fuji x300测试集中图片的处理结果(a) 基于CAN结构的处理结果,颜色失真(b)基于U-net结构的处理结果。为了看到细节图片经过方法处理

2.2 将输入由原始数据替换为sRGB输入,发现文章的处理流程对原始数据处理得到的结果优于对sRGB处理的结果。

2.3 将损耗函数L1替换为L2或SSIM,输出效果影响不大。

2.4 对bayer 数据(sony数据集)进行分割所得到的PSNR/SSIM 低于对bayer data进行打包的结果。

2.5 3x3模式的X-Trans数据相较6x6模式bayer 数据得到的PSNR/SSIM更高。

2.6 当直方图拉伸被应用于参考图像(并且网络必须学习直方图拉伸)时,网络的精度显著下降。实验表明,文章提出的流程不容易学会在整个图像上建模和操作全局直方图统计,并且在面对这个任务时容易过度拟合训练数据。因此,排除在流程中进行直方图拉伸操作,但可选择应用它作为后处理。图8给出了一个典型的结果。

图8 直方图拉伸的影响。

(a) Sony x100数据集中由直方图拉伸得到的参考图像(b)在直方图拉伸的图像上进行训练得到的结果,图像中的墙上有伪影(c)在未进行直方图拉伸的图像上进行训练,尽管得到的图像比较暗但是很干净(d)在(c)上进行直方图拉伸做后处理

Abstract

Imaging in low light is challenging due to low photon count and low SNR. Short-exposure images suffer from noise, while long exposure can induce blur and is often impractical. A variety of denoising, deblurring, and enhancement techniques have been proposed, but their effectiveness is limited in extreme conditions, such as video-rate imaging at night. To support the development of learningbased

pipelines for low-light image processing, we introduce a dataset of raw short-exposure low-light images, with corresponding long-exposure reference images. Using the presented dataset, we develop a pipeline for processing low-light images, based on end-to-end training of a fullyconvolutional network. The network operates directly on raw sensor data and replaces much of the traditional image processing pipeline, which tends to perform poorly on such data. We report promising results on the new dataset,

analyze factors that affect performance, and highlight opportunities for future work.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com