为了对图结构数据建模,图学习,特别是利用图神经网络的深度图学习,最近引起了学术界和工业界的广泛关注。目前流行的图学习方法通常依赖于从“大”数据中学习,需要大量标注数据进行模型训练。然而,通常图与“小”标记数据关联,作为数据注释,在图上标记总是耗时和消耗资源。因此,在有限甚至没有标记数据的低资源环境下,研究人力监督下的图学习是非常必要的。在本教程中,我们将专注于图最小监督学习的最先进的技术,特别是一系列弱监督学习、少样本学习和自监督学习方法的图结构数据及其现实应用。本教程的目标是: (1) 对图最小监督学习中的问题进行正式的分类,并讨论不同学习场景下的挑战; (2) 全面回顾了图最小监督学习的现有和最新进展; (3) 阐明有待解决的问题和未来的研究方向。本教程介绍了最小监督学习中的主要主题,并为图学习的新前沿提供了指南。我们相信本教程对研究人员和实践者是有益的,允许他们在图学习上合作。

https://sites.google.com/asu.edu/kdd2022-tutorial-gmsl

本教程主要关注图结构数据的最小监督学习(即弱监督学习、少样本学习和自监督学习)的问题和技术。我们希望观众有机器学习、图挖掘和图神经网络的一般背景知识。目标受众是对该主题不熟悉或感兴趣的学生、研究人员和从业人员。本教程将以研究生水平的讲座形式进行。具备深度学习、图挖掘和机器学习的基础知识优先考虑,但不是必需的。我们将通过网站和社交媒体发布我们的教程信息。

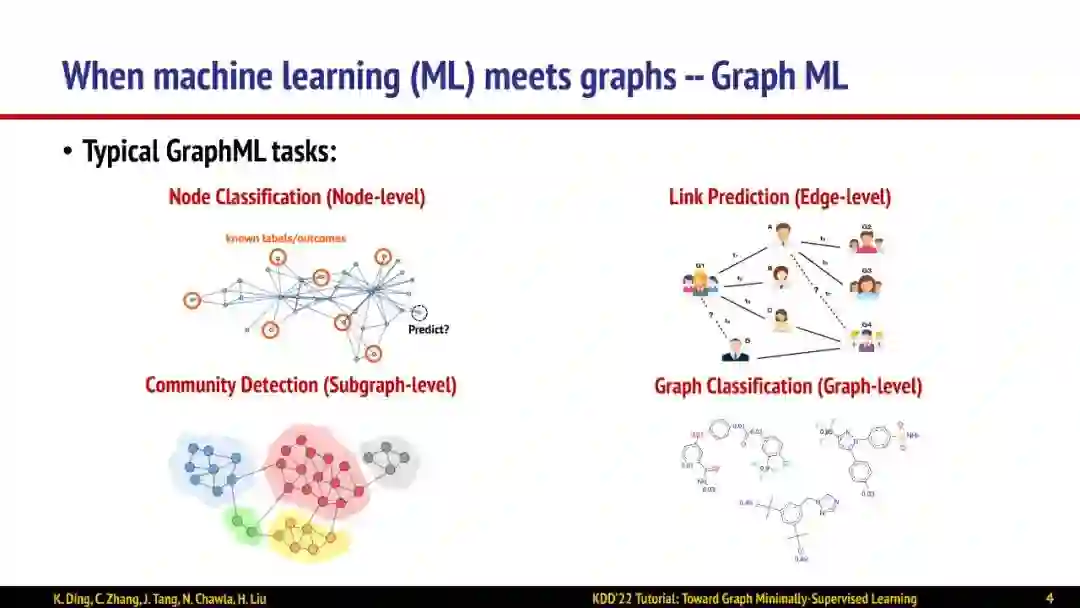

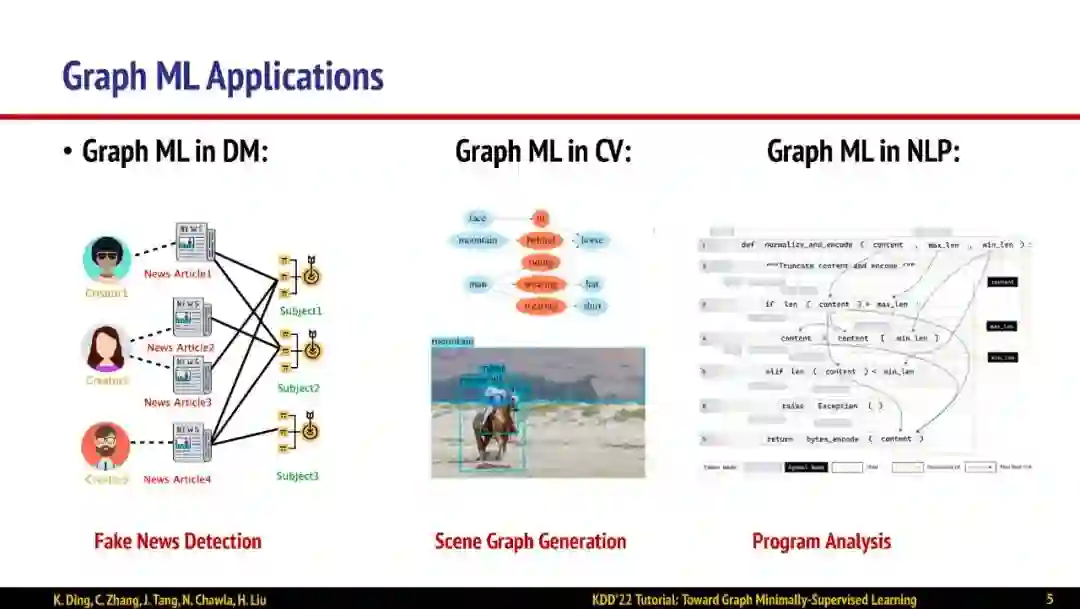

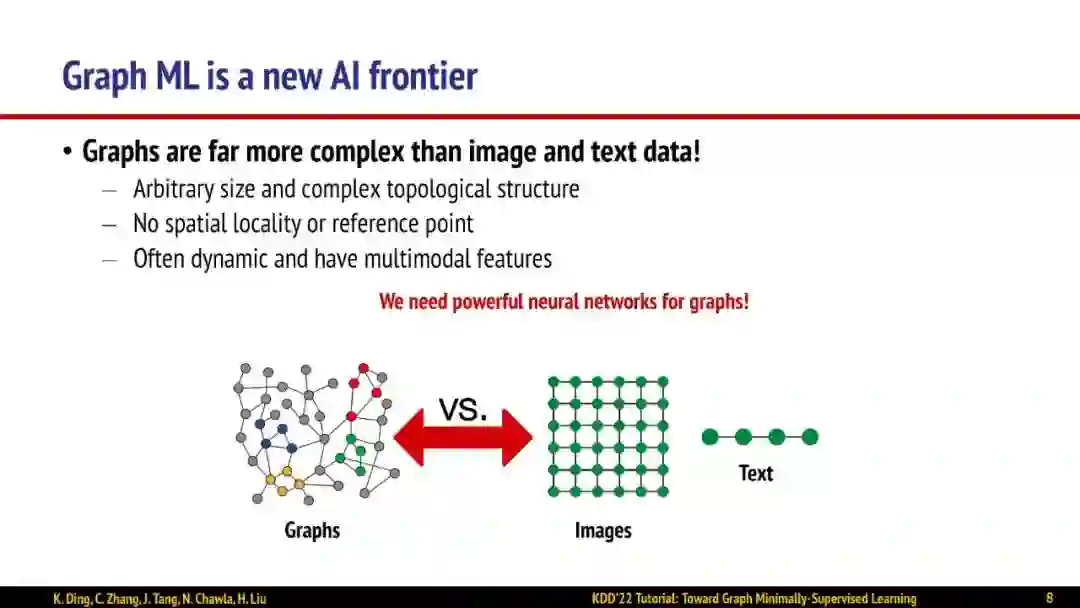

近年来,我们从网络世界的众多平台和物理世界的各种传感器中生成和收集数据的能力迅速增长。图作为一种公共语言,用于建模大量的结构化和关系系统,如社会网络、知识图谱和学术图,其中实体被表示为节点,而它们的关系被表示为边。最近,图学习算法,尤其是基于图神经网络(GNNs)的算法[27,30]由于其在解决现实问题方面的重大影响而受到了广泛的研究关注。为了利用数据之间的固有结构,图学习在方法论上取得了重大进展,在不同领域的应用中产生了有前途的结果,从网络安全[38]到自然语言处理[9]。

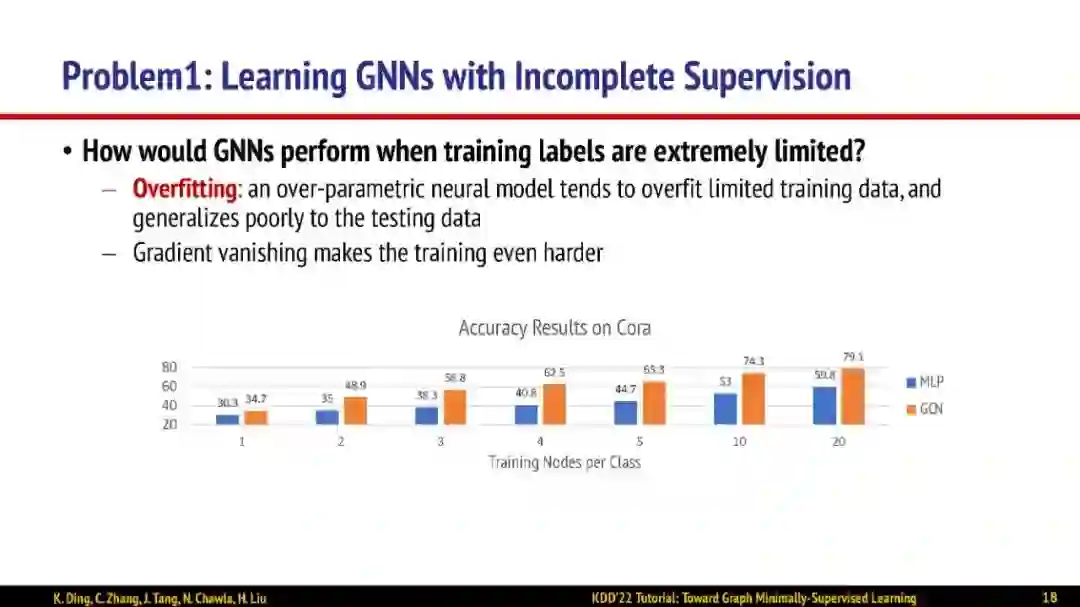

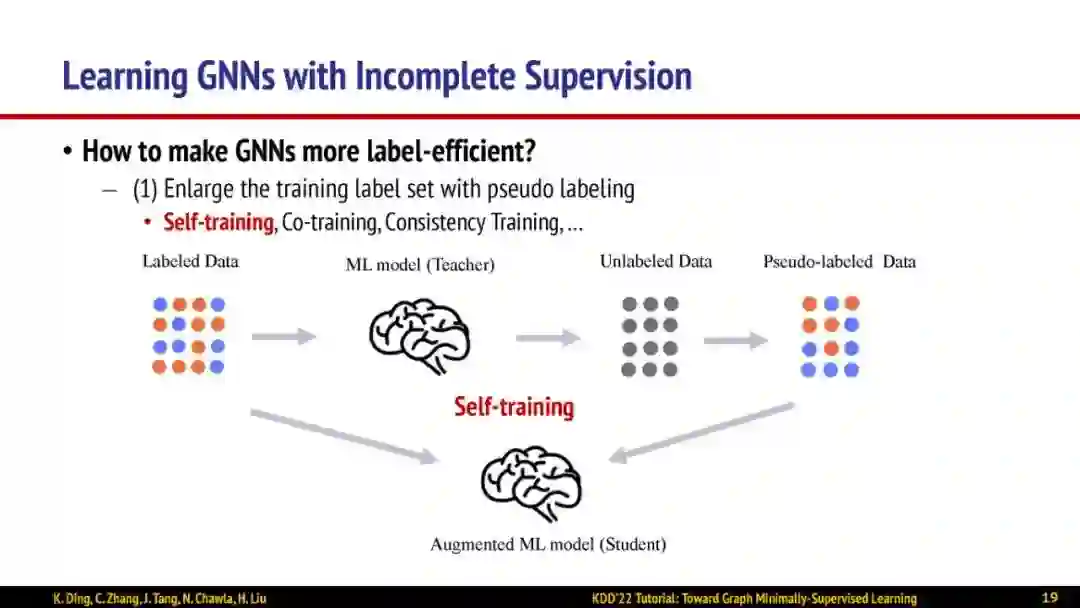

一般来说,现有的图学习算法都专注于在训练过程中能够访问到大量的人类注释示例的设置。这种假设往往是不可行的,因为收集这些辅助知识是费力的,需要密集的领域知识,特别是考虑到图结构数据的异构性[10,31]。因此,在有限或没有标记训练数据的不同低资源设置下研究图学习是具有挑战性的,但也是势在必行的。其中,图最小监督学习领域的三个基本问题引起了越来越多的研究关注: (1)图弱监督学习(graph weaksupervised learning),即利用不完整、间接或不准确的监督信号来学习针对特定下游任务的有效GNN;(2)图少样本学习(Graph few -shot Learning),它的目标是在只有少数标签实例可用的情况下处理不可见的任务(从新的标签空间);(3)图自监督学习(Graph Self-supervised Learning),旨在训练任务无关的GNN或增强GNN在特定的下游任务上的能力,而不需要任何语义注释。为了解决上述每个基本问题,最近研究人员将不同的机器学习技术应用于图域,如数据增强[37]、元学习学习[29]和对比学习[21]。因此,我们组织本教程来回顾和讨论图最小监督学习的最新进展,并讨论如何利用它们来解决现实世界的问题。

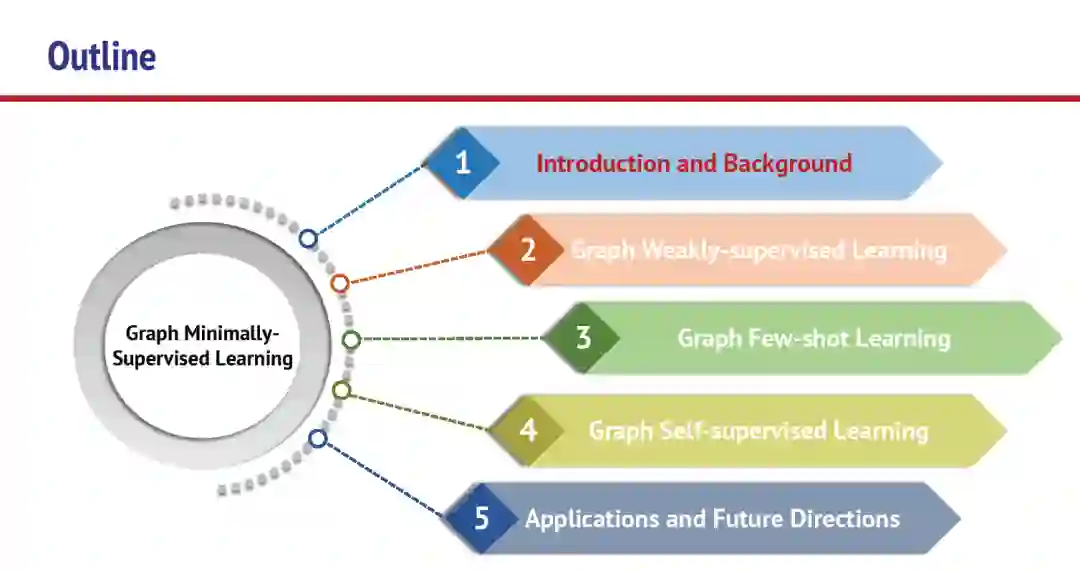

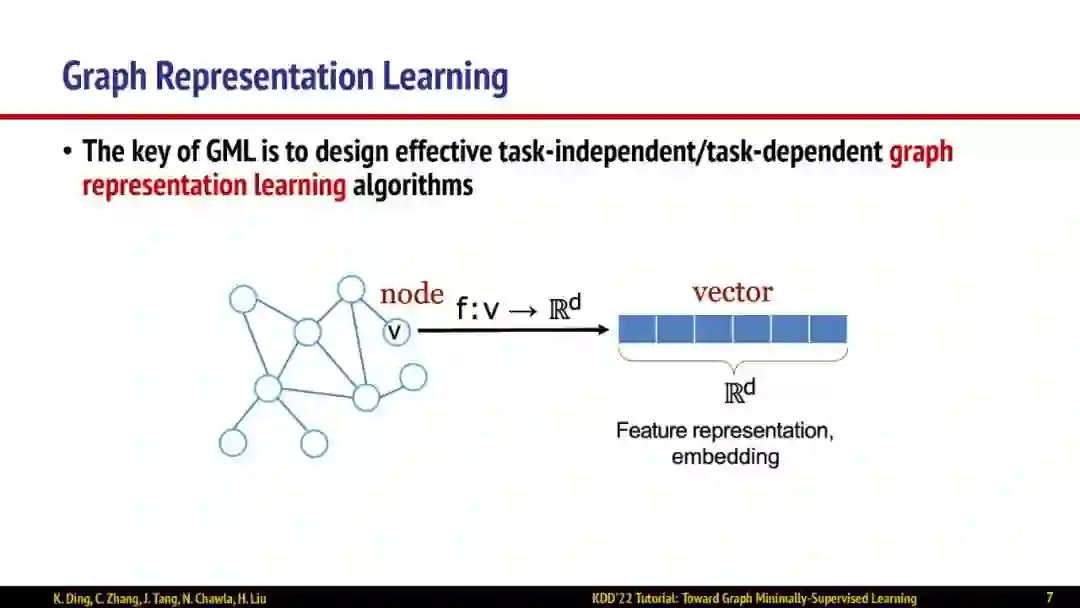

在本教程中,我们的目标是提供一个全面的审查这个新兴的和重要的研究主题: 图最小监督学习。我们将首先介绍图学习的理论基础,特别关注图神经网络。然后我们讨论了图最小监督学习的三个基本问题以及近年来的关键文献。结合不同粒度级别上的主要图挖掘任务(例如,节点分类、链接预测和图分类),我们在每个类别中介绍了用于节点级、边缘级和图级任务的技术。最后,我们将介绍图最小监督学习在不同领域的应用,并讨论该研究领域的未来发展方向。在图学习社区中,我们认为图最小监督学习是一个具有重要社会影响的前沿研究课题,将吸引学术界和业界的研究人员和从业者。

**目录 **

-

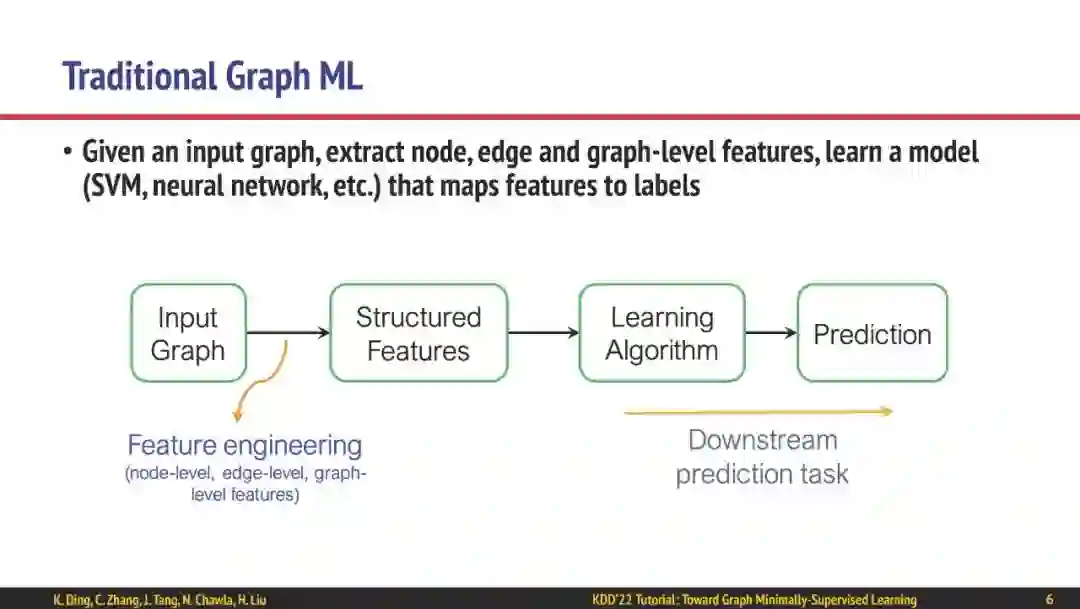

介绍和概述。首先,我们将简要介绍深度图学习及其在低资源环境下面临的挑战,然后我们将涉及图神经网络[30]、元学习[13]、对比学习[2]等相关主题的一些基础知识,并介绍图最小监督学习的概述。

-

图弱监督学习。我们将介绍带有弱监督的图学习方法和应用。重点抓好监督不到位、间接监督和不准确监督三种薄弱监督。本部分将回顾图自训练[8,18]、图主动学习[5,6,14]和图迁移学习[7,11,31]等一系列学习技术。

-

我们将介绍图少样本学习的方法和应用。具体来说,我们将介绍两类方法:基于元梯度的方法[22,28,35,36]和基于度量学习的方法[10-12,16,31,34],以展示如何处理从未见过的节点、边和图。此外,我们还将讨论图零样本学习[19,20,24]。

-

图自监督学习。我们将介绍图自监督学习的方法和应用。具体来说,我们将涵盖三种主要的范式,包括图生成建模[3,4,17,23]、图属性预测[15,26]和图对比学习[1,25,32,33]。

-

结论和讨论。我们将总结所涵盖的主题并讨论它们之间的联系。并讨论了本课题未来的研究方向。

讲者: