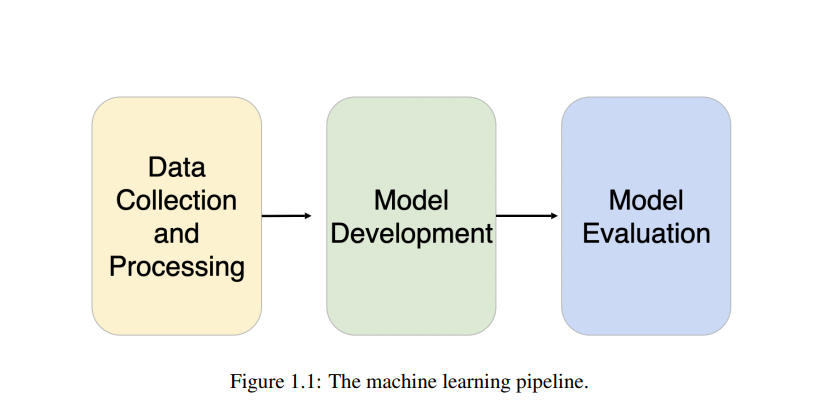

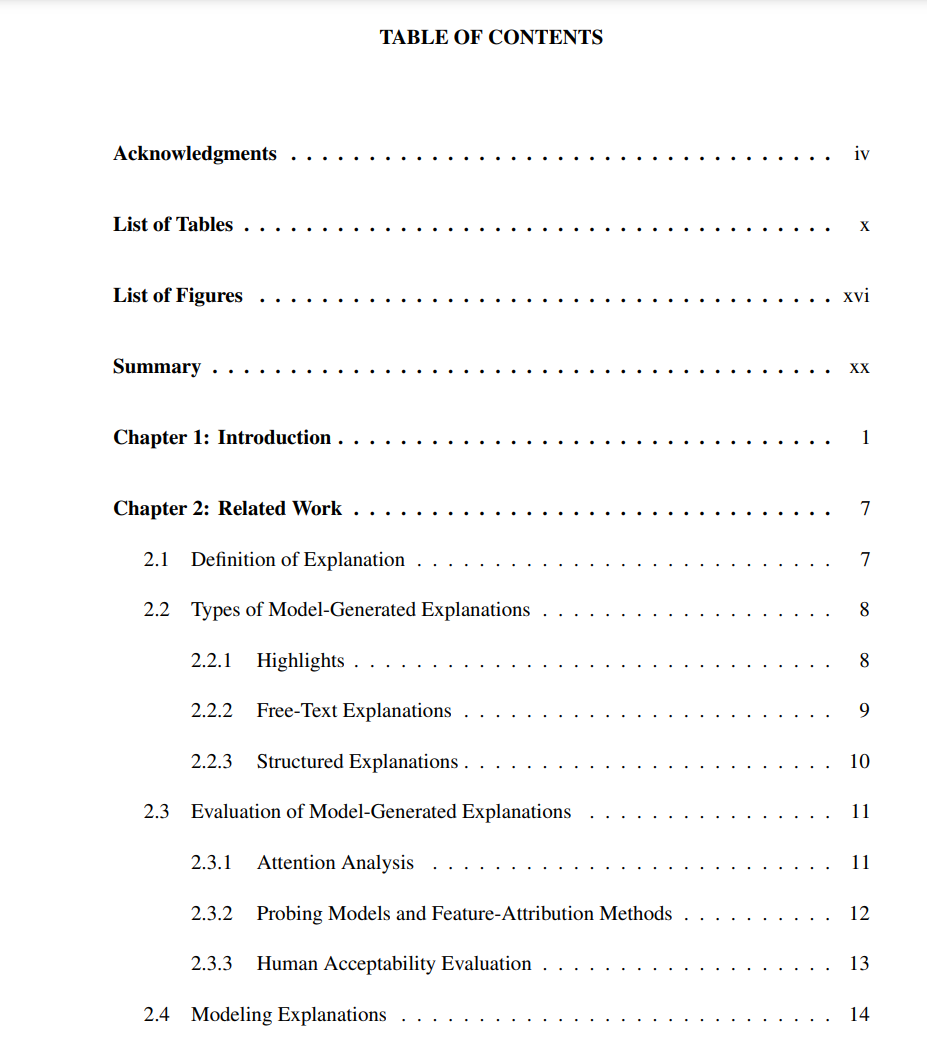

在过去的十年中,自然语言处理(NLP)系统几乎完全建立在大型神经模型的基础上。由于这些模型的能力,可行的任务范围扩大了,应用的空间也扩大了,包括具有现实世界影响的子领域,如事实核查、假新闻检测和医疗决策支持。这些模型的规模和非线性的增加导致了不透明,阻碍了机器学习从业者和外行用户理解其内部原理并从其预测中获得意义或信任的努力。可解释人工智能(XAI)和更具体的可解释NLP (ExNLP)领域通过提供对人类用户有意义的文本解释,已成为纠正这种不透明度并确保模型在高风险场景中的可靠性和可信性的活跃领域。可以检查为其个人预测提供理由的模型,以调试、量化偏差和公平性、理解模型行为以及确定鲁棒性和隐私(Molnar 2019)。无论任务模式如何,文本解释是机器学习数据集中的主要解释形式。因此,本文涵盖了自然语言任务解释和自然语言任务解释两个方面。本文提出了两种语义定义下的模型解释质量评估测试集:忠实度(faithfulness)和人类可接受性(human acceptability)。我使用这些评估方法来研究两种解释形式和三种模型架构的效用。最后,我提出了两种方法来提高解释质量——一种增加了忠实突出解释的可能性,另一种提高了人类对自由文本解释的可接受性。本文努力增加在实践中部署人工智能系统时积极使用和产生结果的可能性。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2023年5月2日

Arxiv

0+阅读 · 2023年5月2日

Arxiv

0+阅读 · 2023年5月1日

Arxiv

1+阅读 · 2023年4月30日

Arxiv

3+阅读 · 2023年4月30日