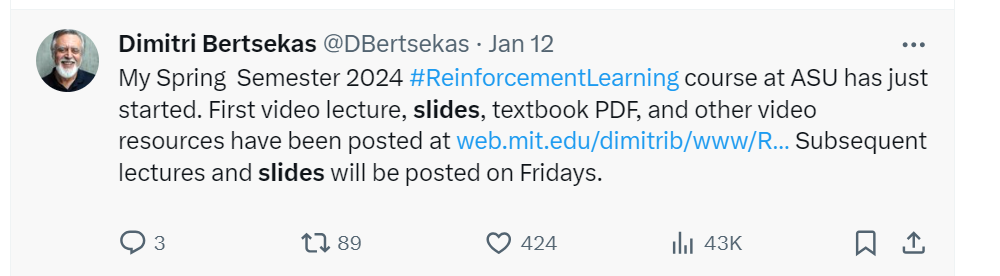

【导读】MIT科学家Dimitri P. Bertsekas在ASU开设了2024《强化学习》课程,讲述了强化学习一系列主题。Dimitri 的专著《强化学习与最优控制》,是一本探讨人工智能与最优控制的共同边界的著作。

本课程将聚焦于强化学习(RL),这是人工智能目前非常活跃的一个分支领域,并将有选择性地讨论一些基于近似动态规划(DP)方法的算法主题: 逼近值和策略空间,近似策略迭代,推出(策略迭代的一种一次性形式),模型预测控制,多智能体方法,挑战组合优化问题的应用,使用模拟和神经网络架构的实现,策略梯度方法,聚合,以及工程和人工智能应用,比如AlphaZero和TD-Gammon程序的高调成功,这两个程序分别会下国际象棋和西洋双陆棋。

我们的主要目标之一是为RL和近似DP提出和开发一个新的概念框架。这个框架围绕着两种算法,它们在很大程度上独立设计,并通过牛顿方法的强大机制协同运行。我们称之为离线训练和在线游戏算法; 这些名字是借用了一些RL的主要成功游戏,如AlphaZero和TD-Gammon。在这些程序的背景下,离线训练算法是用来教程序如何评估位置和在任何给定的位置产生好的移动的方法,而在线比赛算法是用来实时对抗人或计算机对手的方法。我们的主要目标之一是,通过牛顿方法的算法思想和抽象DP的统一原则,表明AlphaZero和TD-Gammon方法的值空间逼近和铺展非常广泛地应用于确定性和随机最优控制问题,包括离散和连续搜索空间,以及有限和无限视界。此外,我们将展示我们的概念框架可以有效地与其他重要的方法集成,如模型预测和自适应控制、多智能体系统和分散控制、离散和贝叶斯优化,以及离散优化的启发式算法。本课程的主要重点是鼓励研究生通过定向阅读和与教师的互动来加强学习。

地址:

http://web.mit.edu/dimitrib/www/RLbook.html