主题: DEPARA: Deep Attribution Graph for Deep Knowledge Transferability

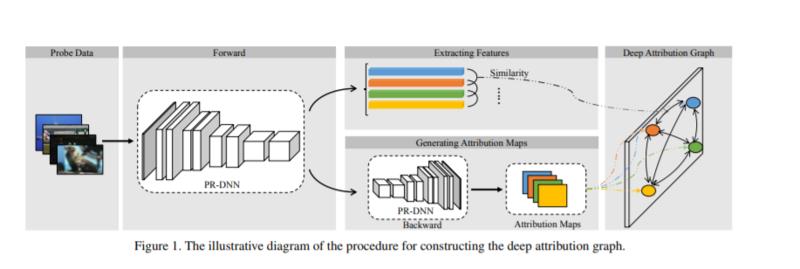

摘要: 探索经过PRe训练的深度神经网络(PR-DNN)编码的异构任务之间的知识之间的内在联系,揭示了它们的相互可移植性,从而使知识能够从一项任务转移到另一项任务,从而减少了后者的培训工作量。在本文中,我们提出了DEeP属性图(DEPARA),以研究从PR-DNN中获得的知识的可传递性。在DEPARA中,节点对应于输入,并由其相对于PR-DNN输出的矢量归因图表示。边缘表示输入之间的相关性,并通过从PR-DNN中提取的特征相似性来衡量。两个PR-DNN的知识可传递性是通过它们对应的DEPARA的相似性来衡量的。我们将DEPARA应用于转移学习中的两个重要但尚未充分研究的问题:预先训练的模型选择和层选择。进行了广泛的实验以证明所提出的方法在解决这两个问题上的有效性和优越性。

成为VIP会员查看完整内容

相关内容

CVPR is the premier annual computer vision event comprising the main conference and several co-located workshops and short courses. With its high quality and low cost, it provides an exceptional value for students, academics and industry researchers.

CVPR 2020 will take place at The Washington State Convention Center in Seattle, WA, from June 16 to June 20, 2020.

http://cvpr2020.thecvf.com/

专知会员服务

66+阅读 · 2020年4月17日

专知会员服务

52+阅读 · 2020年2月8日

专知会员服务

102+阅读 · 2019年11月24日

Arxiv

3+阅读 · 2019年1月20日

Arxiv

7+阅读 · 2018年4月17日