**大型语言模型(LLMs)的评估新范式

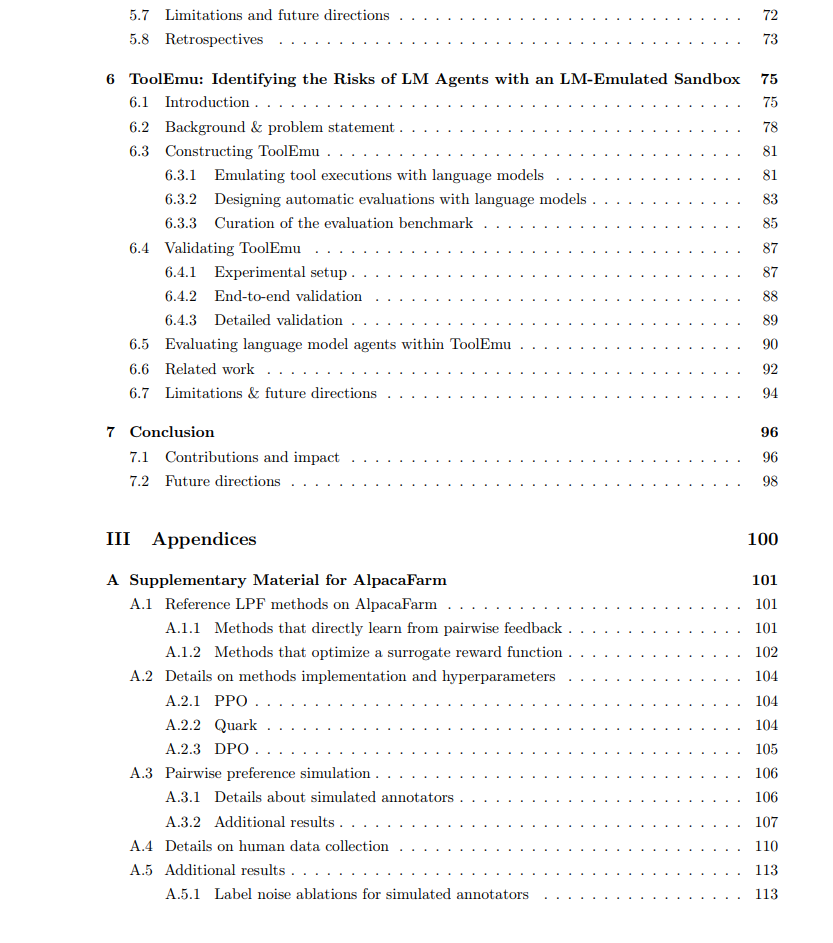

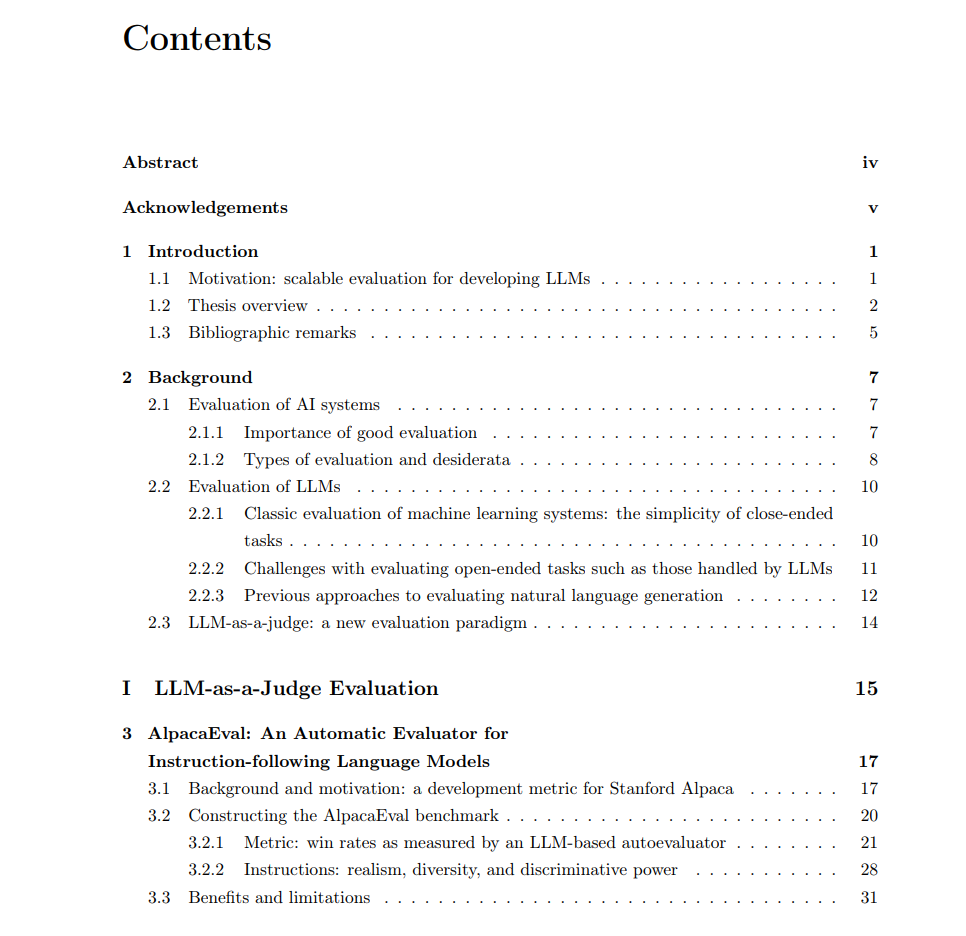

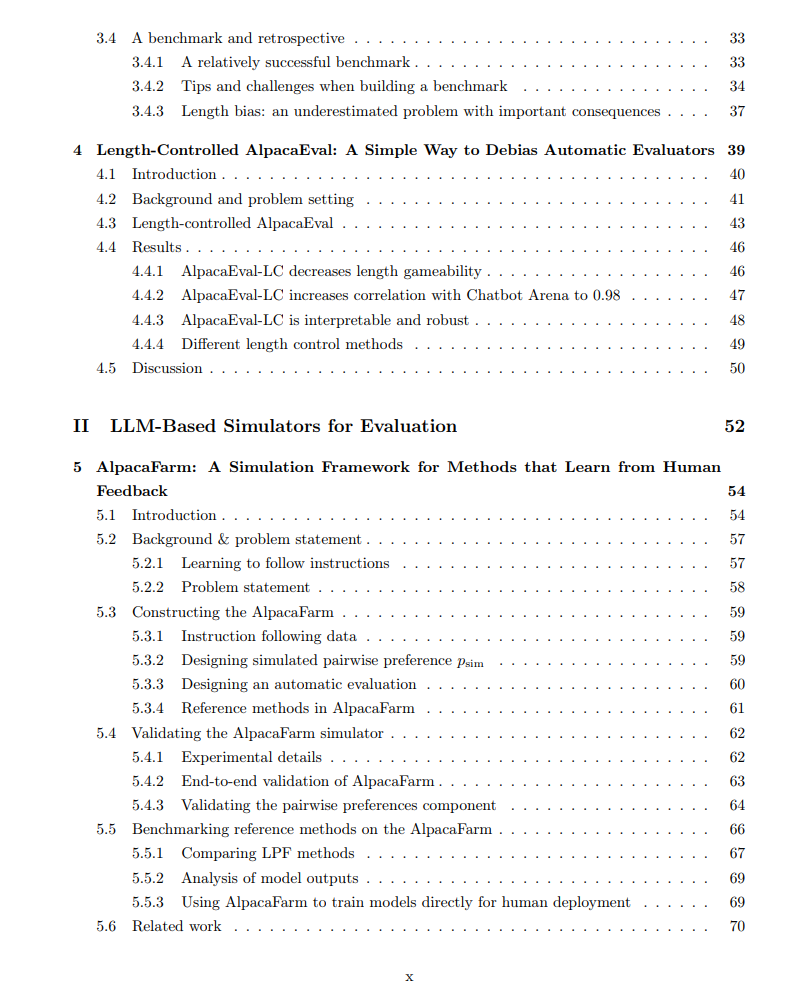

大型语言模型(LLMs)因其多功能性与高效性已无处不在,而其发展的关键环节在于可扩展且有效的任务评估能力。然而,这种多功能性也带来了重大挑战:LLMs需要在开放式任务(如编写故事或构建网站)上进行评估,而此类任务的正确答案无法穷举,使得规模化评估极为困难——传统方法无法依赖标准答案比对。因此,现有方案要么依赖高成本的人工评判,要么采用可扩展的代理任务进行评估,但这些代理任务往往难以反映真实场景中的表现。 本论文提出了一种更可扩展、更可靠的LLM评估方法,其核心思想是利用LLMs自身作为评估者,在规模化与类人评判之间取得平衡。论文前半部分探讨了LLM评判员(LLM-judges)——通过大模型评估其他模型输出的质量。我们提出了AlpacaEval,一种基于预言机级LLM的简易评估流程,通过对比候选模型与基线模型的输出,其评估结果与人类评判高度一致(相关系数ρ=0.94),而成本仅为人工评估的1/20,速度提升50倍。 随后,我们研究了调用外部工具的AI智能体的评估问题。核心挑战在于安全评估工具调用行为——传统方法需依赖沙箱环境,但大多数工具要么缺乏沙箱支持,要么配置耗时。为此,我们提出ToolEmu,通过LLM模拟工具行为,实现安全、可扩展且高保真的智能体评估。 综上,本论文探索了一种基于LLMs的开放式AI系统评估新范式,在保证评估质量的同时显著提升了可扩展性。

成为VIP会员查看完整内容

相关内容

Arxiv

223+阅读 · 2023年4月7日