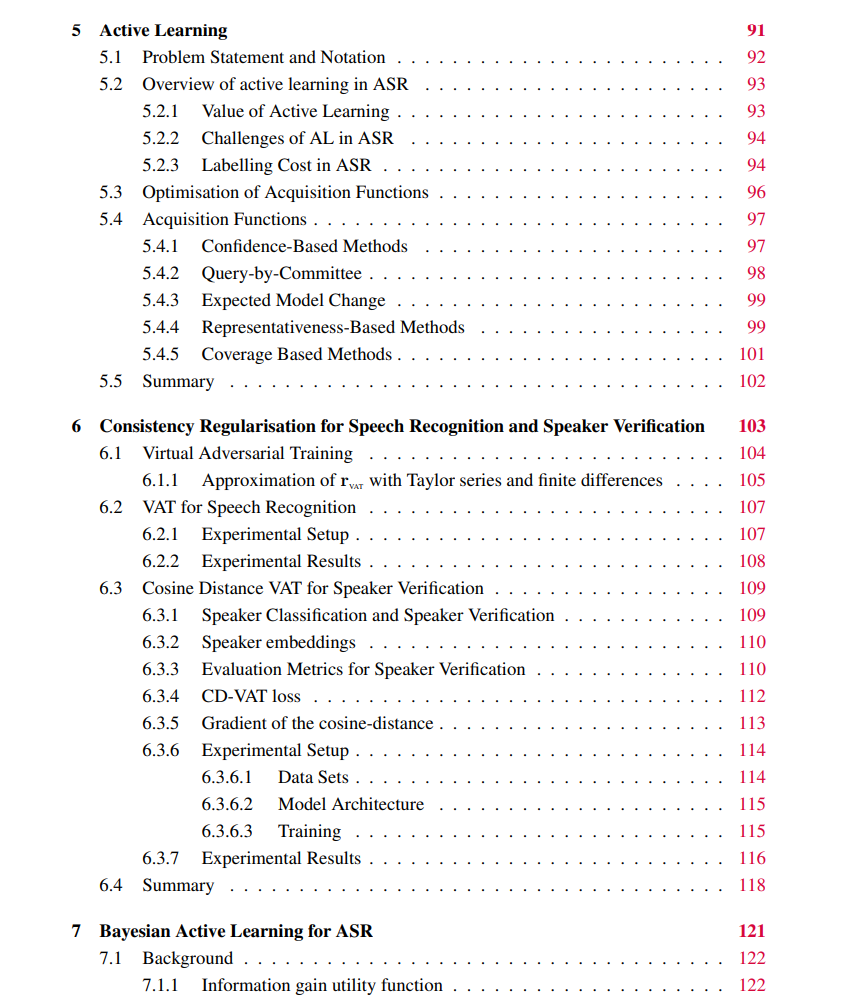

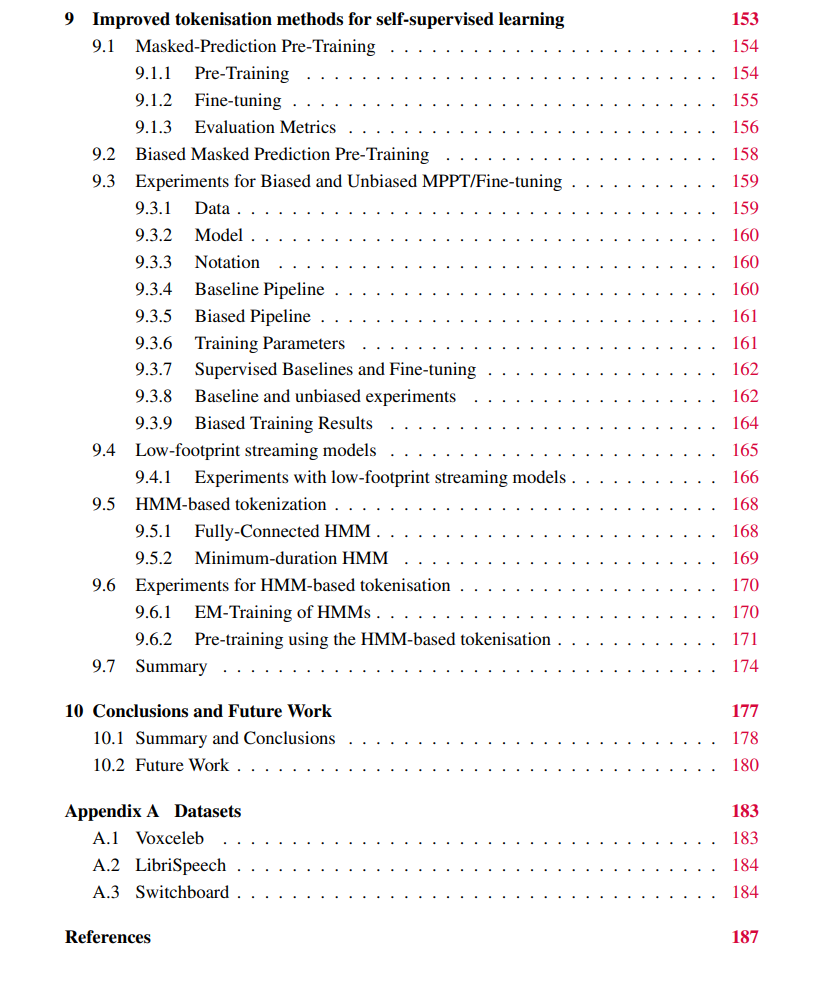

近年来,语音识别技术取得了显著进展,这在很大程度上可以归功于语音识别中深度学习的兴起和计算能力的增强。计算能力的增强使得模型能够在不断扩大的数据集上进行训练,而深度学习则使得这些大型数据集得到了更好的利用。 对于商业产品而言,常见的做法是在数千小时的转录音频上进行训练。然而,音频的手动转录成本高昂,高性能系统的发展通常仅限于商业上可行的任务和语言。为了推广不同语言的语音识别技术并使其更易于获取,至关重要的是要最小化训练所需的转录音频量。本论文通过探索各种方法来减少在训练自动语音识别系统中对转录数据的依赖,这些方法包括新颖的主动学习和半监督学习方法。 对于主动学习,本论文提出了一种基于贝叶斯框架的方法,称为NBest-BALD。NBest-BALD基于贝叶斯主动学习差异(BALD)。NBest-BALD基于模型参数与话语预测之间的互信息来选择话语,即I[θ, w|Dl, Xi]。使用Monte-Carlo Dropout来近似从模型参数的后验中采样,并使用N-Best列表来近似假设空间上的熵。在英语会话电话语音的实验中,NBest-BALD的表现优于随机抽样和以前使用置信度得分或NBest-Entropy作为信息量度的主动学习方法。NBest-BALD在选择更多数据时所获得的绝对词错误率(WER)降低高达14%与随机选择相比。 此外,为语音识别中的主动数据选择开发了一种鼓励代表性的新方法。该方法首先构建一个关于话语长度的直方图。选择话语时,从直方图中抽取一个词长,并选择相应直方图箱中信息量最高的话语。这确保了所选数据集的话语长度分布与总数据集相似。在英语会话电话语音的小批量获取中,该方法显著提高了主动学习的表现。基于直方图的抽样将从选择更多数据中获得的绝对WER降低高达57%与随机选择相比,和高达50%与仅使用信息量的方法相比。 在语音识别中进一步贡献到主动学习的是定义了一个考虑到对话和会议序贯性的成本函数。考察了根据新成本函数应选择数据的粒度。检查了按话语级别选择数据、作为连续话语的固定长度块、作为连续话语的变长块以及按侧面级别选择数据。成本函数结合了话语长度(以秒计)的实时因子(RTF)和每个话语的开销(t1)以及连续话语块的开销(t2)。开销t2最大地影响了话语级别的选择方法(之前的方法依赖于此),并且这一粒度层次产生了最差的语音识别性能。这一结果表明,关注可以考虑更好成本函数的选择方法至关重要。 在半监督学习方面,开发了一种新算法,称为余弦距离虚拟对抗训练(CD-VAT)。虽然CD-VAT不是针对语音识别的,但该技术的灵感来源于最初向语音识别使用一致性正则化的工作。CD-VAT允许对发音区分性声学嵌入进行半监督训练,而不要求标记数据和未标记数据的说话者集合相同。CD-VAT是一种一致性正则化形式,其中监督训练损失与无监督损失进行插值。这种损失是CD-VAT损失,它通过测量带有和不带对抗噪声的嵌入之间的余弦距离来平滑模型的嵌入相对于输入。在一个大规模的说话者验证任务中,CD-VAT恢复了32.5%的等错误率(EER)改进,该改进会在未标记数据的所有说话者标签可用时获得。 对于语音识别的半监督学习,本论文提出了两种改进输入标记化的方法,这种标记化用于派生在遮蔽预测预训练中使用的训练目标;一种自监督学习的形式。第一种方法是有偏自监督学习。这不是对使用无监督训练的模型的嵌入进行聚类,而是对经过少量更新的微调的模型的嵌入进行聚类。微调是在任何半监督学习情景中可用的少量监督数据上进行的。这种微调确保了自监督学习任务专门针对模型应用的任务。在英语朗读语音的实验中,有偏自监督学习将WER降低了高达24%超过无偏基线。第二种方法用隐马尔可夫模型(HMM)替换了之前用于标记化输入的K-均值聚类算法。训练后,使用Viterbi算法执行输入的标记化。该结果是一种标记化算法,它考虑了数据的序贯性并可以在时间上平滑标记化。在同一个英语朗读语音任务上,基于HMM的标记化将WER降低了高达6%与使用K-均值的标记化相比。