Transformer是当下关注的热点方法之一,如何把Transformer用在3D视觉上是个重要的研究方向。来自阿联酋MBZUAI大学的学者发布了《3D视觉Transformers处理》综述论文,提出了一个超过100种Transformer方法的系统和全面的综述,不同的三维视觉任务,包括分类,分割,检测,完成,姿态估计,和其他。

Transformer结构在自然语言处理中的成功引起了计算机视觉领域的关注。由于Transformer 具有学习远程依赖关系的能力,它已被用作广泛使用的卷积算子的替代。这种替代被证明在许多任务中都是成功的,其中一些最先进的方法依赖于Transformer来更好地学习。在计算机视觉领域,3D领域也越来越多地采用Transformer用于三维卷积神经网络和多层感知器网络。虽然很多综述都关注视觉中的Transformer,但与2D视觉相比,3D视觉在数据表示和处理方面存在差异,因此需要特别关注。在这项工作中,我们提出了一个超过100种Transformer方法的系统和全面的综述,不同的三维视觉任务,包括分类,分割,检测,完成,姿态估计,和其他。我们讨论了三维视觉中的Transformer设计,它允许用各种三维表示来处理数据。对于每个应用,我们强调了基于Transformer的方法的关键属性和贡献。为了评估这些方法的竞争力,我们在12个3D基准上将它们的性能与普通的非Transformer方法进行了比较。最后,我们讨论了Transformer在3D视觉中的不同开放方向和挑战。除了已发表的论文,我们的目标是经常更新最新的相关论文及其相应的实现:https://github.com/lahoud/3d-vision-transformers。

计算机视觉的一个基本问题是理解三维空间中的场景和物体。它支持关系的紧凑表示,并提供了在现实世界中导航和操作的能力。3D视觉在各个领域发挥着重要的作用,包括自动驾驶、机器人、遥感、医疗、增强现实、设计行业等许多领域的应用。人们对3D领域的兴趣越来越大,原因有很多: (1)各种3D捕获传感器的发展,如激光雷达和RGB-D传感器; (2) 大量大规模的3D几何数据集的引入,这些数据以3D方式收集和标记;(3)3D深度学习方法的进步。

常见的3D深度学习方法采用深度卷积神经网络(CNNs)和多层感知器(MLPs)。尽管如此,使用注意力机制的基于transformer的架构已经在各种领域显示了这种方法的有效性,如自然语言处理(NLP)和2D图像处理。虽然卷积操作具有有限的接受域和翻译等方差属性,但注意机制是全局操作的,因此可以编码长程依赖,允许基于注意力的方法学习更丰富的特征表示。见证了基于transformer的架构在图像领域的成功,许多3D视觉方法最近都在模型设计中采用了transformer。这些架构已经被提出作为最常见的3D视觉应用的解决方案。在3D技术中,transformer已经取代或补充了之前的学习方法,得益于其捕捉远程信息和学习任务特定的归纳偏差的能力。

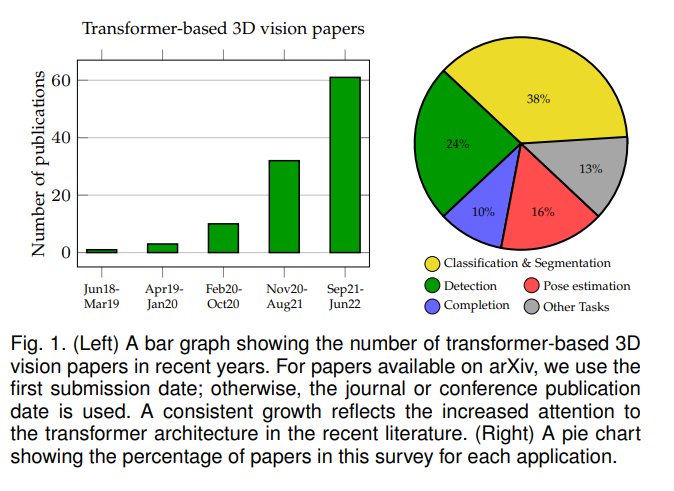

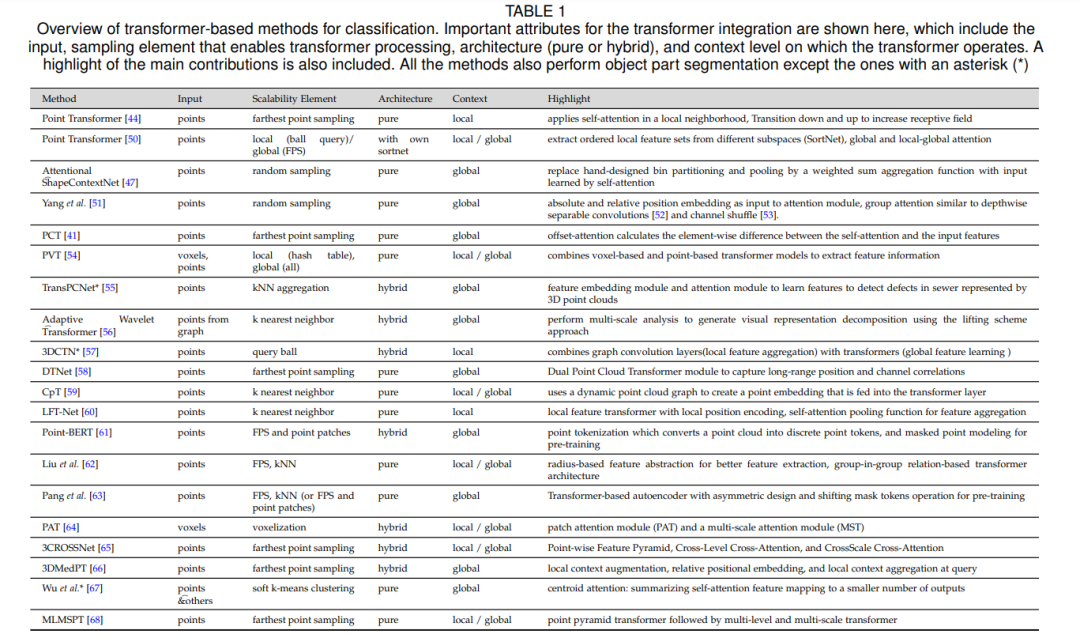

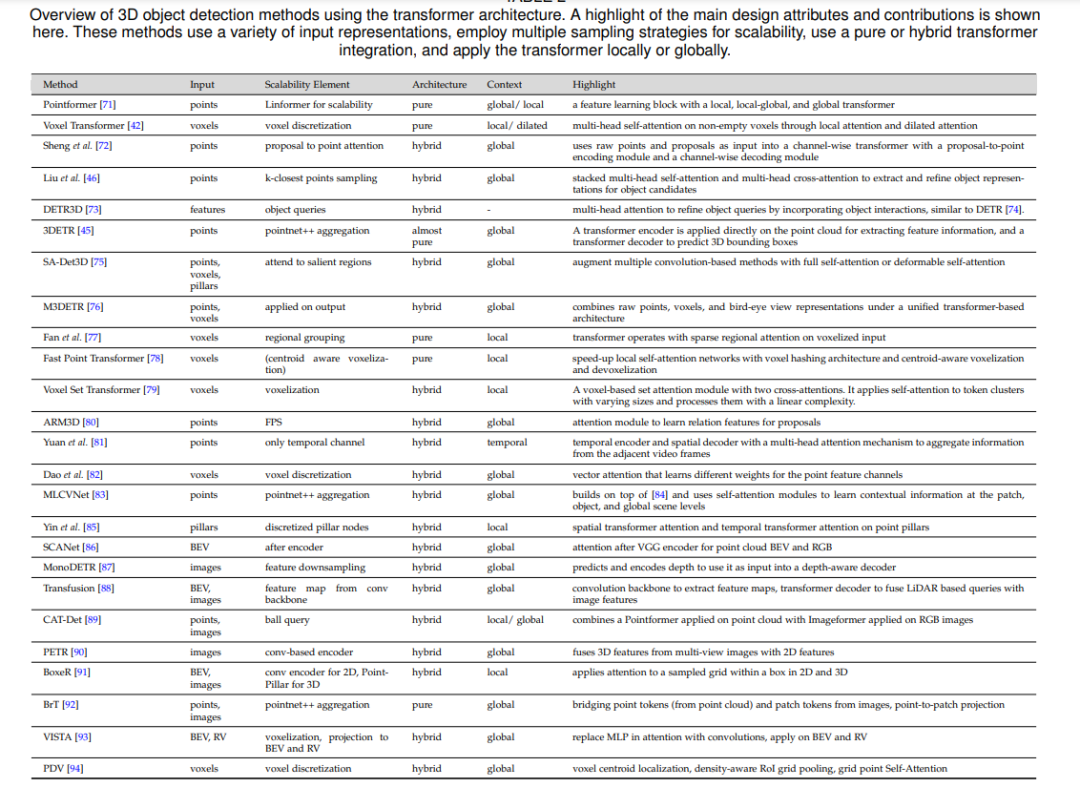

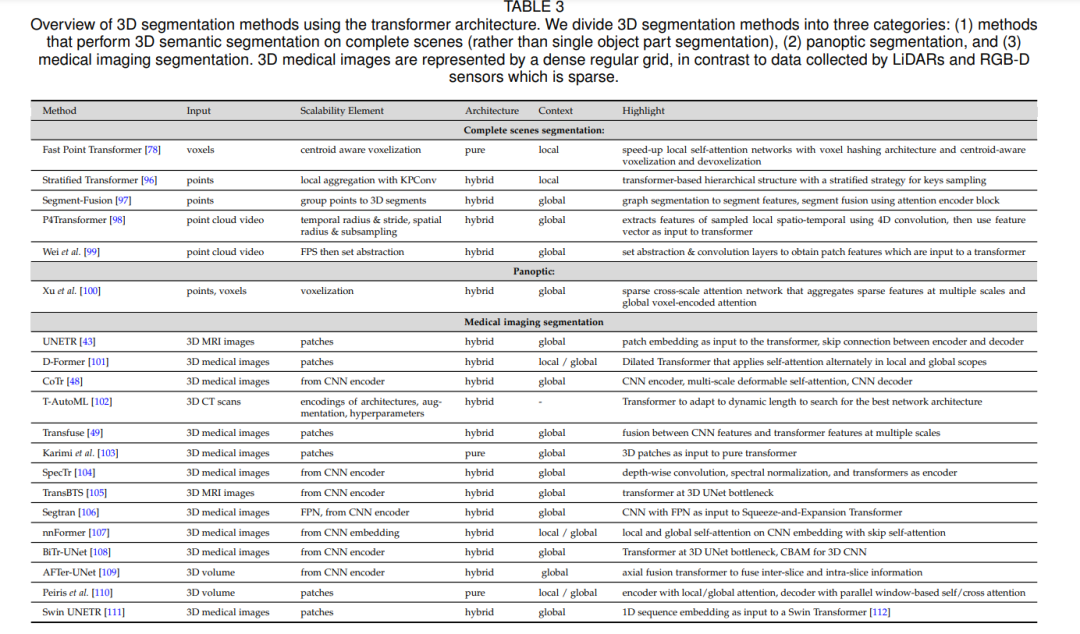

鉴于transformers 对3D视觉的兴趣日益浓厚(图1,左),对现有方法的概述对于全面了解这一新兴领域至关重要。在本次综述中,我们回顾了使用transformers完成3D视觉任务的方法,包括分类、分割、检测、完成、姿态估计等(图1,右)。我们强调了transformers 在3D视觉中的设计选择,这允许它处理各种3D表示的数据。对于每个应用,我们讨论了提出的基于transformers 的方法的关键属性和贡献。最后,我们将它们的性能与广泛使用的3D数据集/基准上的其他方法进行比较,以评估transformers 集成在该领域的竞争力。

我们注意到,许多综述研究了3D视觉中的深度学习方法。在这些综述中,许多已经发表的研究对处理3D数据[1],[2],[3],[4]的方法进行了全面的综述。其他研究集中在特定的3D视觉应用,如分割[5],[6],[7],分类[8],或检测[9],[10]。此外,一些调查从表示的角度[11],[12]来研究3D深度学习方法,还有一些研究将研究限制在特定的数据输入传感器[10],[13]。考虑到大多数综述是在transformer架构最近取得成功之前发布的,对基于transformer的架构的关注仍然缺失。

随着最近大量依赖于注意力机制和transformer 架构的视觉方法的出现,涌现了许多研究这些方法的工作。这些作品中有一些考虑了视觉上的transformer [14]、[15]、[16]、[17]、[18],而另一些则专注于特定方面,如效率[19],或特定应用,如视频[20]或医学成像[21]。考虑到二维和三维数据表示和处理的差异,特别关注应用于三维视觉应用的transformer 是必要的。因此,我们重点研究transformer 结构在三维视觉领域的应用。该综述包括使用具有3D输入和/或输出的transformer架构的方法。3D数据可以通过许多传感器获得,如室内的RGB-D传感器,室外的激光雷达,以及专门的医疗传感器。我们包括使用点云或密集的3D网格作为输入的方法。在医学成像中,通过在不同的切片上拍摄图像也可以得到密集的三维网格。此外,还介绍了将transformer 架构应用于其他输入数据(如多视图图像或鸟瞰图)并生成3D输出的代表性方法。

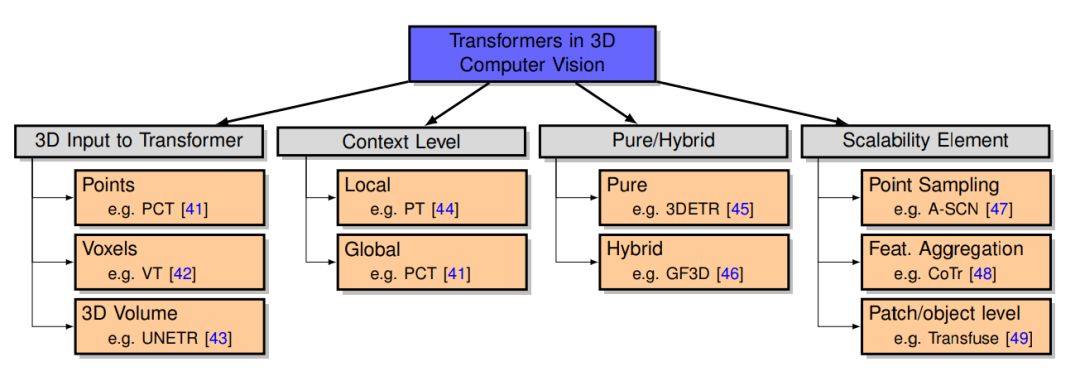

图1 三维计算机视觉中transformer设计的分类。我们将这些方法分成与转换器的输入、上下文级别、其与其他学习方法的组合(纯/混合)以及可扩展性元素相关的底层方法差异。

注意力块捕获远程依赖,这有助于学习上下文在基于卷积的网络中没有充分利用。这些远程依赖关系在场景理解中起着重要的作用,特别是当局部信息模糊时。此外,transformers 可以应用于集合,这是点云的自然表示。与图像表征不同,点云可以以不同的长度出现,与句子中的单词有相似之处。考虑到在NLP中transformers 的成功,人们希望将transformers 集成到3D领域也会遵循类似的趋势。此外,应用于2D的transformers 需要在特征信息中添加位置信息。在3D中,位置可以作为点云中点的坐标。上述transformers 的特性为在3D领域中使用transformers 架构奠定了基础。然而,有许多方法可以将transformers 集成到3D应用管道中。因此,我们将在本节中讨论这种集成的关键特征。我们的讨论基于图5所示的分类。

将transformer集成到3D应用Pipeline中已被证明在许多领域都是有效的。考虑到在多个数据集上具有竞争力的性能,由于其学习远程依赖的能力,该transformer被证明是卷积和多层感知器操作的充分替代。尽管如此,用于3D处理的通用transformer主干仍然缺失。与许多其他方法所依赖的transformer图像处理方法[69]、[112]不同,大多数基于transformer的3D方法使用不同的transformer设计和集成。开发一种通用的转换方法,在局部和全局尺度上处理点云并学习丰富的特征,是一项非常有意义的工作。transformer需要学习精细的形状信息,同时在场景全局范围内运行,以利用场景上下文。