帝国理工等最新《胶囊网络综述》论文,29页pdf阐述胶囊的概念、方法与应用

帝国理工等最新《胶囊网络综述》论文,29页pdf阐述胶囊的概念、方法与应用

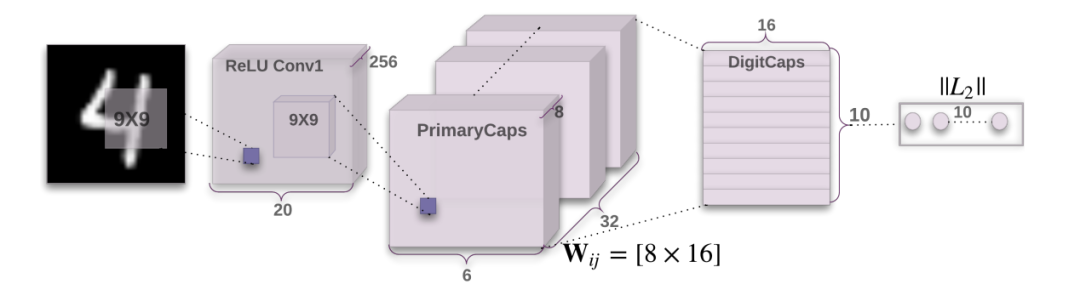

胶囊网络作为卷积神经网络(Convolutional Neural networks, CNNs)的另一种学习以对象为中心表示的方法,可以提高泛化能力和样本复杂度。与cnn不同,胶囊网络使用神经元组对视觉实体进行编码,显式地建模部分-整体层次关系,并学习这些实体之间的关系。胶囊网络早期取得的有前景的成果激励了深度学习社区继续努力提高其在多个应用领域的性能和可扩展性。然而,胶囊网络研究的一个主要障碍是缺乏可靠的参考点来理解它们的基本思想和动机。这项综述的目的是提供一个全面的概述胶囊网络的研究景观,这将为社区的未来提供宝贵的资源。为此,我们首先介绍胶囊网络背后的基本概念和动机,例如计算机视觉中的等变推理。然后,我们将介绍胶囊路由机制的技术进展和胶囊网络的各种公式,如生成和几何。此外,我们还详细解释了胶囊网络与Transformers中流行的注意力机制之间的关系,并强调了它们在表征学习背景下的非微不足道的概念相似性。随后,我们探索了胶囊网络在视频和运动(如视频对象分割、回归跟踪和动作视频识别)、自然语言处理(如文本分类、关系提取、语言和视觉、推荐系统)、医学成像(如病变的语义分割、脑肿瘤分类)、故障诊断(如轴承故障诊断)、高光谱成像和伪造检测等方面的广泛应用。最后,我们对胶囊网络研究的主要障碍进行了深入的讨论,并指出了未来的研究方向。

https://www.zhuanzhi.ai/paper/a11fa908dd65532e8a8aff7974e71255

引言

计算机视觉的核心任务是从图像中提取的特征向量对物体进行分类,并提供更全面的描述,如姿态、形状、外观等。几十年来,构建适合下游任务的数据表示(特征)需要大量的手工工程和专家知识。表示学习[1]由一组工具组成,使机器能够自动发现原始数据的有用表示,然后用于下游的预测任务。近年来最成功的表示学习方法是深度学习(Deep learning, DL)[2]。尽管现代基于深度学习的视觉系统[2]、[3]、[4]取得了许多成功,但普遍缺乏对分布转移的鲁棒性[5]仍然很普遍。事实上,与目前的系统不同,人类能够快速适应分布的变化,只需要很少的例子来学习[6],[7],[8]。有令人信服的证据表明,人类将视觉场景分解为部分-整体层次结构,我们通过对部分和整体之间的视点不变的空间关系建模,如分配给它们的内在坐标系[9],[10],[11]之间的坐标变换。让神经网络(NN)更加透明和可解释的一种方法是,尝试让它们像人类一样理解图像。然而,这对于标准神经网络来说是困难的,因为它们不能动态地表示每个图像[12]的不同的部分-整体层次树结构。这种无能是一系列模型的动机被称为胶囊网络[12],[13],[14],[15],[16]。胶囊网络是一种NN,它比卷积神经网络(Convolutional Neural Networks, CNNs)更明确地建模部分-整体层次关系,通过使用神经元组来编码实体,并学习这些实体之间的关系[17]。和机器学习[18],[19]的其他发展一样,胶囊网络也是受到生物启发的,他们的目标是能够学习更健壮的、以对象为中心的、具有姿态感知和可解释性的表示。来自神经科学的证据表明,紧密连接的附近神经元群(即超列)可以表示一个向量值单位,它不仅能够传递标量,而且能够传递一组协调值[8]。向量值单位的概念是胶囊网络和软注意机制[8],[20],[21]的核心,包括transformer [22]。如后面所示,在胶囊网络中,这些向量值单位被称为胶囊,在transformer 中,它们被表示为查询向量、键向量和值向量。通过执行神经活动向量之间的标量乘积等操作,可以计算出强大的算法概念,如符合过滤和注意力。

尽管在胶囊工作上取得了有希望的进展,Barham等人[23]解释说,尽管他们的卷积胶囊模型所需的浮点运算(FLOPS)比CNN少4倍,参数比CNN少16倍,但在TensorFlow[24]和PyTorch[25]中的实现运行速度明显更慢,并且在更小的模型中耗尽内存。虽然后来有人提出了几个更有效的胶囊路由版本[26],[27],[28],[29],但潜在的问题不仅是由路由引起的,还由胶囊投票过程引起。在他们的分析中,[23]得出结论,当前的框架已经针对一个流行的模型家族所使用的一小部分计算进行了高度优化,而且这些框架已经变得不适合研究,因为标准和非标准计算负载之间的性能差异巨大。因此,非标准的工作负载(如胶囊网络中由路由和投票过程引起的工作负载)比它们本可以达到的速度要慢得多。正如[30]所指出的,虽然胶囊网络的操作可以在CPU上很好地实现,但在GPU和TPU这样的加速器上,性能会急剧下降,因为它们使用常见架构中的构建块对标准工作负载进行了大量优化。我们希望这项综述将激励研究人员为胶囊网络开发合适的工具。

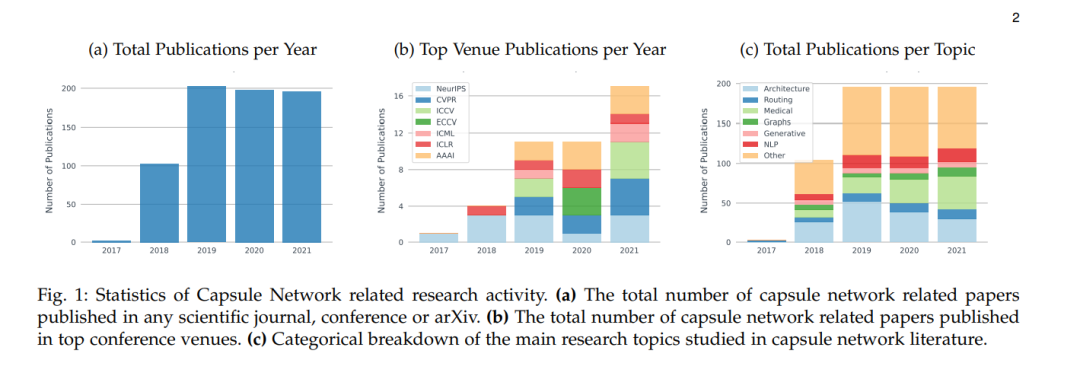

在这项综述中,我们提供了一个全面的概述,使用胶囊网络和相关的注意为基础的模型表征学习。虽然相对而言,胶囊的研究仍处于早期阶段,但图1a向我们显示,尽管最初流行程度迅速增长,但每年的出版物总数有些停滞。这可能是由于进入该领域的高壁垒和缺乏可靠的参考点。尽管如此,如图1b所示,顶级会议的胶囊网相关出版物数量持续稳步增长。我们相信,现在有足够的材料来保证对各种概念、技术和基本思想进行详细的组织,这将有利于社区和激发该领域的研究兴趣。在撰写本文时,仅存在三个基于Capsule Network的综述。[31]是在Capsule Networks首次引入后不久编写的,因此它没有涵盖最近取得的重大里程碑。同样,[32]的写作目的也很简短,因此只涵盖了相关文献的很小一部分。[33]是最近的,涵盖了更广泛的论文,但没有以我们认为必要的方式对该领域进行足够详细的广泛综述。相反,本综述的目的是提供胶囊网络和以对象为中心的表征学习的相关研究的第一次全面和详细的分解。具体而言,我们的目标是:(a)详细解释胶囊网络背后的基础、动机和基本概念;(b)调查胶囊网在各个应用领域的研究现状;(c)将胶囊和协议路由与Transformers 刚和自注意进行关联和比较。(d)讨论有待解决的问题,并提出有前景的研究方向。我们期望我们的综述将作为胶囊网络未来的主要参考文献,并将有助于促进该领域的发展。

本次综述的组织方式如下。在第1节中,我们对胶囊网络背后的思想做了一个介绍性的概述。在第2节中,我们开始温和地介绍不变性和等方差,并解释为什么这些概念在表示学习中是基本的。在第3节中,我们解释了胶囊网络背后的基本思想和动机,并介绍了协议和胶囊路由等基本概念。在第4节中,我们深入研究了文献中提出的最突出的胶囊路由算法。在第5节中,我们将揭示胶囊路由和Transformers中流行的自我注意机制之间的概念相似性。第6至10节讨论胶囊网络在视频和运动、图形、自然语言处理和医学成像方面的一些主要应用。第11节重点介绍胶囊网络的其他应用,如故障诊断、高光谱成像、伪造检测和对抗攻击。最后,在第12节中,我们讨论了胶囊网络的公开挑战和缺点,以及我们认为未来有希望的研究方向。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“LCAS” 就可以获取《帝国理工等最新《胶囊网络综述》论文,29页pdf阐述胶囊的概念、方法与应用》专知下载链接