论文题目

它是这样的:用于可解释图像识别的深度学习,This Looks Like That: Deep Learning for Interpretable Image Recognition

论文摘要

当我们面对具有挑战性的图像分类任务时,我们常常通过剖析图像并指出一个或另一个类的典型方面来解释我们的推理。越来越多的证据可以帮助我们做出最后的决定。在这项工作中,我们介绍了一种深度网络体系结构——原型零件网络(ProtoPNet),其原因与此类似:网络通过寻找原型零件来解剖图像,并结合原型中的证据进行最终分类。因此,该模型的推理方式与鸟类学家、医生和其他人向人们解释如何解决具有挑战性的图像分类任务的方式在质量上相似。该网络仅使用图像级标签进行训练,而不对图像的部分进行任何注释。我们在CUB-200-2011数据集和Stanford Cars数据集上演示了我们的方法。我们的实验表明,ProtoPNet可以达到与其类似的不可解释模型相当的精度,并且当几个ProtoPNet组合成一个更大的网络时,它可以达到与一些性能最好的深层模型相当的精度。此外,ProtoPNet提供了其他可解释的深层模型所不具备的可解释性。

论文模型

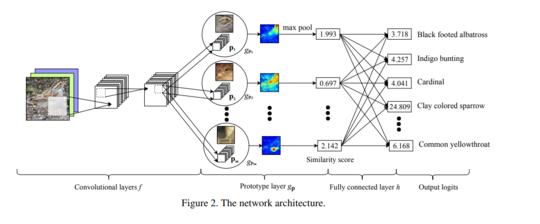

- 最初我们有VGG-16网络的前13层,然后是2,1x1 convs

- 该网络学习m个原型(pj),每个类有一个预定义数量的原型。

- 每个prototpye应用于conv输出的所有面片,并使用L2距离为所有面片的单个原型生成相似度得分,这也可用于制作相似度热图。

- 然后应用全局池将其转换为一个分数gpj,它代表了图像中原型的最强相似发现。

- 然后在FC层反馈m个全局相似性得分进行分类

论文亮点

本文提出了一种新的可解释性深度学习的思想,它基本上是由图像本身的一些原型部分,然后利用这些原型进行分类,从而使分类过程具有可解释性。在NIPS 2019的前3%接受论文中。 论文作者

Chaofan Chen, Oscar Li, Chaofan Tao, Alina Jade Barnett, Jonathan Su, Cynthia Rudin,作者们来自于杜克大学

成为VIP会员查看完整内容

相关内容

杜克大学(Duke University)创建于1838年,是一所私立的研究型大学,其前身为三一学院。杜克大学图书馆藏书量列全美大学第3,仅次于哈佛和耶鲁。不同于其它顶尖的学术大学,杜克大学的体育,尤其是篮球十分有名并且是美国最佳的篮球名校。杜克大学是一所国际性的大学。杜克的学生来自美国各地和全世界九十多个国家,共有约六千三百名本科生和七千多名研究生,攻读各种专业和学位。

专知会员服务

32+阅读 · 2020年6月11日

专知会员服务

44+阅读 · 2020年3月26日

专知会员服务

20+阅读 · 2020年1月26日

专知会员服务

49+阅读 · 2020年1月1日

专知会员服务

60+阅读 · 2019年11月16日

Arxiv

10+阅读 · 2018年12月4日

Arxiv

3+阅读 · 2018年9月6日