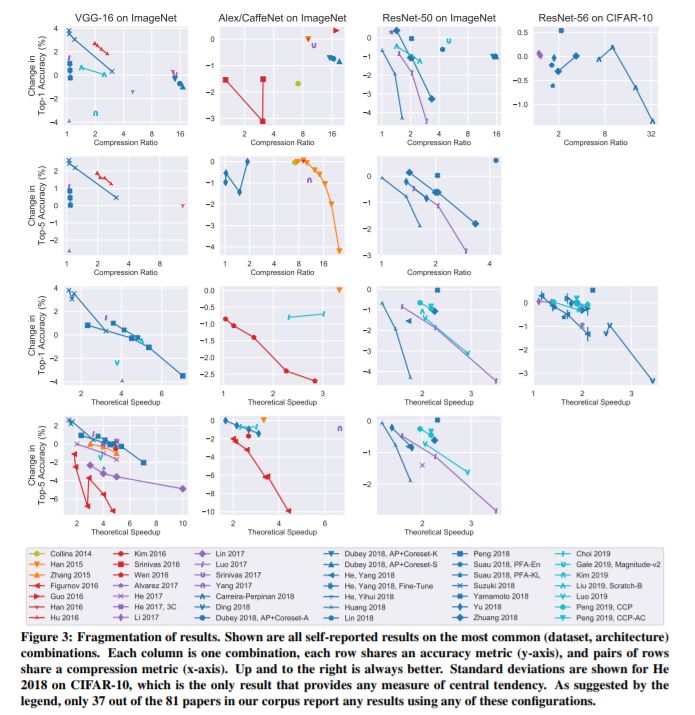

神经网络修剪——通过删除参数来减小网络大小的任务——是近年来大量工作的主题。我们提供了文献的荟萃分析,包括剪枝方法的概述和文献中一致的发现。在对81篇论文的结果进行汇总,并在受控条件下对数百个模型进行修剪之后,我们最明确的发现是,社区缺乏标准化的基准和度量标准。这一缺陷非常严重,以至于很难对修剪技术进行比较,也很难确定这一领域在过去三十年中取得了多大的进步。为了解决这种情况,我们确定了当前实践中的问题,提出了具体的补救措施,并引入了ShrinkBench,这是一个开源框架,用于促进修剪方法的标准化评估。我们使用收缩台对各种修剪技术进行了比较,结果表明,它的综合评价可以防止在比较修剪方法时常见的缺陷。

成为VIP会员查看完整内容

相关内容

人工神经网络(Artificial Neural Network,即ANN),它从信息处理角度对人脑神经元网络进行抽象,建立某种简单模型,按不同的连接方式组成不同的网络。在工程与学术界也常直接简称为神经网络或类神经网络。神经网络是一种运算模型,由大量的节点(或称神经元)之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数(activation function)。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

专知会员服务

17+阅读 · 2019年11月17日

Arxiv

3+阅读 · 2018年9月6日