神经网络如何与图数据库结合?斯坦福Renhongyu博士论文《神经图数据库研究》,详述神经图查询答案方法、数据集、系统、指标和广泛的应用。

图数据库是存储和组织现实世界实体上的结构化信息的主要工具。图数据库的核心任务是查询答案。目标是执行给定的查询并从底层图中检索查询的答案。然而,一个主要的挑战是图数据库中的数据往往是庞大的、嘈杂的和不完整的。实体之间的关系不断变化,这极其难以跟踪。在嘈杂和缺失的数据上执行查询导致答案质量差。这在很多情况下严重限制了图数据库的应用。神经图查询答案算法旨在通过嵌入和表示学习来解决这个挑战。其思想是将复杂的查询和图数据映射到一个潜在空间。这个领域已经经历了大量的增长,大量的研究专注于理论和实际维度,高效地处理各种查询和图类型。

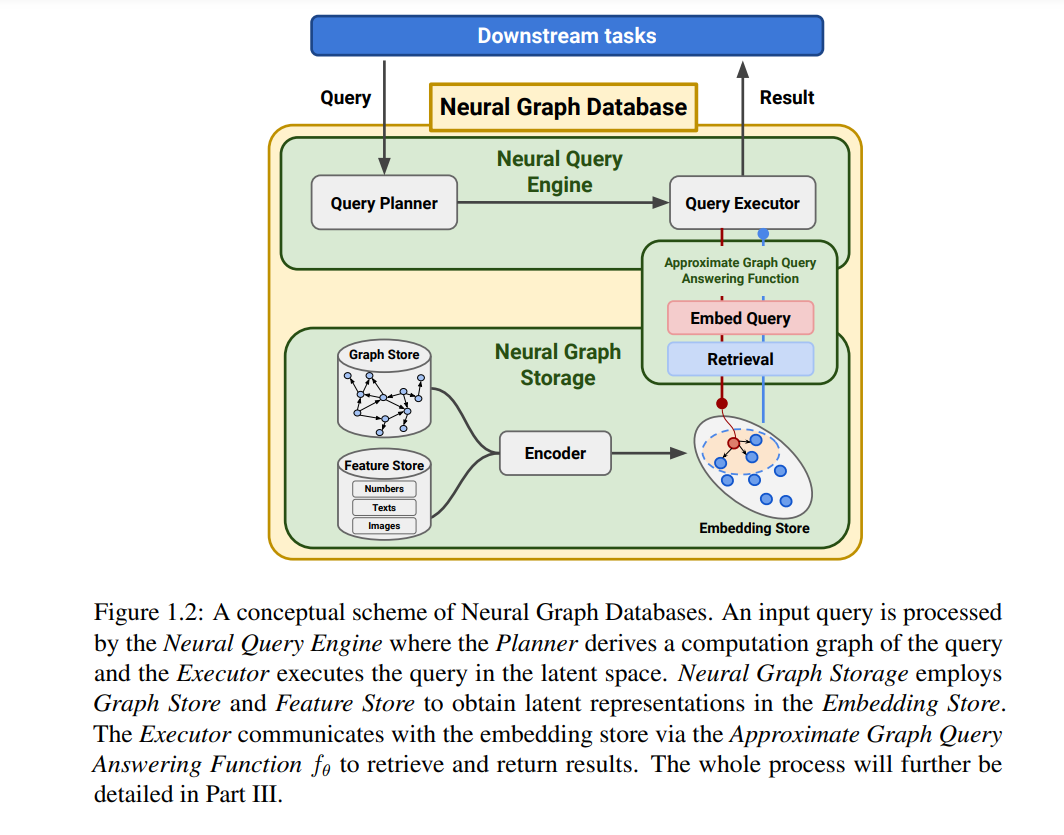

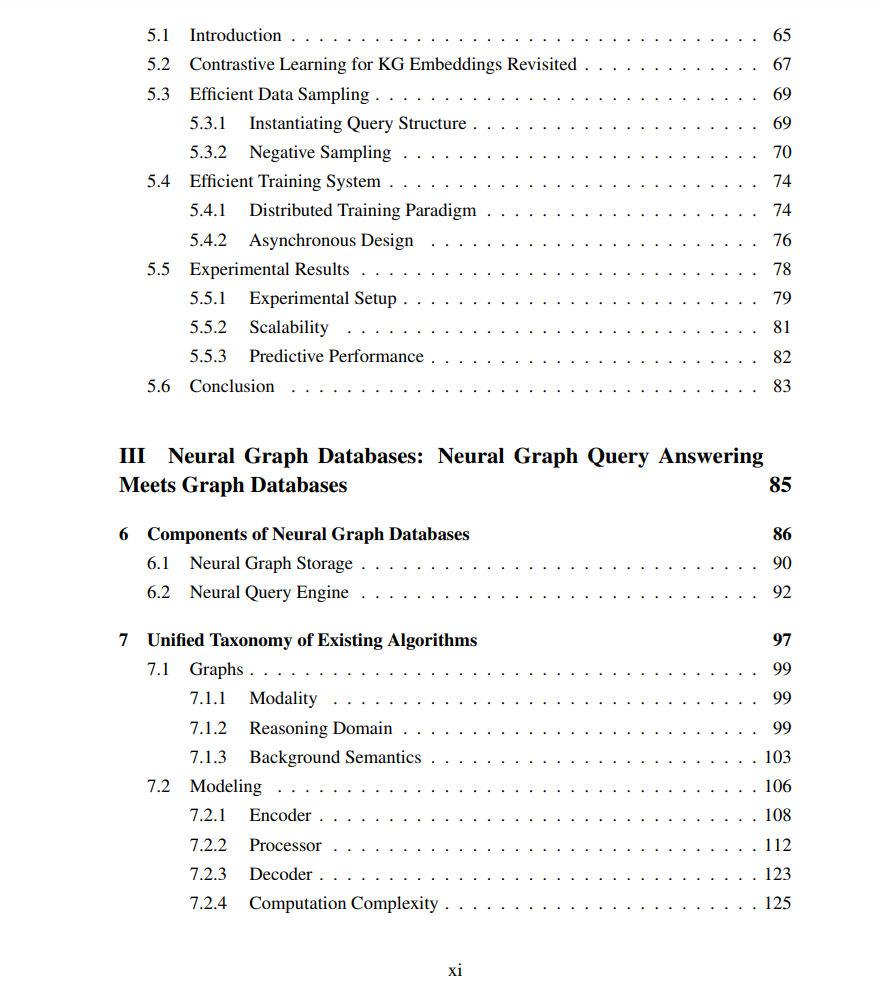

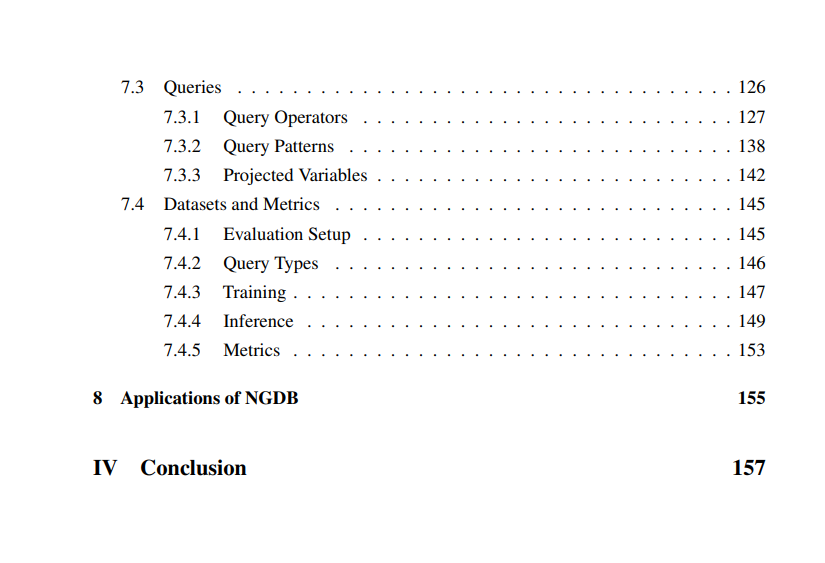

在这篇论文中,我们介绍了神经图数据库(NGDBs)的概念,其中神经图查询答案是其核心。NGDB包括神经图存储和神经图引擎,扩展了图数据库的思想。在NGDB下,我们提供了一系列神经图查询答案方法、数据集、系统、指标和广泛的应用。在第二章中,我们从不同类型的图、图查询、模糊逻辑和图表示学习的定义开始。这为论文提供了基础和背景。在第一部分,我们讨论了两项关于查询嵌入的工作,Query2box和BetaE。Query2box引入了第一个神经图查询答案算法,该算法模拟存在量化、析取和合取操作。BetaE进一步扩展了其能力,包括否定操作。在第二部分,我们设计了第一个也是最可扩展的系统,SMORE,它允许在极大的图上训练神经图查询答案算法。在第三部分,我们介绍了NGDB的整体框架和组件。我们进一步提供了从图、建模、查询和数据集的角度对现有神经图查询答案算法的统一分类。整篇论文介绍了神经图查询答案的任务和NGDB的框架,提出了两个新颖的算法,并指出了NGDB的有前途的方向、未解决的问题和应用。

图数据库(图数据库)捕获、组织和导航现实世界实体上的结构化关系信息。与传统的关系数据库不同,后者将信息存储在带有固定模式的表中,图数据库则将信息存储为异构图,其中节点代表多种类型的实体,边代表实体之间的多种类型的关系。在图数据库中,关系(即,实体之间的异构连接)是一等公民。凭借图结构和更灵活的模式,图数据库允许以更高效和富有表现力的方式处理远距离实体之间的高阶关系,尤其是在多跳层次结构中导航。虽然传统的数据库需要昂贵的联接操作来检索信息,但图数据库可以直接遍历图并通过邻接矩阵更高效地导航链接。由于它们的能力,图数据库成为许多关键工业应用的支柱,包括虚拟助手中的问题答复(Flint, 2021;Ilyas等人,2022)、市场推荐系统(Dong, 2018;Hamad等人,2018)、移动应用中的社交网络(Bronson等人,2013)以及金融行业中的欺诈检测(Tian等人,2019;Pourhabibi等人,2020)。

图数据库最重要的任务之一是执行查询应答。目标是从图数据库中检索给定输入查询的答案。给定查询后,图数据库首先使用查询计划器将查询转换和优化为更高效的图遍历模式,然后使用查询执行器在图数据库上执行该模式,从图存储中检索答案。存储将图压缩为适用于快速表查找的符号索引。在完整性的假设下,查询因此是快速和高效的,即存储的图没有丢失的边。 然而,大多数真实世界的图都是出了名的不完整,例如,在Freebase中,93.8%的人没有出生地,78.5%的人没有国籍(Mintz等,2009),约68%的人没有任何职业(West等,2014),而在Wikidata中,约50%的艺术家没有出生日期(Zhang等,2022a),只有0.4%的已知建筑有关于高度的信息(Ho等,2022)。在不完整性的光下天真地遍历图会导致大量相关结果的遗漏,而且随着跳数的增加,这个问题会进一步加剧。这本质上阻碍了图数据库的应用。之前的链接预测工作通过学习每个边的潜在表示来预测边(Bordes等,2013;Yang等,2015;Trouillon等,2016;Sun等,2019)或挖掘规则(Galarraga等,2013;Xiong等,2017;Lin等,2018;Qu等,2021)。然而,这总是一个权衡,即可能的不完整结果与可判定性之间的权衡 - 在一个更密集的图中,一些SPARQL蕴涵体系(Hawke等,2013)不保证查询执行在有限时间内终止。

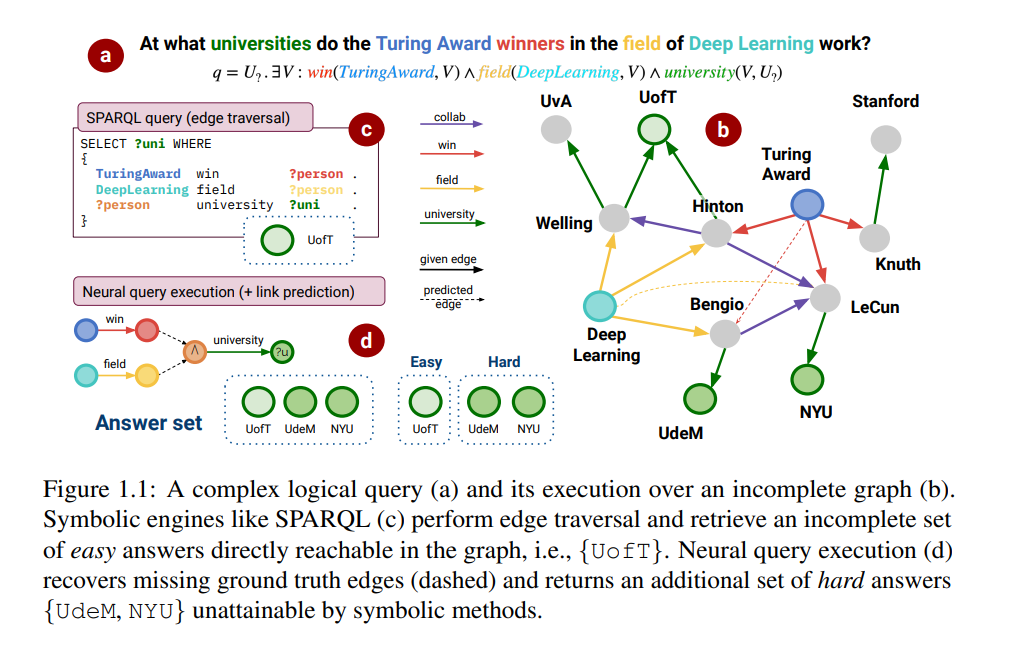

另一方面,图机器学习的最新进展使得在潜在空间中对大型图进行表达式推理成为可能,而不会面临可判定性瓶颈。Hamilton等人(2018)关于图查询嵌入(GQE)的开创性工作为在不完整的知识图谱上回答复杂的、类似数据库的逻辑查询奠定了基础。在这里,通过对实体、关系和逻辑运算符进行可学习的向量表示和神经网络的参数化,可以在查询执行过程中推断出缺失的链接。对于(图1.1)中的不完整知识图,给定一个复杂查询:“深度学习领域的图灵奖得主在哪些大学工作?”,传统的符号图数据库(如SPARQL或Cypher)只会返回一个答案(UofT),可以通过边遍历到达。相比之下,神经查询嵌入在嵌入空间中对图和查询进行参数化。神经查询执行类似于在嵌入空间中遍历图和执行逻辑运算符,这可以推断出缺失的链接,并用两个更相关的答案UdeM和NYU丰富答案集,这两个答案是符号数据库无法获得的。

如1.1节中所介绍,这篇论文提出了一个统一的框架,旨在研究神经图查询应答问题,并组织现有的研究工作以指导未来的研究。论文的结构如下。

部分0:预备知识。我们首先在第2章介绍背景知识,并对图、查询、模糊逻辑和表示学习进行必要的定义。 部分I:知识图谱上的神经图查询应答。我们首先介绍两种受几何属性启发的神经图查询应答算法。这两种算法提出了与符号对应物保持良好一致的神经查询执行方法,同时也能够发现缺失的答案。在第3章,我们介绍了Query2box模型,该模型将查询嵌入为一个超矩形。Query2box设计了一个神经连接运算符,并使用析取范式处理连接。在第4章,我们提出了BetaE模型,这是第一个使用基于Beta分布的嵌入忠实处理否定操作的神经图查询应答算法。

部分II:扩展神经图查询应答算法。在第5章,我们实现了第一个也是最高效的系统SMORE,它可以扩展多种神经图查询应答算法到极大的图中。SMORE设计了一个多工作框架,配有优化的管道和快速的查询采样器,以加速训练和推理。

部分III:神经图数据库:神经图查询应答遇到图数据库。最后,我们进一步提出了一个新颖的框架——神经图数据库(NGDB),其中神经图查询应答是核心任务,并通过神经查询嵌入方法来处理。在第6章,我们介绍了NGDB的组成部分:神经图存储和神经查询引擎,它们分别对应于常规图数据库中的两个对应部分的神经版本。在第7章,我们制定了一个分类现有工作的分类法,主要围绕三个轴:图(底层图及其模式背后的逻辑形式主义);建模(用什么神经方法回答查询);查询(可以回答哪些查询)。在第8章,我们列出了神经图查询应答算法的应用。

部分VI:结论。我们得出结论,并讨论未来的挑战和有前景的方向。

参考文献:

• Hongyu Ren*, Weihua Hu*, Jure Leskovec. Query2box: Reasoning over Knowledge Graphs in Vector Space Using Box Embeddings. International Conference on Learning Representations (ICLR), 2020.

Hongyu Ren, Jure Leskovec. Beta Embeddings for Multi-Hop Logical Reasoning in Knowledge Graphs. Neural Information Processing Systems (NeurIPS), 2020 • Hongyu Ren*, Hanjun Dai*, Bo Dai, Xinyun Chen, Denny Zhou, Jure Leskovec, Dale Schuurmans. SMORE: Knowledge Graph Completion and Multi-hop Reasoning in Massive Knowledge Graphs. ACM SIGKDD Conference on Knowledge Discovery and Data Mining (KDD), 2022.

• Hongyu Ren*, Mikhail Galkin*, Michael Cochez, Zhaocheng Zhu, Jure Leskovec. Neural Graph Reasoning: Complex Logical Query Answering Meets Graph Databases. Preprint: https://arxiv.org/abs/2303.14617.

• Chapter 8: Hongyu Ren, Hanjun Dai, Bo Dai, Xinyun Chen, Michihiro Yasunaga, Haitian Sun, Dale Schuurmans, Jure Leskovec, Denny Zhou. Latent Execution-Guided Reasoning for Multi-Hop Question Answering on Knowledge Graphs. International Conference on Machine Learning (ICML), 2021.