【导读】CVPR2020workshop的视觉与语言研究,邀请了业界学者讲述了视觉语言之间的研究进展。来自微软和facebook的Licheng Yu, Yen-Chun Chen, Linjie Li讲述了自监督学习在视觉语言建模中的技术进展,共115页ppt,不容错过!

https://rohit497.github.io/Recent-Advances-in-Vision-and-Language-Research/

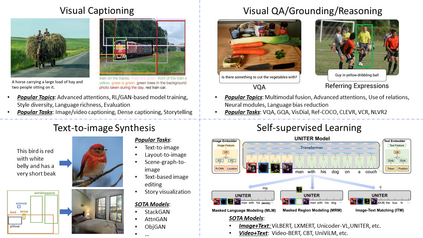

视觉和语言(V+L)研究是计算机视觉和自然语言处理之间联系的一个有趣的领域,并迅速吸引了这两个领域的关注。各种各样的V+L任务,以大规模的人类注释数据集为基准,已经推动了联合多模态表示学习的巨大进步。本教程将重点介绍该领域中最近流行的一些任务,如视觉描述、视觉基准、视觉问题回答和推理、文本到图像的生成以及通用图像-文本表示的自监督学习。我们将涵盖这些领域的最新方法,并讨论集中体现多模态理解、推理和生成的核心挑战和机遇的关键原则。

成为VIP会员查看完整内容