NLP+CV《桥接视觉与语言的研究综述》,带你全面了解视觉+语言最新应用和方法

转自 专知

【导读】由于深度学习、计算机视觉和自然语言处理等多学科领域的兴趣激增,视觉和语言任务的结合得到了显著的发展。比如大家熟知的:Visual Description Generation、Visual Storytelling、Visual Question Answering、Visual Dialog、Multimodal Machine Translation等等。近期德国Saarland大学计算机视觉专家Aditya Mogadala博士等人近期发布了《Trends in Integration of Vision and Language Research: A Survey of Tasks, Datasets, and Methods》,本综述重点研究了10种不同的视觉和语言桥接任务,包括它们的问题定义、方法、现有数据集、评估指标,以及与相应的最先进方法的结果的比较。

题目:Trends in Integration of Vision and Language Research: A Survey of Tasks, Datasets, and Methods

作者:Aditya Mogadala, Marimuthu Kalimuthu, Dietrich Klakow

【摘要】近年来,由于深度学习、计算机视觉和自然语言处理等多学科领域的兴趣激增,视觉和语言任务的桥接得到了显著的发展。在本综述中,我们重点研究了10种不同的视觉和语言桥接任务,包括它们的问题定义、方法、现有数据集、评估指标,以及与相应的最先进方法的结果的比较。这超越了早期的一些综述,这些综述要么是特定于任务的,要么只专注于一种类型的视觉内容,即图像或视频。最后,我们讨论了视觉与语言研究未来可能的整合方向。

参考链接:

https://arxiv.org/abs/1907.09358

请关注专知公众号(点击上方蓝色专知关注)

后台回复“桥接视觉与语言的研究综述论文” 就可以获取最新论文的下载链接~

引言

近年来,深度学习的发展使得计算机视觉(CV)和自然语言处理(NLP)领域在多项任务中取得重大进展。

最近很多研究都热衷于解决这些传统独立领域的语言和视觉信息相结合的挑战。应对语言和视觉结合挑战的方法应提供对视觉或文本内容的完全理解,并期望(1)生成关于视觉内容的可理解但简洁且语法良好的描述,反之亦然,其中给定文本描述生成视觉内容返回(2)识别视觉内容中的对象并推断它们与原因的关系或回答关于它们的任意问题(3)通过利用视觉和自然语言指令的输入来进行浏览(4)翻译文本从一种语言到另一种语言的内容,其视觉内容用于消除歧义(5)生成有关视觉内容的故事等。这些方法的设计可以处理和关联来自多种形式的信息(即语言和视觉信息),通常被称为多模态学习模型的一部分(Mogadala,2015)。

然而,在这篇文章中,作者不仅提供了十个不同任务的全面概述,还提供了驱动当前视觉和语言研究集成的方法、数据集和评估指标。在第2节中,首先介绍了视觉和语言集成的10个重要任务及其方法,并在第3节中概述了用于每个任务的数据集。然后,在第4节中,我们分别描述了视觉和语言的表示,并进一步讨论了将视觉和语言结合起来实现任务的主要方法。在第5节中,我们给出了用于所有10个任务的评估指标。此外,在第6节中,还比较和讨论了通过相应方法实现的每个任务的基准结果。在第7节中,我们讨论了可能的未来方向,最后第8节结束了我们的综述,并讨论了对结果的一些见解。

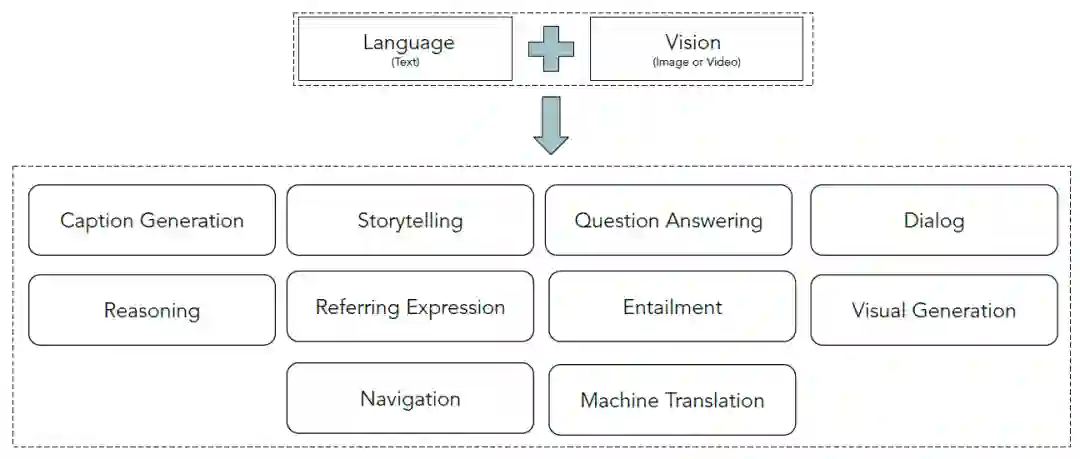

然而,在综述中,我们超越了单词并提出了那些将可变长度大于单词的文本作为语言输入的任务。这些任务中的大多数被视为对CV、NLP或这两个问题的扩展。图1总结了不同的任务。然而,为了了解这些任务如何被视为CV,NLP或两者中问题的自然延伸,我们简要地发现它们与其各自研究中解决的类似任务之间的相关性。

图1:十种不同的语言和视觉集成任务。

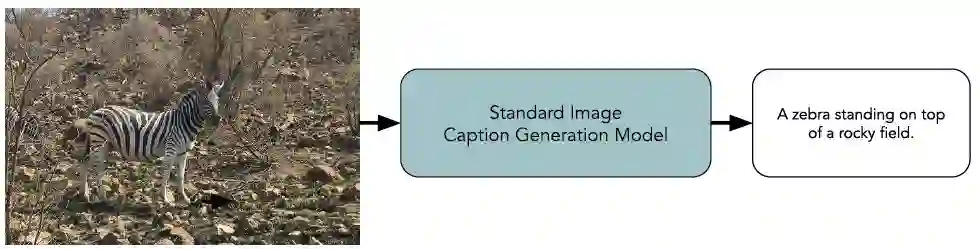

图2:给定一张图像,标准图像描述生成模型生成一个全局文本描述。

表1:生成图像全局描述的方法摘要。

图3:给定一个视频(表示为帧序列),视频描述生成模型生成单个全局标题。

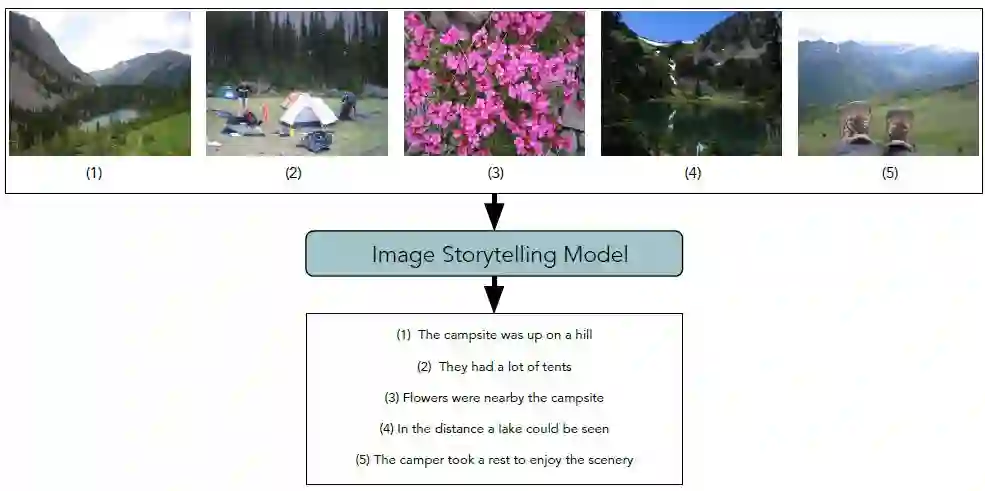

图4:给定图像序列,图像叙事模型按顺序生成文本故事。

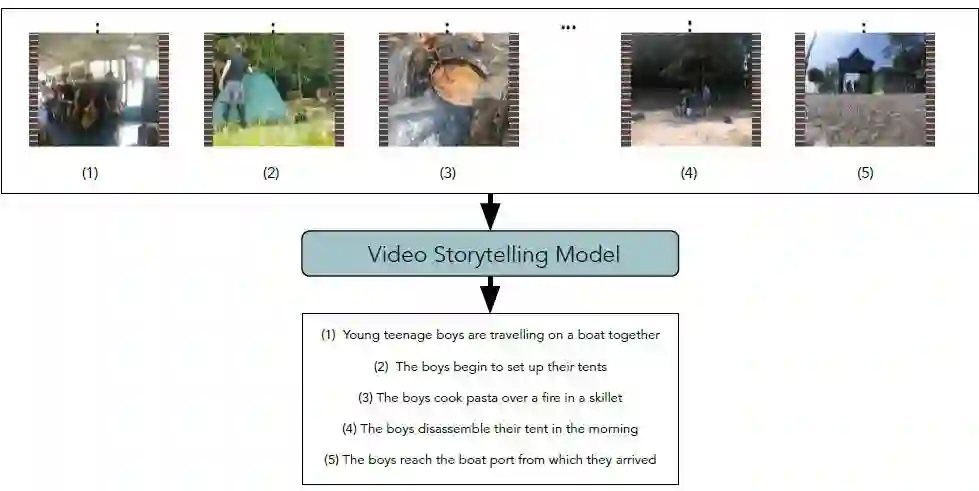

图5:给定视频帧(摘自(Li et al., 2018)),视频叙事模型按顺序生成文本故事。

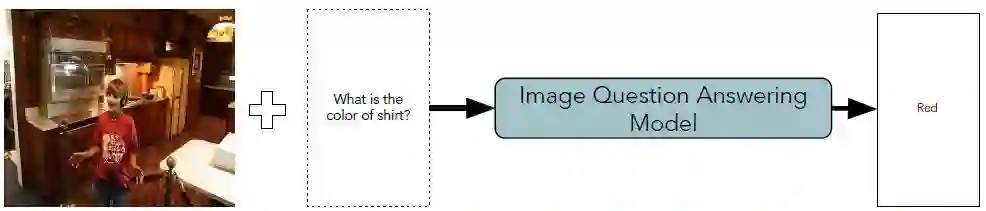

图6:给定一张图像和问题,图像问答模型产生答案。

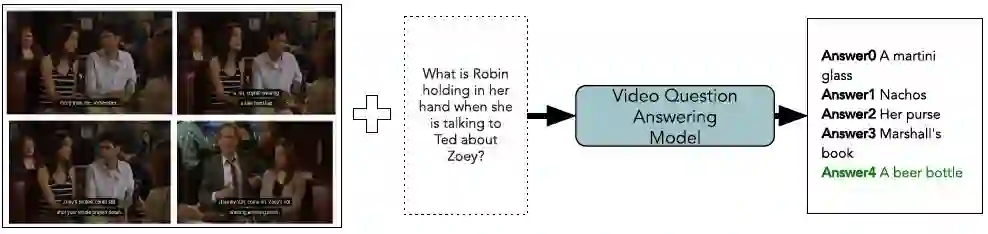

图7:给定一个视频(由TV Q&A数据集中的帧序列表示)和问题,视频问答模型从多个选项中找到正确的答案。

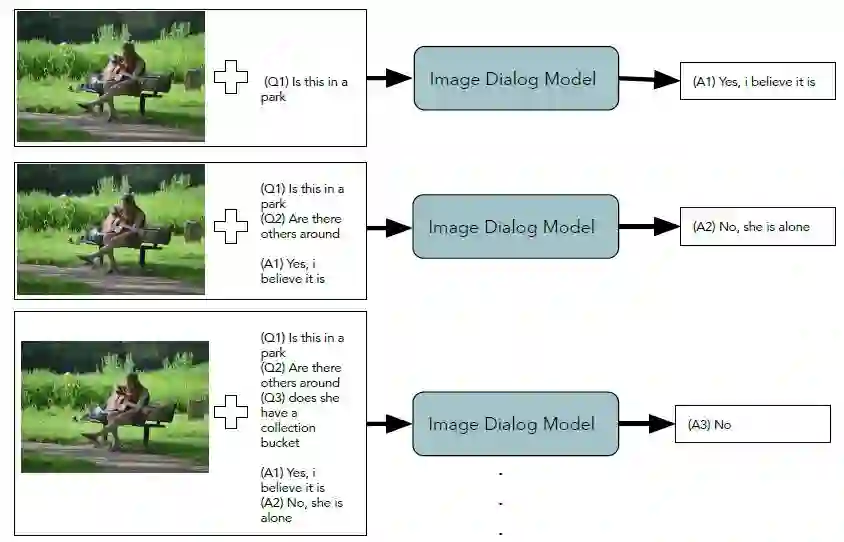

图8:给定一张图像,问题和对话历史记录,图像对话模型基于它生成答案。

-END-

专 · 知

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎登录www.zhuanzhi.ai,注册登录专知,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),加入专知人工智能主题群,咨询技术商务合作~

专知《深度学习:算法到实战》课程全部完成!550+位同学在学习,现在报名,限时优惠!网易云课堂人工智能畅销榜首位!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程