本文呢提出一个系统,可实现人类用户与经过训练、能在模拟3D空战场景中控制战斗机的智能体之间的实时交互。这些智能体在多智能体强化学习框架下,于专用环境中训练而成。开发了一条通信链路,使得训练完成的智能体能够无缝部署到VR-Forces中——VR-Forces是一种广泛应用于逼真战术场景的国防仿真工具。此集成支持混合仿真,即人类控制的实体与表现出独特作战行为的智能体进行对抗。交互模型为人类-智能体协同、沉浸式训练以及在国防背景下探索创新战术创造了新的机遇。

将人工智能(AI)的巨大潜力从战略任务扩展到空战等安全关键领域,需要逼真的模拟和交互设置,使人类能够在训练与执行过程中影响和评估AI智能体。尽管存在多种作战环境[5, 11],但仅有少数能提供逼真的飞行动力学模拟,而能实现AI模型与人类用户直接交互的则更为稀少[3, 4, 12]。洛克希德·马丁公司在DARPA“阿尔法狗斗试验”中的开创性工作,首次强调了人在回路的1对1空战场景中人机交互的重要性[10]。将人类纳入回路对于确保AI系统符合人类判断与安全约束至关重要,同时也能在高风险领域培养信任并发挥互补优势。然而,在多智能体防御设置中的人机交互仍相对未被充分探索。本研究贡献了一个模块化框架以弥合这一差距。该系统使用多智能体强化学习(MARL)在自定义的3D环境中训练智能体,该环境确保了精确的飞行动力学仿真。利用IEEE标准的分布式交互仿真(DIS)协议[6],我们开发了一个通信接口,允许将MARL智能体无缝部署到VRForces(VR-F)中——VR-F是国防组织使用的战术模拟器(图1a和图1b)。此集成实现了人类操作的实体与AI控制的飞机之间的实时交互,促进了竞争性智能体行为并增强了军事人员的训练真实感。据我们所知,这是首个将MARL智能体集成到VR-F中以实现人机编组的方法。这为战术创新和探索作战任务中的创新策略开辟了新途径。

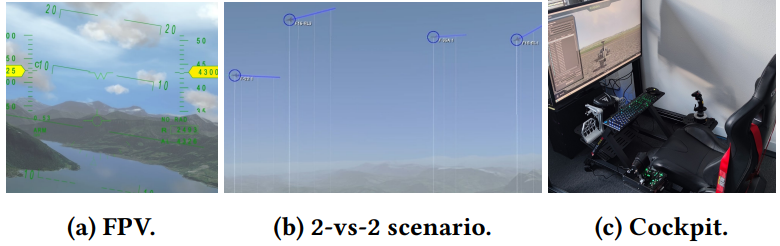

图1:VR-Forces场景展示,分别为(a)第一人称视角(FPV),(b)战斗态势,以及(c)模拟器座舱。