大型语言模型(LLMs)与视觉语言模型(VLMs)等大模型正在重塑人工智能的发展格局,推动了自然语言处理、计算机视觉以及多模态学习等领域的应用。然而,全面微调这类模型的成本仍然高昂,通常需要大量的计算资源、内存以及任务特定的数据。参数高效微调(PEFT)作为一种新兴的解决方案,通过仅更新模型的一小部分参数,使得大模型能够高效地适应下游任务。 本综述全面梳理了PEFT技术的发展脉络,重点探讨其动机、设计原则与实际效果。我们首先分析了传统微调所面临的资源与可及性挑战,指出过拟合、灾难性遗忘和参数低效等关键问题。接着,我们引入了一套结构化的PEFT方法分类体系,将现有技术划分为加性(additive)、选择性(selective)、重参数化(reparameterized)、混合式(hybrid)与统一式(unified)等五大框架,并系统性地比较了它们的机制与权衡。 除了分类,我们还深入探讨了PEFT技术在语言、视觉以及生成建模等不同领域中的应用表现,展示了其在降低资源消耗的同时依然保持优异性能的潜力。我们进一步讨论了PEFT在可扩展性、可解释性与鲁棒性方面仍面临的重要挑战,并提出未来的研究方向,包括联邦学习、领域自适应以及理论基础构建。 我们的目标是为读者提供对PEFT技术的统一理解,揭示其在推动大模型高效、实用与可持续发展中的关键作用。

1 引言

大型语言模型(LLMs)[601, 280] 与预训练语言模型(PLMs)[432, 436, 577, 719] 正在彻底改变人工智能的发展方向 [648, 122],推动自然语言处理(NLP)[96, 478]、计算机视觉(CV)[30, 707] 和多模态学习 [56, 187, 508] 等领域实现突破性进展。这些模型通常拥有数十亿参数,训练数据规模庞大,在文本生成 [455, 129]、语言翻译 [267, 10]、对话系统 [355, 555]、聊天机器人 [326, 571] 和内容摘要 [3, 55] 等应用中展现出前所未有的能力。它们重新定义了人工智能的边界 [497],并在学术界、工业界及实际应用中产生了深远影响 [205, 569]。 尽管具备巨大潜力,现代LLMs和PLMs的体量与复杂性仍对研究和产业界构成严峻挑战 [539, 802]。以LLama-3为例 [424, 333],这是当前最先进、计算要求最高的LLM之一 [152, 766]。其架构包含约3000亿个参数,采用复杂的多头注意力机制 [256, 170, 27, 514, 810],在多项任务上达到了SOTA水平 [507, 486]。然而,如此强大的模型,其微调过程极其复杂 [12, 127],需要动用庞大的计算基础设施,例如PB级存储系统、超高带宽内存接口,以及大量高性能GPU阵列 [380, 655]。有效地微调LLama-3 [152, 445],往往需配置数百乃至数千颗数据中心级GPU,常见如NVIDIA A100或H100 [242, 806]。尽管这些GPU配备数十GB的高带宽内存(HBM),仍不足以单独容纳LLama-3的全部参数、中间激活值和优化器状态。因此,必须通过多个GPU协同部署模型及其训练流程。为了确保训练效率,必须精心编排分布式训练范式 [454],包括张量并行 [665, 336, 656]、流水线并行 [260, 629, 481, 760] 和模型分片 [353, 374] 等策略,以保持吞吐率并实现负载均衡。这种基础设施的复杂性及其运维成本,极大限制了此类模型的微调可及性和可部署性 [151]。 传统微调方式 [368, 614] 需针对每个新任务更新模型的所有参数,在模型规模不断扩大的背景下,这种做法日益难以为继。解决这一问题对于发挥LLMs和PLMs的最大潜能至关重要 [613]。若能优化其部署与微调过程 [616, 534],不仅可降低计算开销,还能提升模型在多种任务中的适应性,确保其在不同场景中持续发挥作用 [582, 709]。缩小这一差距对于实现技术民主化具有重要意义,有助于资源有限的组织也能充分利用如LLama-3 [547, 382] 这类强大模型,并应用于新兴领域 [488, 232]。 本研究的核心问题是:LLMs 和 PLMs 的资源需求及微调挑战有哪些?又该如何应对以优化其部署与适配?这一问题旨在揭示现有方法的关键瓶颈,并探索提升效率与可用性的策略。 本研究的目标是系统分析LLMs、VLMs 与 LMMs [435, 538, 575] 所面临的计算与微调挑战,并识别优化其部署与微调的可行策略 [6, 99]。通过系统性的分析,本文旨在为研究人员与工程实践者提供可操作的指导,帮助他们突破现有模型的使用限制。 我们假设:要实现LLMs的最佳性能,需投入大量的计算资源与调优专业知识。然而,参数高效微调(PEFT)[520, 634, 311]等策略——只更新模型中一小部分参数——能够在大幅减少计算资源需求的同时,维持甚至提升模型性能 [734]。通过探索和验证这些方法,本研究希望推动对LLMs与PLMs更深入的理解与普及,为其在AI研究与应用中的高效使用奠定基础 [570, 207]。 PEFT方法 [384] 作为一种替代方案,通过显著减少可训练参数 [69, 628, 291],提升了微调过程的可访问性、可扩展性与可持续性。例如,adapter模块、prefix-tuning [444, 517, 76, 427]、LoRA(低秩适配)[17, 130, 335]、BitFit 以及 prompt tuning 等方法,在多项基准测试中展现出与完整微调相当甚至更优的性能,而资源消耗仅为其一小部分。PEFT尤其适用于实际应用中需处理多个任务、资源受限或需部署于边缘设备的场景。 尽管PEFT的应用愈发广泛,但当前仍缺乏系统性的理解框架,涉及其设计空间、方法权衡及跨模态适用性等方面。为填补这一空白,本综述系统回顾了语言与视觉模型中的PEFT方法 [735]。我们首先分析标准微调在计算与内存层面上的限制,并讨论其固有弊端。接着提出一套统一的分类体系,将PEFT方法划分为五大类:加性、选择性、重参数化、混合式与统一式方法,提供一个结构化视角用于理解与比较各类策略。 此外,我们评估了PEFT在NLP [286, 148]、计算机视觉、多模态任务与生成建模等多个领域中的应用,展示其在提升效率、促进泛化与实现更负责任AI方面的潜力。最后,本文还识别了该领域面临的关键挑战与开放问题,包括可解释性、理论基础构建与特定领域的适配 [68, 701],并提出未来可能的研究方向。 通过本综述,我们希望为研究者与从业者提供一份清晰、全面的PEFT方法指南,帮助他们构建更高效、可适应的AI系统。

2 主要贡献

本综述的主要贡献总结如下: * 全面的资源分析:深入探讨对大规模预训练模型(PLMs与LLMs)进行完整微调时的计算、内存与存储需求,重点分析研究者在基础设施受限条件下的实际挑战。 * 微调局限性的批判性分析:讨论传统微调策略在低资源任务中过拟合、持续学习中的灾难性遗忘、参数更新冗余及可扩展性瓶颈等问题。 * 统一的PEFT方法分类体系:提出一套将PEFT方法分为五大类(加性、选择性、重参数化、混合式、统一式)的结构化分类体系,用以明确比较不同设计策略及发现共性。 * 代表性方法的对比分析:对LoRA、adapter、BitFit、prompt tuning 和 prefix-tuning 等主流方法进行横向评估,分析其参数效率、性能权衡与实现复杂度。 * 跨领域应用调研:梳理PEFT在NLP、计算机视觉、多模态学习、语音和生成建模等领域的应用,突出其在鲁棒性、可迁移性和实际可用性方面的优势。 * 专用场景下的适配研究:探索PEFT在持续学习、联邦学习、隐私保护微调、领域适应与低资源语言支持等新兴领域的应用前景。 * 实证研究与趋势总结:总结近期实证研究与性能基准,揭示PEFT研究中的趋势与各方法适用条件。 * 开放问题与未来方向:指出当前PEFT方法面临的难点,如可扩展性、可解释性欠缺、理论支持不足与标准化缺失,并呼吁构建具语义感知与架构敏感性的设计。 * 可操作性总结与实用指南:为实践者提供实用指南,帮助他们依据资源预算、任务类型与模型结构,选择合适的PEFT方法。

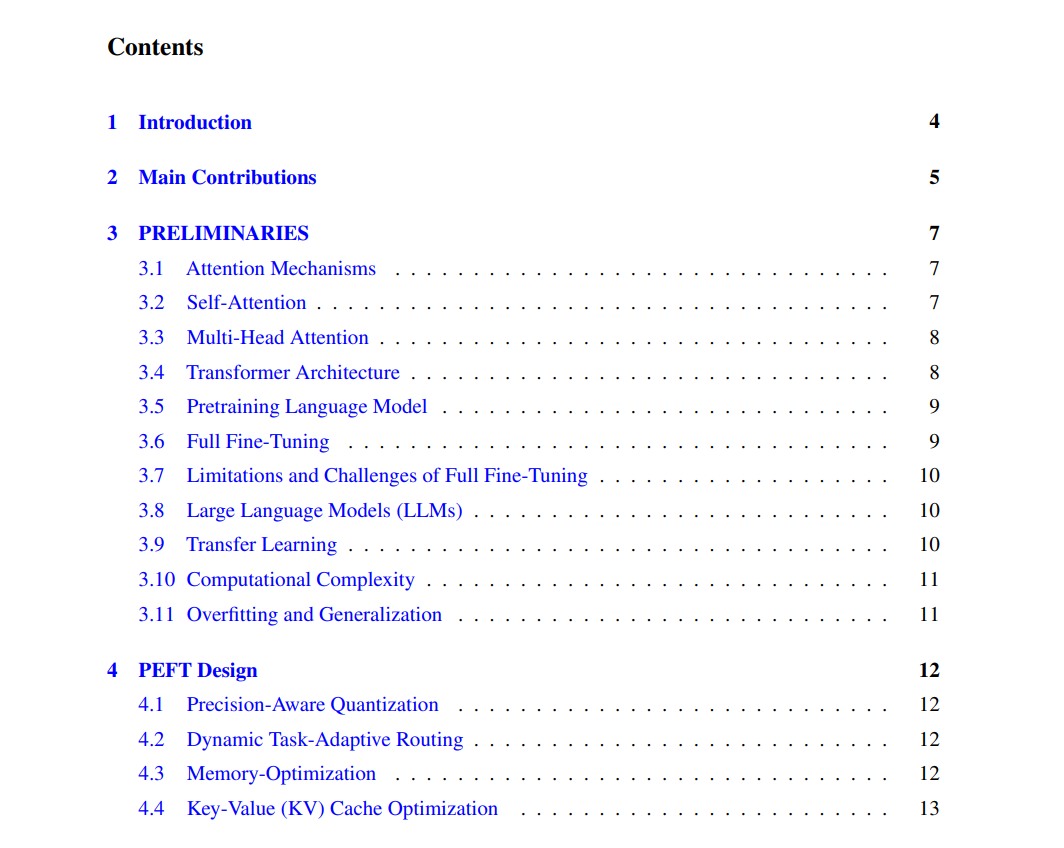

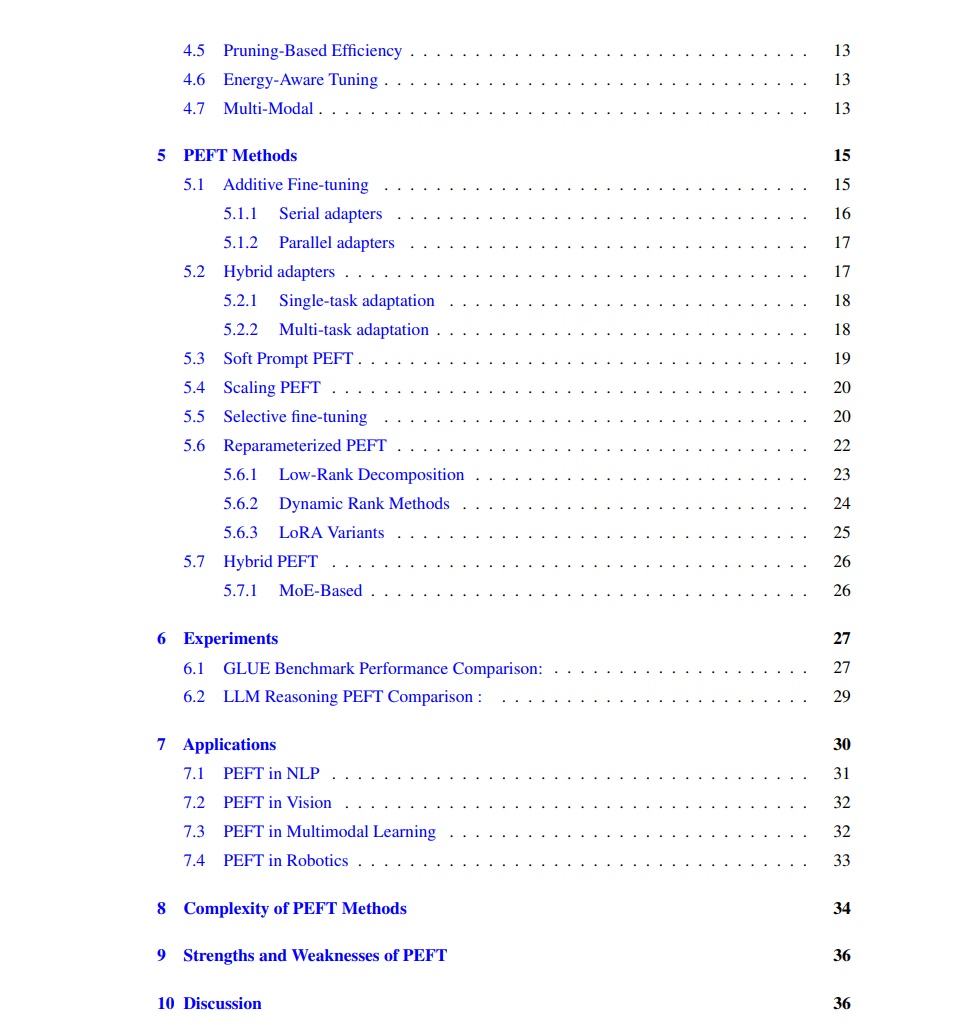

本文结构安排如下: 第1节阐述研究背景与动机,聚焦大规模基础模型(如大语言模型LLM、视觉大模型VLM、多模态大模型LMM)的崛起趋势,以及参数高效微调(PEFT)方法在降低全参数微调高昂计算与资源成本方面的必要性。 第2节概述本综述的核心贡献,包括:建立PEFT方法系统分类体系、评估其效能折衷关系、深入探讨跨领域应用场景与局限性。 第3节阐释PEFT理论基础,涵盖注意力机制、自注意力、多头配置、Transformer架构等核心概念,结合复杂度与扩展性分析揭示全参数微调的低效本质。 第4节详述PEFT策略设计的关键架构与实践考量,包括设计目标、量化决策空间、任务自适应路由机制,以及面向多模态场景的内存-时间-能效优化策略。 第5节阐述核心PEFT方法体系,包含串/并行适配器的增量微调、面向任务特化的混合适配器、软提示调优,以及LoRA等重参数化方法,并探讨扩展规律、选择性微调和基于MoE的混合框架等前沿方向。 第6节通过GLUE等基准数据集实证评估PEFT方法,在NLP任务和大模型推理场景中揭示参数量与性能的权衡规律。 第7节探索PEFT技术在自然语言处理、计算机视觉、多模态学习及机器人等领域的应用实践,突出其跨域适应性与领域特异性优势。 第8节量化分析不同PEFT策略的计算、内存与扩展复杂度,从理论与实践双维度对比其效率特征。 第9节系统总结PEFT方法的优势与局限,重点讨论参数效率、适应能力、泛化性能及实际部署中的约束条件。 第10节指出现有PEFT方法的四大核心缺陷:启发式依赖、理论欠缺、可解释性不足与标准化缺失,强调发展语义感知与架构敏感的创新型设计之迫切性。 第11节展望六大前沿研究方向:参数影响力理论建模、分层调优策略、持续学习融合、可解释性框架、基准测试体系及隐私保护型PEFT。 第12节总结PEFT技术在推动大模型高效扩展应用中的关键作用,及其对构建资源友好型人工智能生态的战略意义。