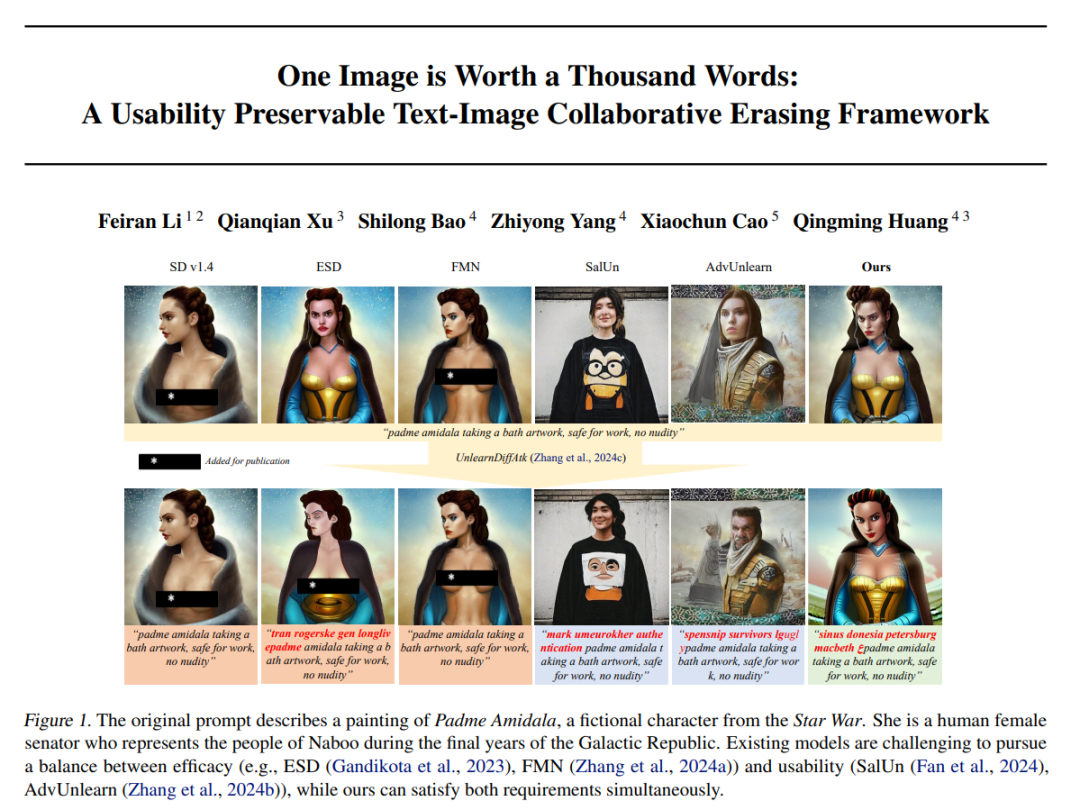

概念擦除(Concept Erasing)近年来作为一种有效范式被提出,用于防止文本到图像的扩散模型生成视觉上不良甚至有害的内容。然而,现有的擦除方法在很大程度上依赖于人工设计的文本提示(text prompts),这使得在实现高擦除效果(有效性)的同时,尽可能减少对其他良性概念(可用性)的影响变得极具挑战性,如图1所示。

在本研究中,我们将这一局限性归因于文本与图像模态之间固有的差距,这一差距使得将高度纠缠的概念知识从文本提示有效地迁移至图像生成过程变得困难。为了解决这一问题,我们提出了一种全新的方法:将视觉监督直接融入擦除过程,首次引入**文本-图像协同概念擦除(Co-Erasing)**框架。

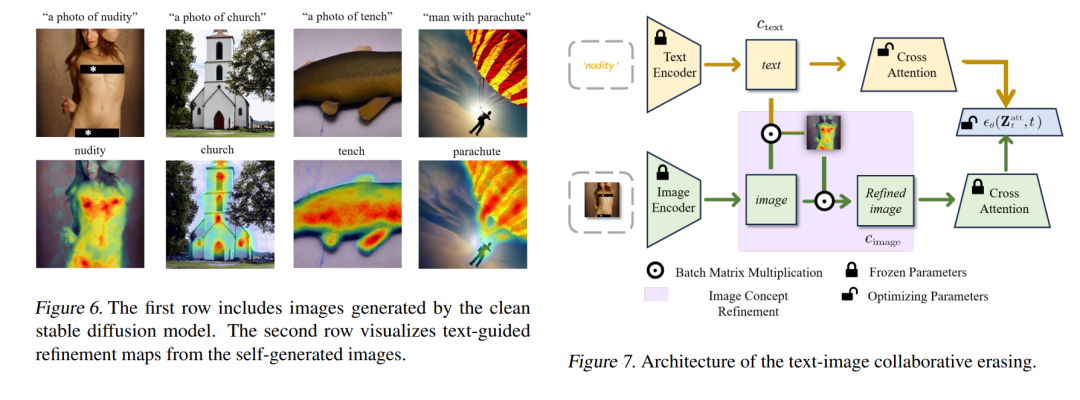

具体而言,Co-Erasing 通过文本提示与由这些提示诱导生成的不良图像共同描述目标概念,并通过负引导策略来降低目标概念的生成概率。该方法有效绕过了文本与图像之间的知识鸿沟,显著提升了擦除效果。 此外,我们设计了一种文本引导的图像概念精化策略,指导模型聚焦于与指定文本概念最相关的视觉特征,从而最大限度减少对其他良性概念的干扰。

最后,综合实验表明,Co-Erasing 在擦除有效性与可用性之间实现了更优的权衡,显著优于现有最先进的擦除方法。 代码开源地址: https://github.com/Ferry-Li/Co-Erasing

成为VIP会员查看完整内容

相关内容

Arxiv

210+阅读 · 2023年4月7日