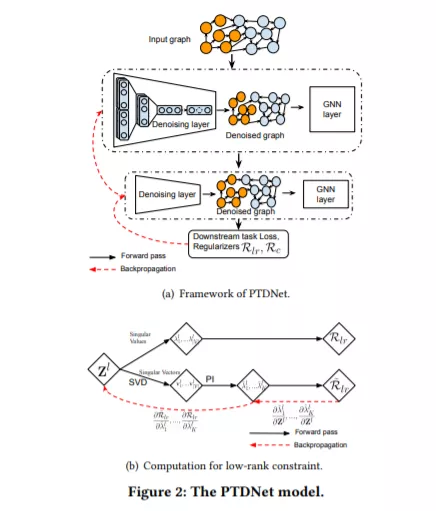

图神经网络(GNN)已被证明是图分析的强大工具。关键思想是沿着给定图的边递归地传播和聚合信息。尽管它们取得了成功,但是,现有的GNN通常对输入图的质量很敏感。真实世界的图通常是噪声和包含任务无关的边缘,这可能导致在学习的GNN模型中泛化性能次优。本文提出一种参数化拓扑去噪网络PTDNet,通过学习丢弃任务无关边来提高GNNs的鲁棒性和泛化性能。PTDNet通过使用参数化网络惩罚稀疏图中的边数来删除与任务无关的边。考虑到整个图的拓扑结构,采用核范数正则化对稀疏图施加低秩约束,以便更好地泛化。PTDNet可以作为GNN模型的关键组件,以提高其在各种任务中的性能,如节点分类和链路预测。在合成数据集和基准数据集上的实验研究表明,PTDNet可以显著提高GNNs的性能,并且对于噪声较大的数据集性能增益更大。

http://personal.psu.edu/dul262/PTDNet/WSDM2021_PTDNet_camera_ready.pdf

成为VIP会员查看完整内容

相关内容

Arxiv

2+阅读 · 2020年12月13日

Arxiv

7+阅读 · 2020年9月2日

Arxiv

4+阅读 · 2018年9月11日

Arxiv

6+阅读 · 2018年3月24日