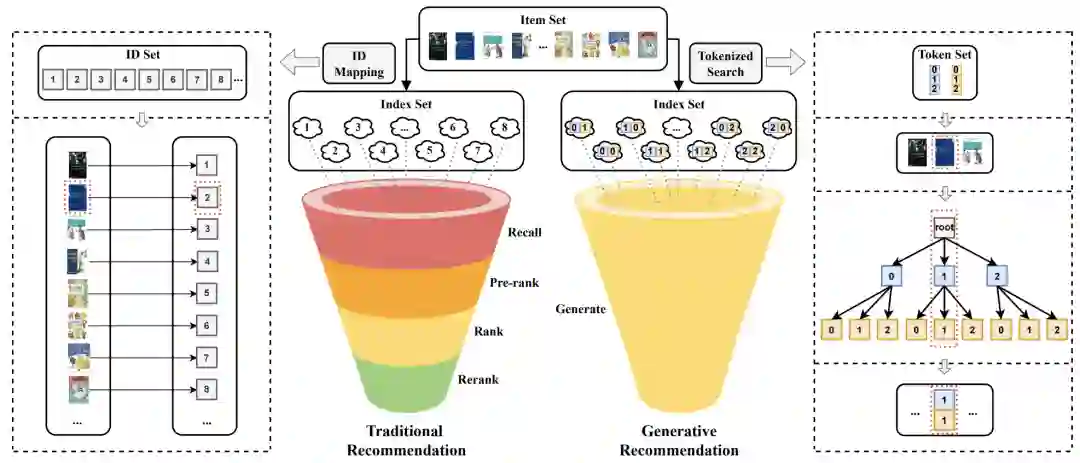

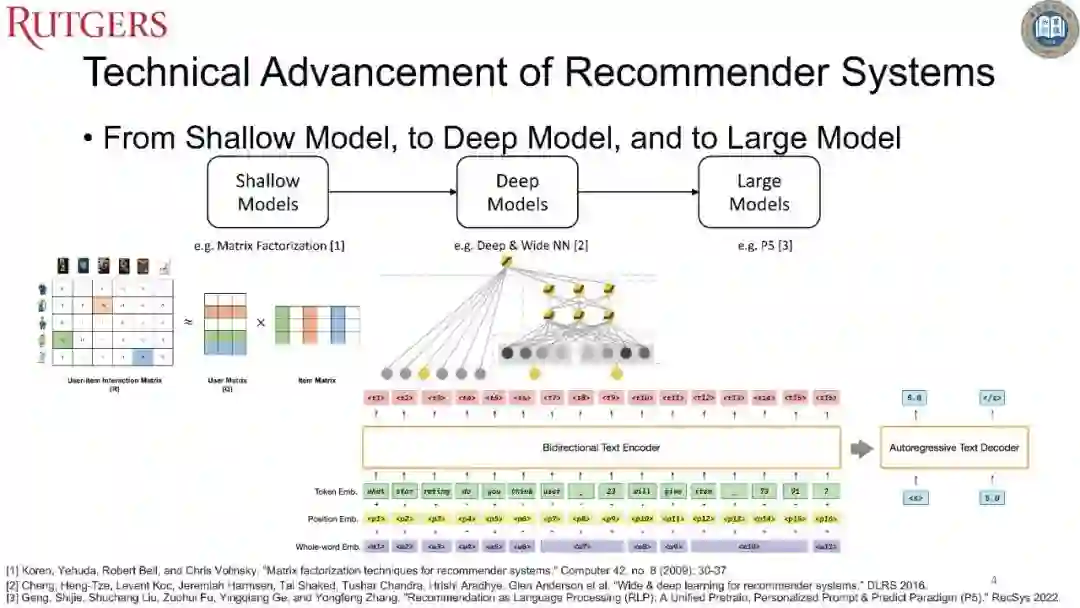

基础模型,如大型语言模型(LLMs),已显著推进了许多研究领域。特别是,LLMs为推荐系统提供了显著的优势,使它们成为个性化推荐的有价值工具。例如,通过将各种推荐任务如评分预测、序列推荐、直接推荐和解释生成等转化为语言指令,LLMs可以构建能够处理不同推荐任务的通用推荐引擎。此外,LLMs具有出色的自然语言理解能力,使它们能够理解用户偏好、项目描述和上下文信息,以生成更准确和相关的推荐,提高用户满意度和参与度。本教程介绍了如LLMs的基础模型在推荐方面的应用。我们介绍了推荐系统是如何从浅层模型发展到深层模型再到大型模型的,LLMs是如何使生成式推荐成为可能,与传统的区分式推荐相对比,以及如何构建基于LLM的推荐系统。我们从多个角度介绍了基于LLM的推荐,包括数据准备、模型设计、模型预训练、微调和提示、模型评估、多模态和多任务学习,以及基于LLM的推荐系统的可信视角,如公平性和透明度。

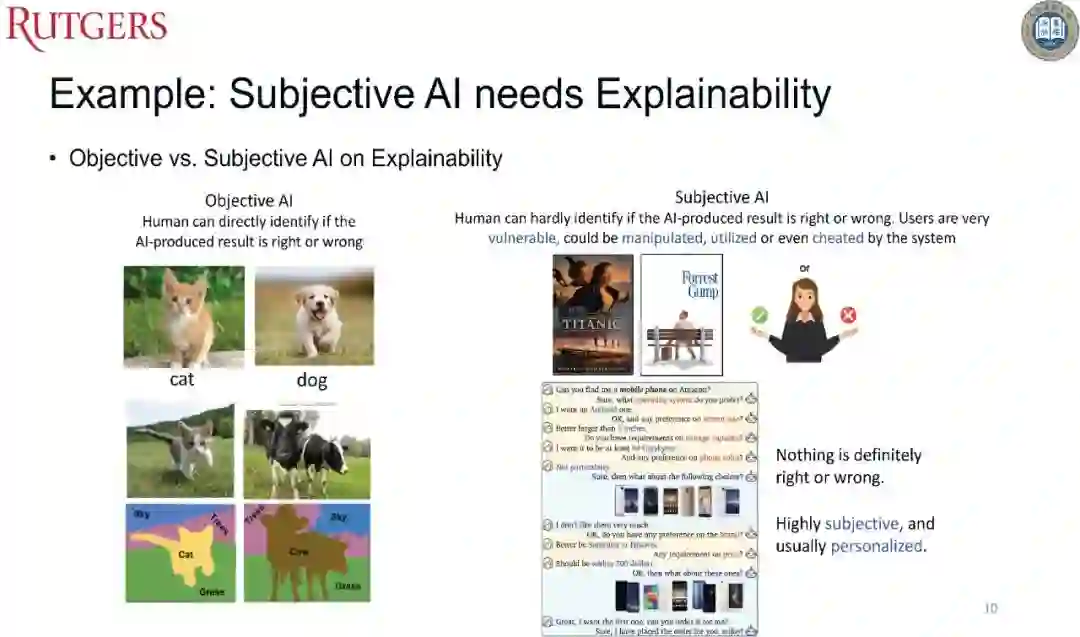

在本教程中,我们旨在提供一个全面且连贯的关于LLM在推荐系统中最新进展的概览。我们首先提供关于LLMs和推荐系统基础的初步信息。然后,我们重点关注模型结构、训练、评估和可信度方面的最新进展。 最近,大型语言模型(LLMs)已成为强大的工具,并为推荐系统带来显著好处,使其在个性化推荐方面具有极大的优势。凭借卓越的学习和语言建模能力,LLMs能够构建有效的多任务和多模态推荐引擎。本教程旨在分享关于LLMs在推荐系统中的发展、应用和潜在好处的知识,有助于提高研究人员和从业者对这些模型的理解和采用。教程还提供了一个机会,来解决基于LLM的推荐系统特有的挑战和考虑因素,如个性化、数据隐私、公平性和可解释性,促进对这些模型影响和负责任使用的更深入理解。最后,教程还可以作为交流思想、分享最佳实践和鼓励领域专家合作的平台,最终推动基于LLM的推荐系统的进步和创新。

教程将从五个主要方面介绍基于LLM的推荐 —— 数据集、模型、评估、工具包和实际系统。具体来说:

• 数据集:我们介绍了促进基于LLM的推荐模型的数据集。这对于以数据为中心的机器学习(如基于LLM的推荐系统)尤为重要,因为LLMs的预训练在很大程度上决定了基于LLM的推荐的能力和实用性。 • 模型:在教程的这一部分,我们组织并介绍了最近的基于LLM的推荐模型、它们的关系、LLM基础的推荐模型的各种预训练、微调和提示策略,以及未来改进的可能方向。 • 评估:我们介绍了基于LLM的推荐模型的评估方法。由于基于LLM的推荐模型的多任务、多模态和跨数据特性,评估模型不仅关注推荐准确性,还涉及文本质量、效率和流畅性等多个方面。 • 工具包:我们介绍了现有的开源模型和平台,以促进基于LLM的推荐研究。 • 实际系统:最后,我们介绍了现有的支持推荐功能的工业级LLM系统及其改进的优势和问题。 基于以上丰富的材料,本教程将大大帮助对基于LLM的推荐感兴趣的学术界和工业界的研究人员。